Deepfake del Rey Felipe de Bélgica: Así funciona la estafa con IA que suplantó a la Corona

Resumen Ejecutivo: Deepfake Real 2026

El Contexto: Una red criminal internacional ha logrado suplantar al Rey Felipe de Bélgica y a su jefe de inteligencia militar (ADIV) utilizando modelos de IA generativa en tiempo real.

Los atacantes explotaron el 50º aniversario de la Fundación Rey Balduino (1976-2026) e inventaron una crisis de rehenes en Siria para exigir fondos «reservados» con urgencia.

Utilizaron Inyección de Cámara Virtual. Interceptaron la señal de vídeo en apps como Zoom o WhatsApp para superponer una máscara digital del Rey, logrando al menos un robo confirmado.

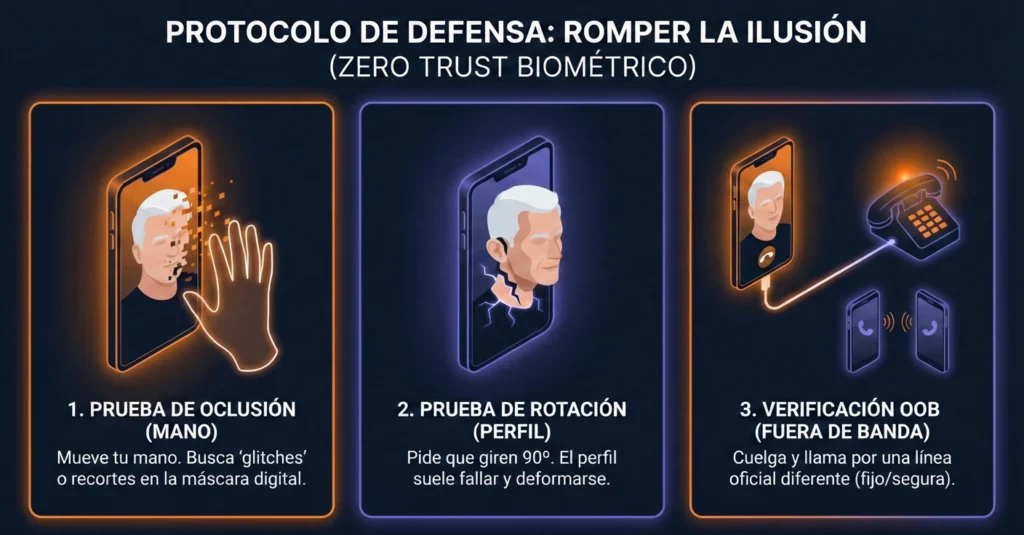

- Prueba de la Mano: Pasa tu mano frente a tu cara; el deepfake suele fallar y «recortar» la mano.

- Rotación: Pide al interlocutor que gire la cabeza 90º; las máscaras digitales se deforman de perfil.

- OOB: Verifica siempre llamando por una línea telefónica oficial distinta.

La confianza digital, tal como la conocíamos, ha sufrido una fractura irreparable en Bruselas. La confirmación este fin de semana por parte de la Fiscalía Federal belga sobre el uso de deepfakes de vídeo en tiempo real para suplantar al rey Felipe marca el fin de una era en la seguridad corporativa. Lo que comenzó en 2025 como una campaña de phishing dirigida ha mutado, en las primeras semanas de 2026, en una operación de inteligencia ofensiva que ha logrado engañar a la élite empresarial y diplomática del país. Ya no estamos ante una simple estafa; estamos ante la democratización del espionaje de nivel estatal aplicado al crimen organizado.

El Teatro de Operaciones: Un «Whaling» de Precisión

El ataque se distingue por su meticulosa fase de reconocimiento, alejándose del «phishing de arrastre» para ejecutar un «Whaling» (caza de ballenas) de precisión quirúrgica. Los atacantes no dispararon a ciegas. Seleccionaron objetivos con vínculos preexistentes o plausibles con la Corona, estudiando sus perfiles públicos y relaciones institucionales para diseñar un pretexto irrefutable.

La narrativa se construyó sobre dos pilares de presión psicológica diseñados para anular el juicio crítico. Primero, la urgencia humanitaria, solicitando fondos reservados para liberar a periodistas belgas supuestamente secuestrados en Siria. Segundo, la exclusividad institucional, utilizando el 50º aniversario de la Fundación Rey Balduino (creada en 1976) como cebo para invitar a las víctimas a una ficticia cena de gala, exigiendo patrocinios inmediatos.

Sin embargo, el verdadero salto evolutivo reside en la orquestación de las identidades. Los atacantes no solo suplantaron al monarca. Para blindar la credibilidad de la operación, usurparon primero la identidad de Vincent Houssiau, Jefe de Gabinete del Rey, y, lo que es más alarmante, la del General Mayor Stéphane Dutron, jefe del Servicio General de Inteligencia y Seguridad (ADIV). Al introducir a la máxima autoridad de inteligencia militar en la ecuación, los criminales desactivaron el escepticismo de las víctimas: si el jefe de los espías te contacta por un canal «seguro», la paranoia se convierte en obediencia.

Under the Hood: Anatomía de una Inyección de Cámara

Para entender cómo se engaña a un CEO en directo, debemos dejar de pensar en esto como un «vídeo falso» y empezar a verlo como un secuestro de señal. En una videollamada legítima, la ruta de datos es directa: la luz entra por la lente, el sensor la convierte en bits y la aplicación transmite esos bits. En este ataque, los criminales rompen esa cadena física introduciendo un intermediario de software: el Driver de Cámara Virtual.

El proceso técnico ocurre en milisegundos y consta de tres capas simultáneas. Primero, la Captura de Origen: un actor humano se sienta frente a su cámara y «actúa» los movimientos. Segundo, la Síntesis Neural: un modelo de IA, entrenado previamente con cientos de horas de metraje público del Rey Felipe (discursos, entrevistas), mapea la geometría facial del monarca sobre la del actor. A diferencia de los filtros antiguos, los modelos de 2026 utilizan renderizado volumétrico para calcular cómo la luz rebota en la piel, replicando imperfecciones y texturas realistas.

El componente crítico final es la Sincronización Labial Guiada por Audio. En muchos casos, el actor ni siquiera necesita hablar; un modelo de clonación de voz (TTS) genera el audio del Rey, y una segunda red neuronal fuerza los labios de la máscara digital a moverse en perfecta sincronía con esos fonemas. Finalmente, el software empaqueta todo esto y se lo presenta a la aplicación de videollamada (Zoom, WhatsApp, Teams) como si fuera una webcam física genérica.

La eficacia de esta tecnología ha quedado probada con un hecho devastador: la Fiscalía ha confirmado que, a pesar de las alertas, se documentó al menos una transferencia de fondos exitosa.

Protocolo de Defensa: Cómo Romper la Ilusión

Ante la caída de la verificación visual, la defensa debe basarse en el concepto de «Zero Trust Biométrico». Si recibes una videollamada de alto nivel no solicitada, la pasividad es tu enemiga. Debes asumir un rol activo para forzar fallos en el modelo generativo.

1. El Desafío de Oclusión (La Prueba de la Mano) Los modelos de IA en tiempo real sufren para mantener la coherencia cuando un objeto físico cruza el rostro. Si sospechas, pide al interlocutor que se pase la mano por delante de la cara lentamente o que se toque la nariz. En un deepfake, la mano a menudo «desaparecerá» detrás de la máscara digital o causará un parpadeo (glitch) en la textura de la piel. Es un error de cálculo de profundidad que la renderización instantánea aún no resuelve perfectamente.

2. Rotación de Perfil Extremo La mayoría de los modelos están entrenados con imágenes frontales o de tres cuartos. Pide a la persona que gire la cabeza 90 grados para «mirar a su izquierda». Los deepfakes suelen colapsar en ángulos de perfil total, mostrando deformaciones en la oreja o perdiendo la alineación del cuello, ya que el modelo carece de datos de entrenamiento suficientes para esa perspectiva lateral pura.

3. Verificación Fuera de Banda (OOB) Esta es la regla de oro criptográfica aplicada al mundo humano. Si el «Rey» (o tu CEO) te pide una transferencia urgente por vídeo, cuelga. Llama inmediatamente al número oficial conocido de su oficina (nunca al número que te acaba de llamar) para confirmar la orden. Si la solicitud es legítima, entenderán la precaución.

Conclusión: El Fin de la Inocencia Digital

Este incidente obliga a reescribir los protocolos de verificación de identidad. Durante años, la videollamada fue nuestra «prueba de vida» definitiva. Hoy, esa certeza se ha evaporado. La simple imagen de un rostro familiar moviéndose y hablando ya no constituye prueba de identidad, sino meramente contenido generado. Las organizaciones deben migrar inmediatamente a sistemas de autenticación criptográfica, asumiendo que nuestros ojos y oídos han dejado de ser sensores fiables en el entorno digital.