Gemini se convierte en agente autónomo y tu móvil empezará a usarse solo

Resumen Estructurado: Gemini Agente Autónomo

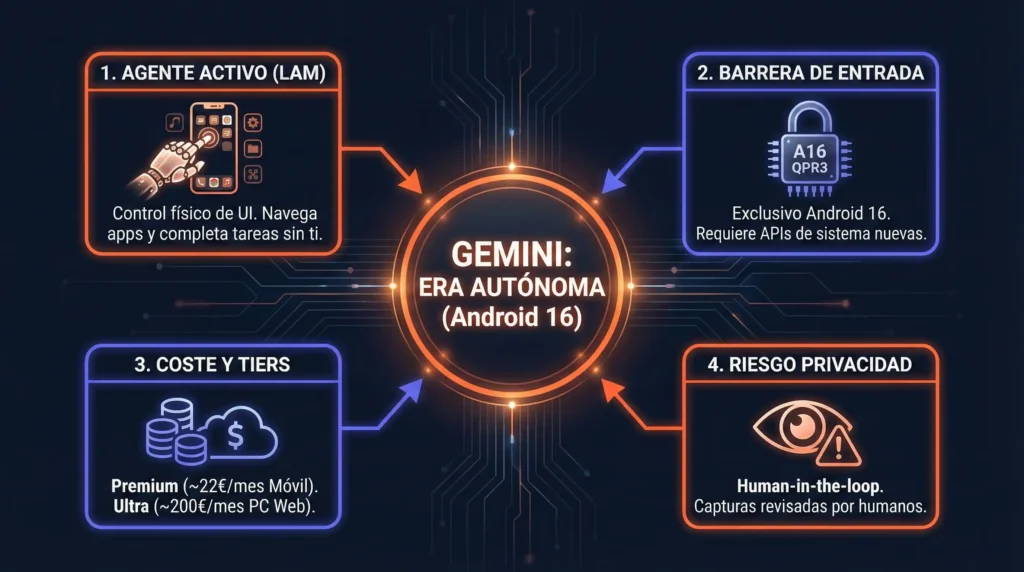

El hito: Google transforma Gemini de un chatbot pasivo a un Large Action Model (LAM) capaz de controlar físicamente la interfaz de tu dispositivo.

La función de «Screen Automation» requiere APIs de sistema exclusivas de Android 16 QPR3. Los móviles actuales no podrán usarla a nivel nativo.

Móvil: Plan AI Premium (~22€/mes).

Escritorio: Plan AI Ultra (~200€/mes) para autonomía total. Versión básica geobloqueada en EE.UU.

Al ceder el control de la pantalla, se advierte que revisores humanos podrían acceder a capturas para entrenamiento. No recomendado para operaciones bancarias.

La IA deja de ser un buscador glorificado para convertirse en el sistema operativo real. La interfaz gráfica tradicional empieza a ser opcional.

Gemini: El Agente Autónomo

El fin de la interfaz pasiva

La inteligencia artificial ha cruzado la línea final que separaba el chatbot del asistente real. Según el análisis del código de la actualización 17.4 de la Google App, Gemini deja de ser una herramienta a la que le pides información para transformarse en un agente autónomo capaz de ejecutar acciones físicas en tu dispositivo. Ya no tendrás que navegar por menús infinitos porque la IA tomará el control de tu pantalla para pulsar botones, rellenar campos y completar tareas complejas en aplicaciones de terceros —como pedir comida o transporte— como si fuera un usuario invisible operando tu teléfono.

La barrera de entrada de Android 16

Esta capacidad de «automatización de pantalla» no es una simple actualización de software, sino una integración profunda en las entrañas del sistema operativo. Por eso Google ha limitado estrictamente su funcionamiento a dispositivos que ejecuten Android 16 QPR3, la futura versión del sistema que incluye los permisos de accesibilidad necesarios para que una IA «vea» y toque la pantalla de forma segura. Esto deja fuera inicialmente a la inmensa mayoría del parque actual de dispositivos Android y convierte la autonomía real en una característica exclusiva de los futuros Pixel y terminales de gama alta actualizados a la última versión.

El precio de la autonomía (Suscripciones y Tiers)

Aquí llega el jarro de agua fría. Aunque tengas un móvil compatible, la «inteligencia» necesaria para operar estas acciones no es gratuita. La documentación de suscripciones para 2026 revela una segmentación agresiva:

- En el móvil (Android): Se espera que la automatización completa forme parte del plan Google One AI Premium (~21,99 €/mes), necesario para acceder a los modelos Gemini 3 Pro que poseen la capacidad de razonamiento lógico para navegar apps sin estrellarse.

- En el escritorio (Agente Web): La situación es más elitista. El «Gemini Agent» capaz de controlar el navegador de forma totalmente autónoma aparece listado en los nuevos planes Google AI Ultra (enfocados a uso empresarial/intensivo, con costes que pueden superar los 200€/mes según el volumen de créditos), mientras que los usuarios estándar de AI Premium recibirían una versión «copiloto» más limitada. Además, el lanzamiento inicial del Agente Web está restringido a EE.UU. y en inglés, obligando a Europa a esperar a la adecuación con la AI Act.

La alternativa web para tu ordenador

Si asumes el coste, la versión de escritorio promete cambiar el flujo de trabajo. A través de gemini.google.com, el Gemini Agent no controla el sistema operativo (no abrirá tu Excel local), pero tiene control total dentro de Chrome. Puede investigar en múltiples pestañas, interactuar con webs de viajes, rellenar formularios corporativos y gestionar tu correo de Google Workspace sin que tú muevas el ratón. Es la misma filosofía de delegar tareas complejas, pero confinada a la nube.

El precio de la privacidad

La letra pequeña de esta revolución es la privacidad. Para que Gemini aprenda a navegar por las aplicaciones tan bien como tú, el código filtrado revela advertencias explícitas de que las capturas de pantalla de tus interacciones podrían ser revisadas por humanos si mantienes activo el historial de actividad. La empresa es tajante al recomendar que no se utilice esta función para operaciones bancarias o gestión de credenciales sensibles, admitiendo implícitamente que ceder el control de la pantalla equivale a abrir una ventana directa a nuestra vida digital donde la IA ve absolutamente todo.