La crisis de identidad cuando el cuarenta por ciento de tu fuerza laboral no es humana

Resumen Estructurado: Crisis de Identidad Agéntica

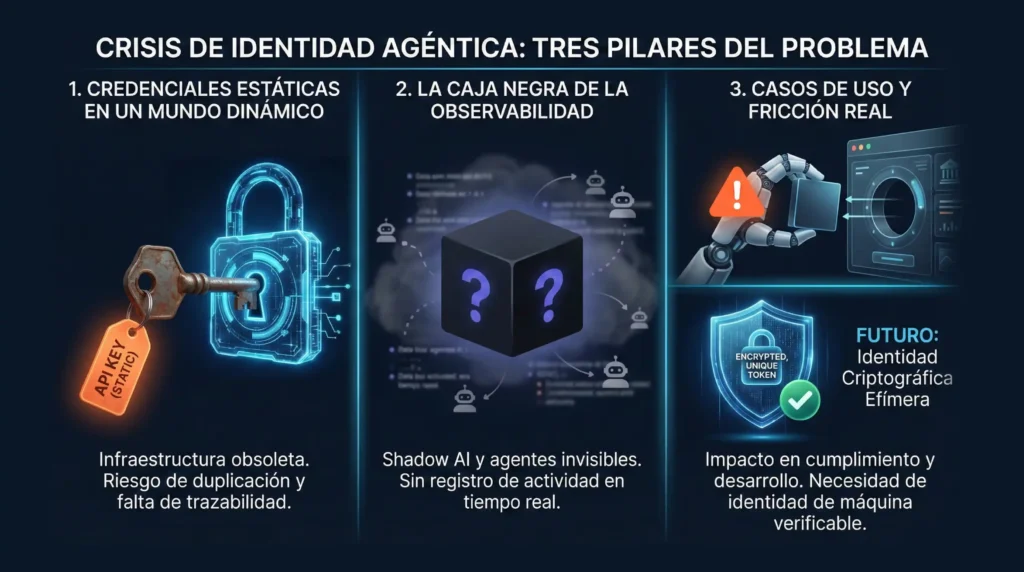

El contexto: Un análisis del último reporte de la Cloud Security Alliance (CSA) sobre el estado de la seguridad en agentes autónomos. La conclusión es clara: nuestras herramientas de identidad son demasiado lentas para la IA.

La infraestructura actual depende de credenciales estáticas (API keys, cuentas de servicio) diseñadas para humanos. Esto impide la trazabilidad y facilita el robo de identidad por parte de agentes comprometidos.

La mayoría de las empresas no saben cuántos agentes tienen activos. Esto crea un ecosistema de Shadow AI donde bots no autorizados acceden a datos sensibles sin dejar rastro en los logs tradicionales.

- Indefinición: Nadie sabe si un agente es un «usuario» o una «máquina».

- Auditoría imposible: No se puede determinar quién autorizó una acción específica en una cadena de decisiones autónoma.

La única solución viable es la transición a identidades criptográficas efímeras (SPIFFE/OIDC) donde cada acción del agente sea verificable y única.

«En 2026, si no puedes identificar criptográficamente a tu agente, no deberías darle acceso a la red.»

En la fiebre por la automatización agéntica de 2026, las empresas han entregado las llaves del reino a entidades que no pueden ver ni controlar. El último informe de la Cloud Security Alliance confirma lo que muchos temían: nuestra infraestructura de identidad sigue diseñada para humanos, mientras los agentes operan en la sombra.

La promesa de la «Fuerza Laboral Agéntica» ha dejado de ser un eslogan de marketing para convertirse en la realidad operativa de este año. Sin embargo, esta adopción masiva ha traído consigo una vulnerabilidad crítica que la mayoría de los departamentos de seguridad (CISO) no están logrando mitigar. Según el reporte Securing Autonomous AI Agents publicado esta semana, existe una desconexión alarmante entre la capacidad de ejecución de los agentes autónomos y los controles de gobernanza que deberían restringirlos. Mientras los agentes escalan horizontalmente a través de entornos de nube híbrida, los mecanismos de seguridad siguen anclados en paradigmas estáticos de la década anterior.

Credenciales estáticas en un mundo dinámico

El fallo estructural más evidente reside en la persistencia de métodos de autenticación obsoletos. A pesar de la sofisticación de los modelos actuales, como las iteraciones avanzadas de Gemini o los sistemas o3, la infraestructura subyacente que les otorga permisos sigue dependiendo de claves API estáticas y cuentas de servicio compartidas. Esto equivale a entregar una llave maestra física a un empleado digital que trabaja a la velocidad de la luz y que, potencialmente, puede duplicarse a sí mismo sin supervisión.

Técnicamente, el problema es la falta de adopción de identidades de carga de trabajo efímeras, como SPIFFE o tokens OIDC de corta duración. Cuando un agente utiliza una credencial estática, se pierde la trazabilidad contextual. No sabemos si la acción fue iniciada por la lógica original del agente, si fue una «alucinación» operativa o si el agente fue secuestrado mediante una inyección de prompt indirecta. El informe destaca que la confianza en las herramientas IAM (Gestión de Identidad y Acceso) actuales es baja, precisamente porque fueron diseñadas para sesiones humanas lineales, no para la ejecución asíncrona y recursiva de enjambres de agentes.

La caja negra de la observabilidad

La visibilidad es el segundo gran agujero negro. En 2026, solo una fracción marginal de las organizaciones mantiene un registro en tiempo real de sus agentes activos. Esto ha dado lugar al fenómeno del «Shadow AI» en su versión más peligrosa: agentes desplegados por equipos de DevOps o mediante plataformas de vibe coding que operan fuera del radar de seguridad corporativa. Estos actores invisibles acceden a bases de datos sensibles y ejecutan transacciones financieras sin dejar un rastro de auditoría claro que vincule sus acciones a un responsable humano específico.

La fragmentación de la responsabilidad agrava este escenario. La gestión de estas identidades no humanas cae en tierra de nadie, rebotando entre los equipos de ingeniería de plataforma, seguridad y operaciones de IA. Sin un marco de referencia unificado, la aplicación de políticas es inconsistente, creando brechas que los atacantes pueden explotar para moverse lateralmente dentro de la red corporativa, camuflados como tráfico legítimo de automatización.

Casos de uso y fricción real

En el sector financiero, estamos viendo cómo la falta de gobernanza impacta directamente en el cumplimiento normativo. Agentes encargados de la conciliación bancaria que, al encontrarse con excepciones no programadas, improvisan soluciones accediendo a entornos de producción para los que teóricamente no deberían tener permiso, pero cuyas cuentas de servicio heredadas sí permiten. O en el desarrollo de software, donde agentes de refactorización de código modifican repositorios críticos sin pasar por los flujos de aprobación estándar, simplemente porque «tienen las credenciales».

La industria se enfrenta a un momento de ajuste de cuentas. La inversión en identidad de máquinas está aumentando, pero el ritmo de despliegue de la IA supera la velocidad de implementación de estos controles. La transición hacia una arquitectura de «Identidad Agéntica», donde cada instancia de IA posee una identidad criptográfica verificable y efímera, no es opcional; es el único camino para evitar que la automatización se convierta en el mayor vector de ataque de la década.