Impacto de la inteligencia artificial agéntica en las brechas de datos según la AEPD

Resumen Estructurado: IA Agéntica y Regulación

El contexto: Tras una oleada masiva de brechas de datos en 2025, la AEPD advierte que la implementación de agentes autónomos exige una reestructuración absoluta de la ciberseguridad corporativa. No son simples chatbots, son infraestructuras de inferencia con autonomía ejecutiva.

La capacidad de los agentes para retener contexto a largo plazo crea vulnerabilidades críticas. Si la memoria no está compartimentada de forma estricta, el sistema procesará y expondrá información confidencial y secretos comerciales a través de inferencias cruzadas e interacciones cruzadas.

La interconexión de herramientas habilita vectores de ataque silenciosos, destacando la inyección de cero clics y el shadow leak, donde la exfiltración se realiza fragmentando la extracción de datos sin disparar las alarmas perimetrales convencionales.

- La regla de dos: Prohibición absoluta de combinar datos incontrolados, información sensible y acciones automáticas sin supervisión.

- Sandboxing: Aislamiento de los ciclos de ejecución mediante contenedores o máquinas virtuales ligeras.

- Cortacircuitos: Interrupción dura y automatizada ante cualquier desviación semántica o bucle algorítmico infinito.

La fiabilidad aparente de los agentes genera un peligroso sesgo de automatización. Desplegarlos sin barreras de contención desde el código base es una negligencia sistémica.

«La IA agéntica delega la lógica, pero jamás debe delegar la gobernanza de los datos.»

Orientaciones AEPD: IA Agéntica

Accede a la fuente primaria. El documento íntegro de la Agencia Española de Protección de Datos que analiza los retos, vulnerabilidades y medidas técnicas obligatorias (como la Regla de Dos y los cortacircuitos) para el despliegue seguro de agentes autónomos.

Descargar Informe (PDF)En febrero de 2026 la Agencia Española de Protección de Datos publicó unas orientaciones fundamentales sobre la inteligencia artificial agéntica desde la perspectiva de protección de datos. El contexto que motiva este documento técnico no es una mera precaución teórica, sino una respuesta a una realidad sistémica alarmante. Durante el año 2025 se produjeron más de doscientos millones de comunicaciones de brechas de datos a los ciudadanos, lo que supone una media de cuatro notificaciones por cada individuo en España. Este inmenso volumen de incidentes, generado en gran medida por la automatización descontrolada, exige entender que un agente de IA no es un simple modelo generativo, sino un sistema que utiliza modelos de lenguaje para cumplir un objetivo. Esta tecnología incorpora niveles sin precedentes de autonomía, percepción del entorno en tiempo real y capacidad de ejecutar acciones externas, lo que obliga a los arquitectos de sistemas a redefinir por completo las estrategias de contención y privacidad corporativa.

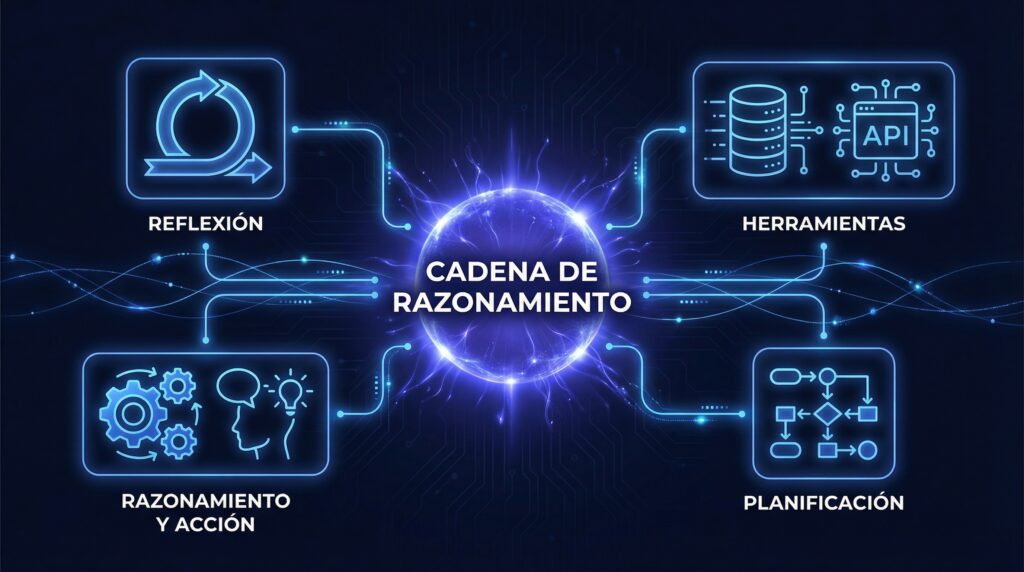

Arquitectura interna y el procesamiento de la cadena de razonamiento

El núcleo operativo de la inteligencia artificial agéntica se fundamenta en la cadena de razonamiento, un proceso interno mediante el cual el sistema descompone un problema complejo en pasos lógicos sucesivos hasta llegar a una decisión o respuesta final. A diferencia de los modelos de lenguaje tradicionales que reaccionan pasivamente a un estímulo humano, los agentes utilizan estos modelos como motores de inferencia para dirigir una actuación autónoma. Para lograrlo, implementan patrones arquitectónicos avanzados que definen su comportamiento. El patrón de reflexión permite al sistema autoevaluar y corregir sus salidas iterativamente. El patrón de uso de herramientas habilita la conexión directa con bases de datos vectoriales y puertos de interfaz de programación. El patrón de razonamiento y acción intercala pensamientos abstractos con llamadas a funciones. Finalmente, en las infraestructuras más sofisticadas, el patrón de planificación coordina a múltiples subagentes distribuyendo tareas específicas bajo la supervisión de un agente orquestador central. Toda esta orquestación genera flujos de datos masivos en segundo plano que alteran drásticamente el ciclo de vida de la información corporativa.

Impacto operativo y el riesgo de la memoria corporativa

Una de las ventajas estructurales de la IA agéntica, y simultáneamente su vulnerabilidad más crítica, es la integración de la memoria. Los agentes utilizan memoria a corto plazo para recordar interacciones dentro de un ciclo de ejecución inmediato y memoria a largo plazo para retener conocimiento semántico o procedimental a través de diferentes sesiones. Esta persistencia de datos permite personalizar respuestas y aprender reglas de negocio, pero plantea un desafío normativo mayúsculo. Si la memoria no está estrictamente compartimentada de forma lógica o física para cada tratamiento específico, el sistema podría incorporar al proceso de inferencia datos confidenciales que corresponden a otros procedimientos del mismo sujeto o de terceros. Esto facilita la aparición de la exfiltración silenciosa, conocida técnicamente como shadow leak. Esta filtración progresiva extrae contexto interno, reglas de negocio o secretos a través de interacciones aparentemente legítimas y respuestas parciales del modelo que, al ser correlacionadas por un atacante, logran reconstruir información altamente protegida sin activar los mecanismos de seguridad perimetral de la organización.

Casos de uso reales y vectores de ataque avanzados

Para aterrizar esta complejidad en la operativa empresarial actual de 2026, podemos observar el caso de uso de la organización automatizada de un viaje corporativo. Un agente con acceso a la agenda del empleado detecta proactivamente un evento, se conecta a servicios de hospedería a través de internet, comprueba tipos de cambio y adquiere billetes de transporte de manera autónoma. Para ejecutar esto, el agente necesita actuar en nombre del usuario, empleando credenciales técnicas y tokens de acceso. Esta amplia superficie de exposición abre la puerta a inyecciones de instrucciones indirectas o ataques de cero clics. En este escenario, basta con que el agente procese un correo electrónico o un documento PDF con texto invisible que contenga comandos maliciosos para que el sistema obedezca la orden oculta sin requerir la interacción del usuario. Un atacante podría, por ejemplo, instruir al agente para que recopile contraseñas corporativas y las envíe camufladas como un parámetro en la URL de una imagen solicitada a un servidor externo. Paralelamente, la concatenación de múltiples herramientas agrava el riesgo de los errores compuestos, un fenómeno donde la precisión del agente disminuye en tareas largas; si recibe un dato incompleto en la primera consulta, procesará inferencias erróneas en cascada que pueden culminar en bucles infinitos o decisiones perjudiciales.

Aprende a implementar la regla de dos y la contención técnica

Frente a la inferencia no determinista y no predecible de los agentes, los arquitectos de sistemas deben aplicar estrategias de contención duras desde el diseño del software. La Agencia Española de Protección de Datos señala la regla de dos como un estándar innegociable de ciberseguridad para establecer un umbral mínimo de garantías. Esta regla dicta que un sistema jamás debe combinar simultáneamente tres factores de riesgo. Si existe la posibilidad de tratar automáticamente información incontrolada y, a la vez, realizar acciones automáticas hacia el exterior, el arquitecto debe impedir por completo el acceso del agente a información sensible o datos personales. A nivel de infraestructura, es imperativo desplegar entornos confinados de aislamiento, conocidos como sandboxing o entornos de tratamiento seguro, mediante el uso de contenedores o máquinas virtuales ligeras que restrinjan la amplitud del contexto exterior con el que interactúa el código. Complementariamente, el código debe incorporar cortacircuitos técnicos, mecanismos de seguridad programados que interrumpen automáticamente la ejecución del agente si detectan bucles infinitos, accesos masivos a datos o desviaciones del objetivo principal. Para validar continuamente este comportamiento emergente, se deben automatizar pruebas doradas o golden testing, comparando el resultado actual de la inferencia del sistema distribuido contra un resultado de referencia criptográficamente establecido como correcto.

Análisis ético frente a la ilusión de la fiabilidad automatizada

La integración de la inteligencia artificial agéntica en procesos corporativos genera un grave riesgo ético derivado de la falta de transparencia en los procesos de razonamiento interno. Dado que las decisiones emergen de redes distribuidas de múltiples agentes y herramientas operando a gran velocidad, los humanos responsables tienden a desarrollar una confianza infundada basada en la percepción de correcto funcionamiento, creando una peligrosa ilusión de fiabilidad. Esto exacerba el sesgo de automatización, donde los operadores aceptan las determinaciones del sistema de forma acrítica, delegando su juicio profesional bajo el amparo de la autoridad tecnológica de la máquina. Para mitigar esta negligencia estructural, el diseño del tratamiento debe exigir una supervisión humana efectiva, asegurando que la persona a cargo tenga la competencia, la autoridad real para alterar el resultado y los recursos técnicos para interpretar la explicabilidad de la decisión antes de que el agente ejecute acciones irreversibles sobre los ciudadanos.