Qwen 3.5 Plus y su impacto en la infraestructura de agentes autónomos

Resumen Estructurado | Qwen 3.5 Plus

El contexto Alibaba Cloud ha redefinido la infraestructura de IA con Qwen 3.5 Plus, fusionando multimodalidad nativa pura y capacidades agénticas en un ecosistema de bajo coste.

De 397 mil millones de parámetros, el modelo solo activa 17 mil millones por token, optimizando la eficiencia matemática sin saturar la VRAM en los servidores.

La variante comercial desbloquea por defecto una ventana de contexto de un millón de tokens, permitiendo inyectar repositorios de código enteros sin perder coherencia.

El sistema analiza metraje de vídeo largo, gráficos y audio directamente en un único espacio latente, eliminando por completo la dependencia de modelos puente o transcripciones intermedias.

Entrenado mediante aprendizaje por refuerzo masivo, el modelo puede planificar tareas a largo plazo, utilizar herramientas de forma autónoma y corregir sus propias secuencias lógicas.

La comoditización del razonamiento a coste marginal obliga a Occidente a replantear su modelo de negocio ante una infraestructura china de adopción masiva.

«En 2026, la inteligencia artificial ya no se mide por su capacidad de dialogar, sino por su autonomía para ejecutar.»

El ecosistema de inteligencia artificial ha experimentado una reconfiguración crítica a mediados de febrero de 2026 con el despliegue de Qwen 3.5 por parte de Alibaba Cloud. Esta iteración no representa una actualización menor, sino una bifurcación estratégica que divide el mercado entre un modelo masivo de pesos abiertos denominado Qwen3.5-397B-A17B y una versión comercial alojada bajo el nombre Qwen 3.5-Plus. Este movimiento consolida un estándar emergente en la creación de agentes autónomos y establece una multimodalidad nativa que elimina la necesidad de modelos puente, permitiendo la ingesta simultánea de vídeo, documentos y código en un único espacio de inferencia.

Arquitectura de enrutamiento y la ventana de contexto extrema

El núcleo algorítmico de esta nueva familia se basa en una red neuronal de expertos altamente optimizada. De un total estructural de trescientos noventa y siete mil millones de parámetros, el sistema únicamente activa diecisiete mil millones durante el procesamiento de cada token. Esta eficiencia matemática permite ejecutar razonamientos lógicos complejos sin saturar la memoria de los clústeres, garantizando latencias operativas viables para entornos de producción. Por su parte, la variante Qwen 3.5-Plus, accesible a través de la infraestructura Model Studio de Alibaba Cloud, amplía la memoria a corto plazo del modelo hasta alcanzar un millón de tokens por defecto. Esta capacidad permite a los desarrolladores introducir repositorios de código enteros, historiales legales masivos o libros técnicos completos sin fragmentar la información, asegurando que el modelo mantenga la coherencia en flujos de trabajo prolongados. Las métricas internas y de la comunidad validan esta arquitectura, registrando ochenta y siete coma ocho puntos en MMLU-Pro para razonamiento general, setenta y seis coma cuatro en SWE-bench Verified para codificación y ochenta y seis coma siete en TAU2-Bench para la ejecución de herramientas.

Escalado de entornos y el dominio de Qwen 3.5

En el siguiente gráfico se muestra una comparativa técnica sobre cómo el número de entornos de entrenamiento (Environment Scaling) impacta directamente en el ranking promedio de los modelos de lenguaje más avanzados de 2026. Se observa una correlación positiva clara: a mayor exposición a entornos de simulación y entrenamiento, menor es el ranking numérico, lo que se traduce en una eficiencia y precisión superiores en benchmarks críticos como BFCL-V4 o MCP-Mark.

En la cúspide de esta evolución se encuentra Qwen 3.5-397B-A17B Thinking, que logra posicionarse por debajo del ranking 4 una vez superada la barrera de los 15,000 entornos. Este modelo supera a competidores de élite como Claude-Opus 4.5 Thinking y Gemini-3 Pro, demostrando que la arquitectura de razonamiento profundo (Thinking) combinada con un escalado masivo de datos es la receta ganadora en el ecosistema actual. Por otro lado, la variante Non-Thinking de Qwen muestra un techo de rendimiento significativamente más bajo, estabilizándose cerca del ranking 7, lo que subraya la importancia de las capas de computación de inferencia para tareas de alta complejidad.

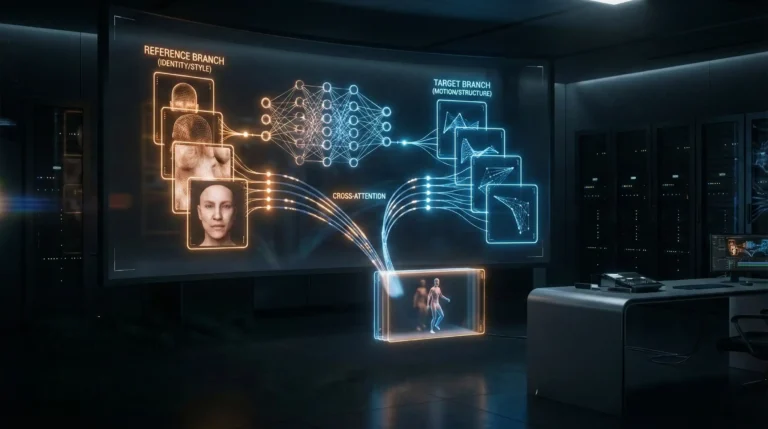

Multimodalidad nativa y convergencia sensorial

La arquitectura de Qwen 3.5 se distingue por su enfoque verdaderamente multimodal, integrando la visión, la lectura de gráficos y el análisis de vídeo largo en su entrenamiento base. A diferencia de sistemas anteriores que requerían transcripciones o redes secundarias para procesar el entorno visual, este modelo correlaciona flujos audiovisuales con datos técnicos estructurados en un solo paso algorítmico. Un usuario puede inyectar un metraje de vídeo junto con un manual analítico, y el sistema extraerá los datos con una precisión notable, alcanzando ochenta y cinco puntos en el exigente benchmark MMMU de visión. Además, las capacidades colaterales de la serie Qwen abarcan el renderizado profesional de tipografías dentro de la generación de imágenes y la alineación de voz multilingüe, eliminando las barreras históricas entre el texto, el código y los formatos multimedia.

La eficiencia del Decode Throughput en Qwen 3.5

El análisis de rendimiento de la nueva arquitectura de Alibaba revela una optimización sin precedentes en la velocidad de procesamiento de tokens, especialmente en contextos de gran escala. Los datos muestran que el modelo Qwen 3.5-397B-A17B no solo mejora los resultados lógicos de sus predecesores, sino que redefine la eficiencia operativa de los LLM actuales. Mientras que el modelo Qwen3-Max sirve como base de referencia, la evolución hacia la versión 3.5 supone una aceleración masiva en el rendimiento de decodificación.

En entornos de contexto estándar (32K), el Qwen 3.5 alcanza una velocidad 8.6 veces superior a la arquitectura Max original. Sin embargo, el verdadero hito técnico se observa al escalar la ventana de contexto a 256K tokens. En este escenario de alta densidad de datos, el multiplicador de rendimiento se dispara hasta un impresionante x19.0. Esta progresión indica que la arquitectura 3.5 ha sido optimizada específicamente para mitigar la degradación de velocidad que tradicionalmente afectaba a los modelos de largo contexto, permitiendo una inferencia fluida en documentos extensos o bases de código complejas sin el coste computacional prohibitivo de las generaciones anteriores.

Eficiencia de decodificación en contextos masivos

METRIC: TOKENS/SECAnálisis de Kanon: La arquitectura MoE (Mixture of Experts) de Qwen 3.5 demuestra una optimización lineal en tareas de decodificación que se vuelve exponencial conforme aumenta la carga de contexto.

Capacidad agéntica y orquestación de herramientas

El avance más significativo para la industria del software radica en el diseño orientado a la orquestación autónoma. El modelo ha sido entrenado específicamente para planificar, ejecutar y corregir tareas prolongadas mediante el uso adaptativo de herramientas externas y la interacción con entornos simulados. Esta capacidad de agencia le permite recordar instrucciones complejas a lo largo de interacciones encadenadas, cruzar referencias y ejecutar secuencias lógicas sin intervención humana constante. Para asegurar que esta automatización sea aplicable a nivel global, el equipo de Alibaba ha expandido el soporte lingüístico a doscientos un idiomas y dialectos, superando el sesgo anglocéntrico tradicional y facilitando despliegues corporativos internacionales sin necesidad de ajustes finos locales.

Vías de acceso y democratización del modelo

La estrategia de distribución de Alibaba Cloud persigue una adopción masiva mediante barreras de entrada excepcionalmente bajas. La versión de pesos abiertos está disponible en repositorios oficiales para su descarga y ejecución local, lo que permite a instituciones con hardware adecuado operar el modelo insignia con total privacidad. Para empresas que requieren soluciones gestionadas, la API de Qwen 3.5-Plus ofrece una estructura robusta y precios competitivos a escala, estableciendo recomendaciones claras para su implementación en producción, como el manejo de errores por limitación de velocidad y el control estricto del recuento de tokens. Además, la comunidad de desarrollo ha integrado rápidamente el modelo en entornos de trabajo compartidos, lo que demuestra su enorme tracción como cerebro para automatizaciones de bajo coste.

Consecuencias geopolíticas y éticas de la infraestructura algorítmica

El despliegue de agentes autónomos con un nivel de razonamiento avanzado a un coste marginal plantea desafíos inmediatos sobre la alineación lógica y la seguridad en tiempo real. Al forzar a la inteligencia artificial a aprender mediante ensayo y error en entornos de interacción, se mejora la eficiencia de ejecución, pero se requiere la implementación de escudos de seguridad robustos, como los integrados en la arquitectura Qwen Guard para clasificar y filtrar respuestas. Asimismo, la consolidación de Qwen 3.5 como un estándar global de código abierto incrementa la influencia tecnológica de las arquitecturas desarrolladas bajo el ecosistema chino, obligando al mercado occidental a replantear sus modelos de negocio ante una utilidad de razonamiento cada vez más accesible.