Guía de NotebookLM para educadores en marzo de 2026

Resumen estructurado: Megatutorial NotebookLM

IA Generativa Fundamentada. La evolución de Google NotebookLM desde un simple lector de PDF hasta un ecosistema integral de aprendizaje impulsado por IA. Su principal valor radica en que restringe su análisis exclusivamente a los documentos del usuario, eliminando el riesgo de alucinaciones.

Funciona como un asistente para la instrucción diferenciada en educadores, democratiza la tutoría personalizada para estudiantes y mitiga la sobrecarga informativa en investigadores mediante la triangulación de datos y generación de mapas mentales.

La plataforma se organiza en cuadernos con fronteras semánticas estrictas para evitar la contaminación cruzada de datos. Destacan las opciones de colaboración grupal y los «Cuadernos Destacados», que actúan como plantillas de alta fidelidad curadas por instituciones.

Soporta múltiples formatos, desde hojas de cálculo hasta la asimilación directa de vídeos de YouTube. No obstante, se exige precaución legal: es vital priorizar recursos de dominio público (Open Access) para evitar infracciones de copyright en cuentas institucionales.

El sistema posee una sincronización asimétrica. Al exportar el contenido (ej. a Google Docs), se rompe el vínculo con la IA. Toda iteración semántica, corrección fáctica y refinamiento debe completarse inexorablemente dentro de la interfaz cerrada de NotebookLM.

«En 2026, el desafío limitante de la educación deja de ser la recuperación de datos, para convertirse en la capacidad humana de formular las preguntas correctas y orquestar el razonamiento artificial.»

Megatutorial NotebookLM

Versión descargable del tutorial de NotebookLM actualizado cada vez que hay una novedad. Generado al instante, de forma local y 100% privada en tu navegador.

1. Introducción: De Lector de PDFs a Ecosistema de Aprendizaje

A fecha de 11 de marzo de 2026, el panorama de la tecnología educativa ha experimentado una transformación tectónica impulsada por la maduración de la inteligencia artificial generativa. En este contexto, Google NotebookLM ha trascendido abrumadoramente sus orígenes fundacionales. Lo que comenzó como un experimento conceptual limitado a la lectura interactiva de documentos en formato PDF se ha consolidado como un ecosistema integral y multimodal de estudio, análisis de datos y síntesis de conocimiento. Esta metamorfosis representa un cambio de paradigma fundamental en la forma en que los seres humanos interactúan con la información densa, desplazando el esfuerzo cognitivo desde la mera extracción de datos hacia el pensamiento crítico superior, la evaluación estructural y la creatividad analítica.

El diferenciador arquitectónico central de NotebookLM frente a los grandes modelos de lenguaje (LLMs) conversacionales abiertos, como el ChatGPT estándar o los motores de búsqueda tradicionales, radica en su epistemología restringida. NotebookLM opera estrictamente bajo un modelo de "IA fundamentada" (grounded AI). Esto significa que, en lugar de generar respuestas basándose en el vasto, opaco y a menudo contradictorio corpus de entrenamiento de Internet, la herramienta restringe su horizonte de inferencia y análisis de manera exclusiva a los documentos, enlaces y materiales que el usuario ha subido e indexado explícitamente en su cuaderno de trabajo. Esta restricción intencionada mitiga drásticamente el riesgo de "alucinaciones" computacionales—la invención plausible pero falsa de hechos—y garantiza que cada resumen, ensayo, mapa conceptual o cuestionario generado esté anclado verificablemente en la literatura primaria seleccionada por el investigador o educador.

A Quién Va Dirigido: El Ecosistema Educativo y Académico

Aunque la herramienta es versátil para cualquier profesional del conocimiento, su arquitectura actual parece haber sido diseñada a medida para resolver las fricciones históricas del entorno académico y educativo. El impacto de estas tecnologías ya es cuantificable: a principios de 2026, las integraciones de IA educativa de Google, incluyendo Gemini for Education y NotebookLM, ya operaban en más de mil instituciones de educación superior solamente en los Estados Unidos, impactando los flujos de trabajo de más de diez millones de estudiantes, y demostrando ahorros sustanciales de tiempo de preparación para los docentes a nivel global.

Para los educadores y diseñadores instruccionales, NotebookLM actúa como un asistente de cátedra infatigable. Los profesores se enfrentan constantemente al desafío de la instrucción diferenciada: la necesidad de adaptar un mismo currículo a aulas con una diversidad abrumadora de estilos de aprendizaje, niveles de competencia lectora y necesidades neurodivergentes. A través de las capacidades de NotebookLM, un docente puede introducir un artículo científico denso o un capítulo de un libro de texto universitario y, en cuestión de minutos, extraer planes de lecciones estructurados, generar preguntas de comprensión de lectura estratificadas por dificultad, compilar guías de estudio y transformar la prosa árida en artefactos visuales o auditivos que resuenen con diferentes perfiles de estudiantes. Además, la plataforma fomenta el desarrollo curricular colaborativo, permitiendo a los departamentos académicos compartir cuadernos para refinar unidades didácticas en tiempo real.

Para los estudiantes, la plataforma democratiza el acceso a la tutoría personalizada. Tradicionalmente, un estudiante que se enfrenta a un bloque de texto incomprensible dependía de la disponibilidad de horas de tutoría o de la búsqueda de explicaciones genéricas de terceros en la web. Ahora, el estudiante puede interrogar directamente a su material de estudio, solicitando aclaraciones, simplificaciones de jerga técnica o analogías adaptadas a sus intereses personales. Más aún, las herramientas de evaluación formativa integradas, como la autogeneración de tarjetas didácticas (flashcards) y cuestionarios interactivos, permiten a los alumnos aplicar los principios de la práctica de recuperación espaciada y el aprendizaje activo, optimizando la retención a largo plazo y la preparación para exámenes sin requerir que el profesor elabore estos materiales manualmente.

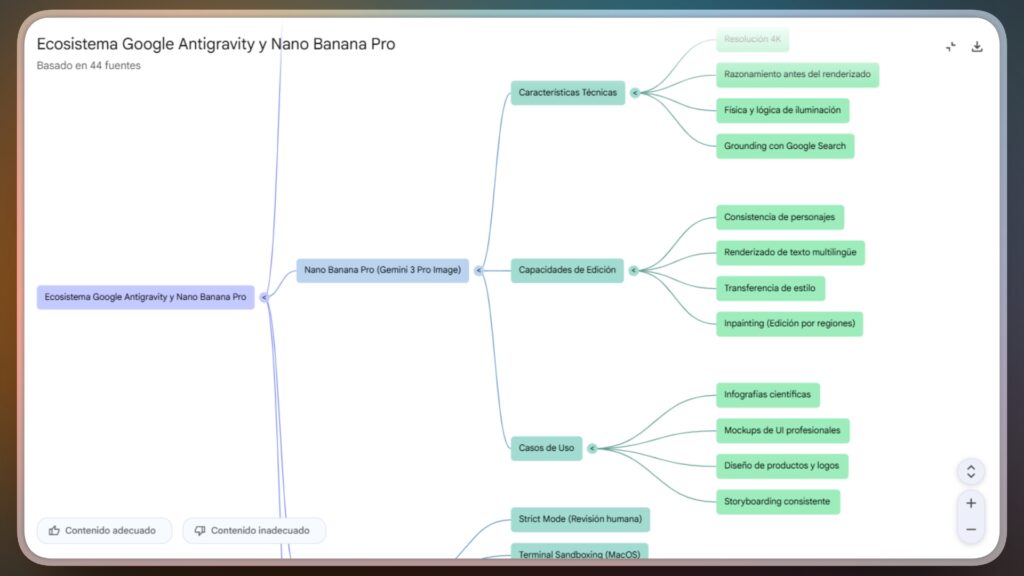

Finalmente, para los investigadores y académicos, la plataforma mitiga la sobrecarga informacional inherente a las revisiones de literatura sistemáticas y al análisis de datos cualitativos. Al permitir la ingesta simultánea de docenas de papers, transcripciones de entrevistas y conjuntos de datos, NotebookLM facilita la triangulación de información, la identificación de patrones latentes y la cartografía de controversias teóricas a través de sus mapas mentales interactivos, acelerando dramáticamente la transición desde la recolección de datos hasta la redacción del manuscrito.

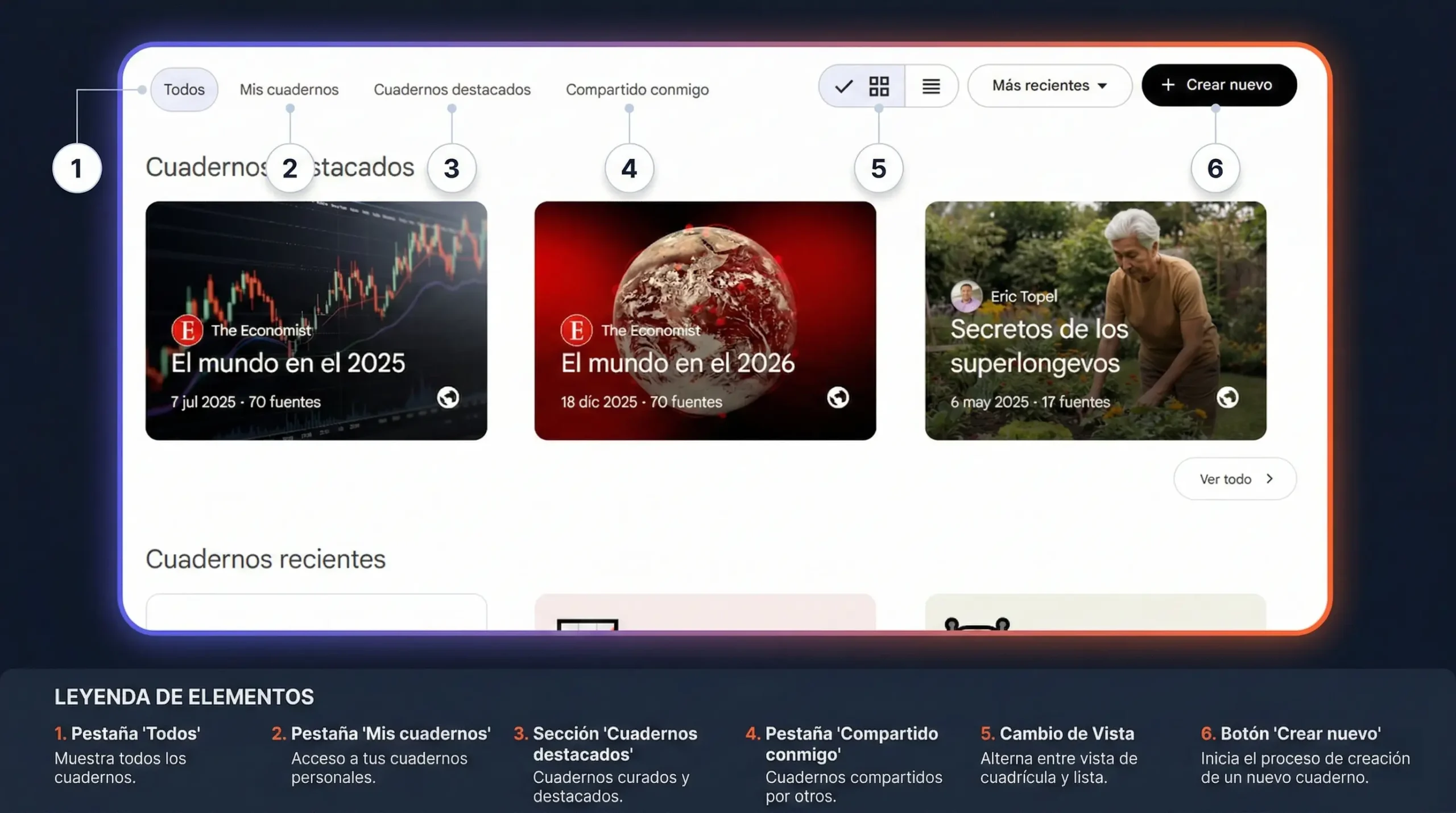

2. El Panel Principal (Dashboard) y Primeros Pasos

El acceso inicial a la plataforma introduce al usuario a un panel principal (Dashboard) concebido bajo los principios del diseño minimalista y la compartimentación de proyectos. Este espacio de trabajo opera como una biblioteca digital donde el conocimiento se organiza en entidades discretas denominadas "cuadernos" (notebooks). La creación de un entorno de trabajo eficiente comienza aquí, entendiendo que cada cuaderno debe representar un límite semántico claro.

Creación y Organización del Espacio de Trabajo

Para iniciar un proyecto, el usuario simplemente selecciona la opción para crear un nuevo cuaderno, asignándole una nomenclatura descriptiva que refleje su propósito, como "Investigación sobre Fusión Nuclear", "Planificación de la Unidad de Historia de Roma" o "Revisión de la Literatura de Tesis". Esta segregación es pedagógicamente vital. Al aislar las fuentes por temática o asignatura, el educador o estudiante garantiza que la inteligencia artificial no realice polinizaciones cruzadas inapropiadas, asegurando que las respuestas sobre física cuántica no se vean contaminadas por apuntes de literatura renacentista almacenados en un cuaderno adyacente.

Una vez creado el cuaderno, el ecosistema permite una organización interna mediante el etiquetado conceptual y la estructuración en carpetas para las notas generadas. La colaboración es otra piedra angular del panel principal. De manera análoga a Google Drive, los cuadernos pueden ser compartidos con colegas o estudiantes, otorgando permisos específicos de lectura, comentario o edición. Esta funcionalidad es particularmente transformadora para la docencia compartida (co-teaching) o para proyectos de investigación grupales, donde múltiples usuarios pueden inyectar fuentes, generar reflexiones y co-crear guías de estudio dentro de un repositorio de conocimiento centralizado y vivo.

Cuadernos Destacados (Featured Notebooks): El Aprendizaje por Modelado

Una innovación crucial consolidada en 2026 es la inclusión de la pestaña de "Cuadernos Destacados" (Featured Notebooks) en el panel principal. Esta característica va más allá de ser una simple galería de plantillas; constituye una herramienta de diseño instruccional basada en el aprendizaje por modelado. Google ha curado y pre-cargado cuadernos de alta fidelidad desarrollados en colaboración con instituciones de prestigio, publicaciones académicas y medios de comunicación como The Economist, The Atlantic y la iniciativa de recursos educativos abiertos OpenStax.

Desde la perspectiva de la capacitación docente, los Cuadernos Destacados eliminan la curva de aprendizaje abstracta. En lugar de leer manuales técnicos sobre cómo formular prompts (instrucciones) efectivos o cómo organizar fuentes complejas, un educador puede ingresar a un cuaderno destacado funcional, como el "Introduction to NotebookLM". Dentro de este entorno preconfigurado, el usuario asume el rol de espectador activo: puede interactuar con el chat, observar cómo la IA ha procesado decenas de artículos complejos para generar un informe coherente, y consumir mapas mentales o podcasts previamente renderizados. Aunque el usuario no puede agregar fuentes propias ni modificar el contenido central de estos cuadernos curados (para proteger la integridad de los derechos de autor y la curación original), la capacidad de desentrañar la lógica algorítmica y replicarla en sus propios cuadernos reduce significativamente la fricción de adopción.

Además, la reciente integración con Google Classroom permite a los docentes adjuntar no solo los cuadernos que ellos mismos han creado, sino también estos Cuadernos Destacados públicos directamente en las tareas (assignments) de los estudiantes, expandiendo exponencialmente el acceso a recursos didácticos de calidad mundial validados por expertos. En un ejercicio práctico de pensamiento crítico, un docente podría asignar un cuaderno destacado que contenga ensayos de un experto en salud pública y solicitar a los alumnos que entrevisten al chatbot sobre la postura del autor, para luego buscar en la web fuentes académicas que refuten dichas conclusiones, fomentando así la alfabetización informacional avanzada.

Escalabilidad y Arquitectura de Suscripciones

La viabilidad de implementar NotebookLM a escala institucional depende de comprender su modelo de límites computacionales, los cuales están profundamente entrelazados con los niveles de suscripción de Google Workspace. La arquitectura de precios refleja un enfoque progresivo, permitiendo a los usuarios individuales experimentar sin costo, mientras que ofrece a las instituciones y usuarios avanzados capacidades de procesamiento masivo.

La siguiente tabla desglosa las capacidades operativas según el nivel de cuenta, un factor decisivo para los administradores de tecnología educativa al planificar presupuestos y asignaciones de licencias:

| Nivel de suscripción | Límite de cuadernos | Fuentes por cuaderno | Consultas de chat (día) | Generaciones de audio (día) | Deep research |

|---|---|---|---|---|---|

| Standard Versión gratuita | 100 | 50 (hasta 500k palabras/fuente) | 50 | 3 | 10 (Por mes) |

| Plus ~ $20 / mes | 500 | 100 | 500 | 20 | 20 (Por día) |

| Pro ~ $50 / mes | 500 | 300 | 500 | 20 | 20 (Por día) |

| Ultra ~ $250 / mes | 500 | 600 | 5000 | 200 | 200 (Por día) |

Para la mayoría de los estudiantes y educadores de educación primaria y secundaria, el nivel estándar ofrece un margen de maniobra excepcionalmente amplio, permitiendo procesar hasta 50 documentos densos por proyecto. Sin embargo, para investigadores de posgrado, analistas de datos o departamentos universitarios que realizan revisiones bibliográficas exhaustivas o compilan currículos enteros, las versiones Plus y Pro resultan indispensables para evitar cuellos de botella algorítmicos.

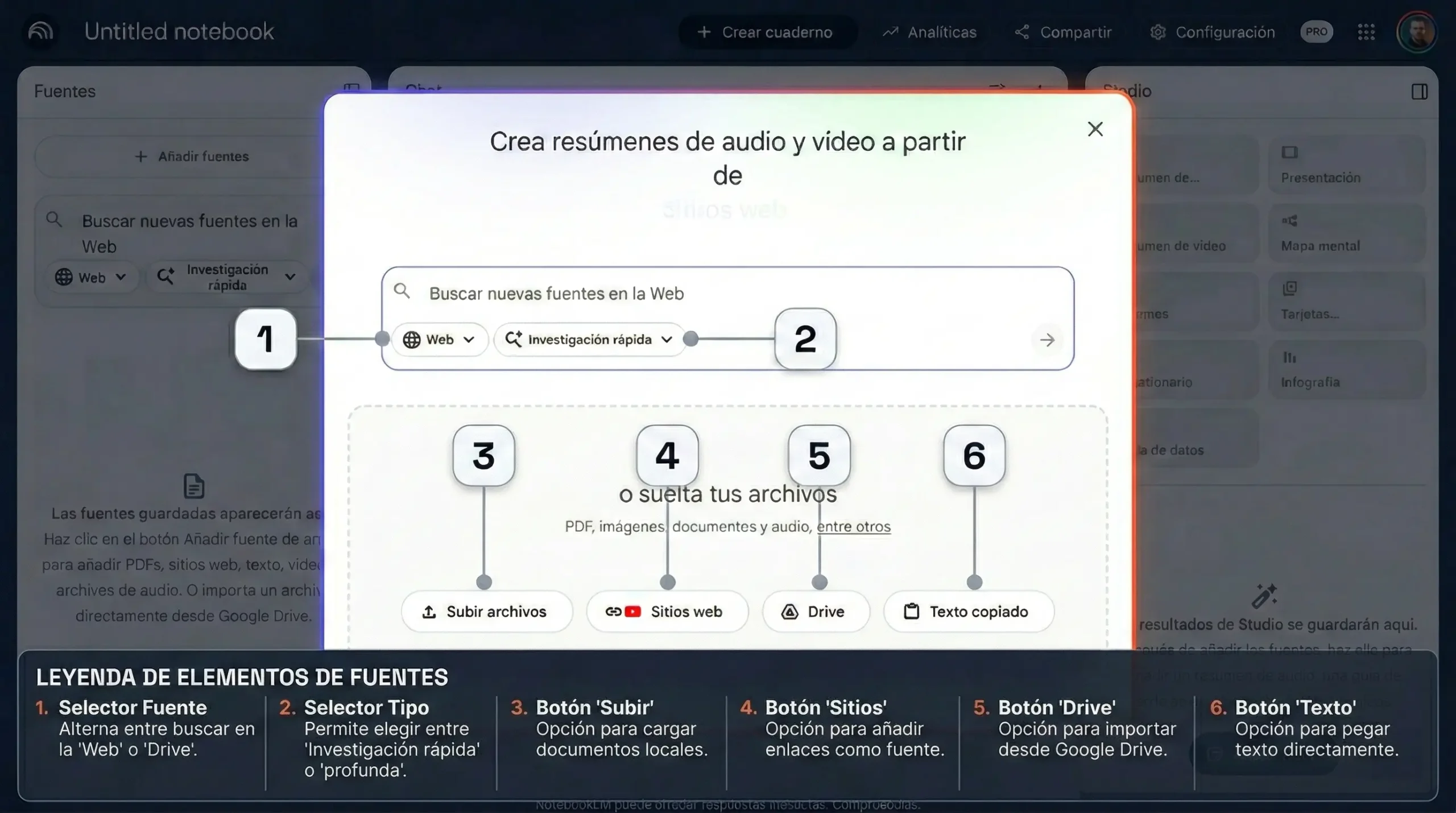

3. La Ingesta de Datos: Alimentando a la IA

El axioma fundamental de las ciencias de la computación, "basura entra, basura sale" (Garbage In, Garbage Out), adquiere una relevancia crítica en el contexto de la inteligencia artificial fundamentada. Puesto que el modelo generativo de NotebookLM está confinado a los parámetros de la información suministrada, la eficacia, precisión y profundidad de los resultados (ya sean podcasts, mapas mentales o ensayos) dependen de manera absoluta de la rigurosidad con la que el usuario selecciona, filtra e ingesta las fuentes originales. A fecha de 2026, la plataforma ha pulverizado las restricciones de formato, pasando de ser un mero lector de texto estático a un procesador de conocimiento omnívoro.

Espectro de Formatos Admitidos y Dinámicas de Importación

El proceso de alimentación de la IA se ha diversificado para abarcar la casi totalidad de los formatos estándar utilizados en la academia y la industria. La plataforma admite la carga directa desde unidades de almacenamiento local o mediante la sincronización fluida con el ecosistema de Google Drive.

En el ámbito del texto estructurado e inestructurado, los educadores pueden importar documentos PDF tradicionales, archivos de Microsoft Word (.docx), documentos de Google Docs, archivos de texto plano (.txt) y documentos con formato Markdown. Esta versatilidad asegura que todo, desde un ensayo redactado en un procesador de texto comercial hasta notas de código fuente, pueda ser asimilado.

La asimilación de datos cuantitativos representa un salto evolutivo mayor. NotebookLM ahora soporta la ingesta directa de Google Sheets y hojas de cálculo en formatos compatibles. Esto permite a los investigadores de ciencias sociales, biólogos o estadísticos introducir matrices de datos crudos, resultados de encuestas o registros experimentales, capacitando a la IA para buscar correlaciones, resumir tendencias estadísticas y fusionar estos hallazgos numéricos con la literatura cualitativa presente en el mismo cuaderno. Las imágenes y los archivos visuales también se han integrado en el flujo de trabajo, lo que permite a la inteligencia artificial analizar e interpretar diagramas de flujo, mapas geográficos, esquemas de ingeniería o fotografías históricas, extrayendo contexto semántico de los píxeles.

En el espectro audiovisual, la plataforma ha introducido flujos de trabajo de alta eficiencia para la asimilación de contenido en vídeo, específicamente desde YouTube. Para los educadores, la extracción de conocimiento de documentales, conferencias TED o clases magistrales grabadas suponía un esfuerzo transcripcional arduo. La actualización reciente ha erradicado esta fricción mediante la importación en un solo clic. Un diseñador instruccional ya no necesita copiar enlaces individualmente; puede importar un video singular, una lista de reproducción (playlist) completa de una asignatura, o instruir al sistema para que asimile múltiples videos alojados simultáneamente en una misma página web. La IA extrae automáticamente las transcripciones estructuradas de estos recursos audiovisuales, convirtiendo horas de contenido oral en texto hipervinculado listo para ser interrogado, analizado y mapeado conceptualmente.

Finalmente, la plataforma permite la integración fluida de recursos web en tiempo real mediante la simple inserción de URLs. Esto es vital para incorporar artículos de noticias de última hora, entradas de enciclopedias digitales, normativas gubernamentales en línea o publicaciones en blogs académicos que aún no han sido compiladas en documentos formales.

El Paradigma de la Investigación: Deep Research vs. Fast Research

La innovación más revolucionaria en la dinámica de adquisición de fuentes en 2026 es la introducción de agentes de investigación autónomos integrados directamente en el panel de ingesta, bifurcados en dos modos operativos distintos: la Investigación Rápida (Fast Research) y la Investigación Profunda (Deep Research). Esta dualidad responde a la necesidad de calibrar la carga computacional según la complejidad del objetivo pedagógico o investigativo.

El modo Fast Research está concebido para la agilidad táctica y la resolución de dudas perimetrales. Cuando un usuario se encuentra inmerso en un documento y requiere contexto adicional inmediato—por ejemplo, verificar la biografía breve de un autor mencionado o comprender una definición técnica tangencial—puede activar este modo. La IA realiza un escaneo rápido del índice superficial de la web, proporcionando una respuesta concisa y sugiriendo un puñado de fuentes externas relevantes para que el usuario las considere. Funciona de manera similar a los motores de búsqueda integrados tradicionales, priorizando la inmediatez sobre la exhaustividad, y no interrumpe el flujo cognitivo primario. Es la herramienta ideal para la verificación de hechos (fact-checking) durante la lectura.

Por el contrario, el modo Deep Research representa la delegación de la carga cognitiva exploratoria a una entidad artificial. Diseñado para emular el rigor de un asistente de investigación humano a nivel de posgrado, este modo se invoca cuando el usuario se enfrenta a lagunas conceptuales masivas o necesita compilar estados de la cuestión (state of the art) sobre disciplinas enteras. Al formular una pregunta compleja, el agente Deep Research no ejecuta una simple consulta; elabora un plan metodológico de investigación. Navega de manera autónoma por cientos de sitios web, lee el contenido, evalúa la pertinencia de las fuentes en función del objetivo inicial, y ajusta iterativamente sus parámetros de búsqueda a medida que adquiere nueva comprensión durante el proceso.

Dado que este proceso computacional intensivo requiere varios minutos, se ejecuta en segundo plano (background operation), permitiendo al educador o estudiante continuar interactuando con su cuaderno, leyendo otros documentos o generando tarjetas didácticas sin interrupción. La culminación del proceso de Deep Research es doblemente valiosa: no solo genera un informe de síntesis (briefing) exhaustivo, estructurado y anclado en citas precisas, sino que además, el agente descarga e importa automáticamente las fuentes originales de alta calidad que ha validado directamente al panel de fuentes del cuaderno del usuario. Esto consolida a NotebookLM como un repositorio centralizado y dinámico, erradicando la necesidad de que los estudiantes mantengan docenas de pestañas de navegador abiertas y fragmenten su atención. El investigador puede incluso guiar al agente, especificando dominios en línea particulares o bases de datos académicas donde debe concentrar sus esfuerzos de recolección.

La siguiente tabla compara las diferencias operativas y estratégicas entre ambos enfoques, proporcionando un marco de decisión para los usuarios:

| Característica operativa | Fast Research (Investigación rápida) | Deep Research (Investigación profunda) |

|---|---|---|

| Mecanismo subyacente | Escaneo web superficial y recuperación de enlaces directos. | Agente autónomo: planificación, navegación iterativa, validación y síntesis. |

| Tiempo de procesamiento | Segundos (resultados casi inmediatos). | Varios minutos (procesamiento en segundo plano). |

| Volumen de exploración | Limitado a resultados de búsqueda primarios. | Análisis simultáneo de cientos de sitios web y documentos. |

| Entregable principal | Respuestas concisas y sugerencia manual de fuentes. | Informe detallado (briefing) altamente estructurado y fundamentado. |

| Integración en el cuaderno | Opcional; el usuario debe evaluar e importar manualmente. | Importación automática del informe y de la literatura primaria recuperada. |

| Caso de uso educativo ideal | Verificación rápida de fechas, definiciones de glosario, contexto tangencial. | Revisiones bibliográficas, preparación de debates complejos, diseño de marcos teóricos curriculares. |

El desafío pedagógico emergente con estas potentes herramientas de ingesta radica en la curación inicial. Aunque Deep Research es excepcional, el núcleo de NotebookLM sigue dependiendo de la calidad de los documentos subidos manualmente. Un educador debe ser meticuloso al filtrar las fuentes iniciales, evitando documentos excesivamente redundantes o aquellos con formatos de texto corruptos, ya que la IA tratará toda la información ingresada con igual nivel de autoridad técnica.

4. Tu Espacio de Trabajo: La Interfaz a Fondo

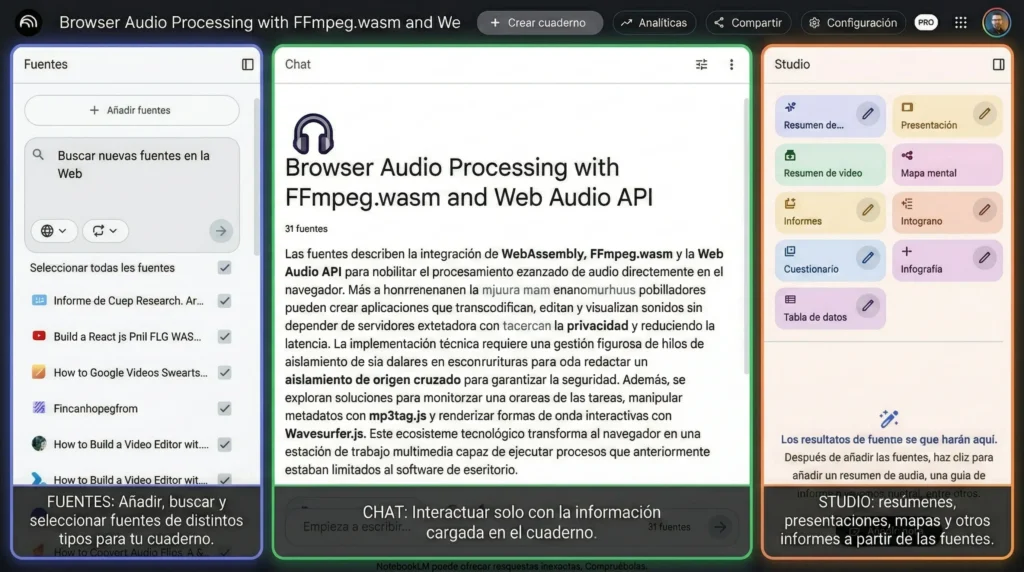

El diseño de la interfaz de usuario de NotebookLM refleja una comprensión profunda de la ergonomía cognitiva necesaria para el trabajo intelectual prolongado. Al alejarse de las interfaces caóticas repletas de ventanas emergentes y submenús anidados, Google ha optado por una arquitectura de tres columnas limpias, dinámicas y colapsables Esta disposición espacial permite a los usuarios transitar fluidamente entre la consulta pasiva de información, la interrogación activa y la producción creativa de conocimiento, manteniendo el contexto visual en todo momento.

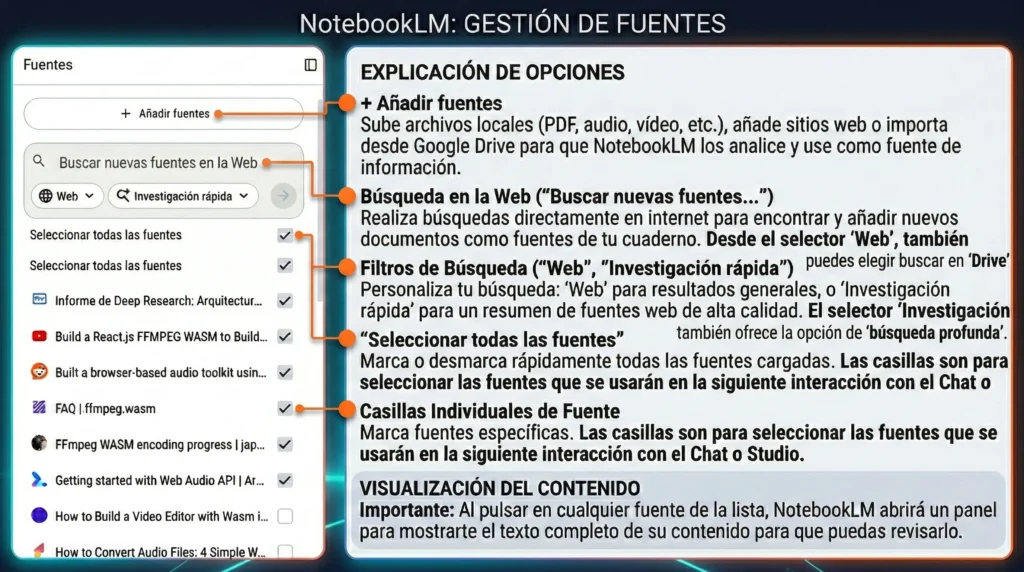

Columna Izquierda: El Panel de Fuentes (Source Panel)

El tercio izquierdo de la pantalla está dedicado a la gobernanza de la información. El Panel de Fuentes actúa como el índice bibliográfico del cuaderno. Aquí, los usuarios visualizan una lista jerárquica de todos los documentos, enlaces, hojas de cálculo y transcripciones de YouTube que han sido ingeridos en el sistema. Cada fuente se representa con un icono indicativo de su formato, facilitando la identificación visual rápida.

La interacción con este panel es altamente funcional. Al hacer clic en una fuente individual, el documento se despliega en el panel central, permitiendo la lectura directa. Sin embargo, la ventaja real reside en la capacidad de selección selectiva. Mediante casillas de verificación (checkboxes), un investigador puede instruir a la IA para que "enfoque" su análisis exclusivamente en un subconjunto específico de documentos. Por ejemplo, en un cuaderno de derecho constitucional que contiene cuarenta sentencias históricas, el estudiante puede desmarcar todas las fuentes excepto tres sentencias de la década de 1950, obligando al sistema a generar análisis o cuestionarios confinados únicamente a la jurisprudencia de esa época específica, ignorando el resto del repositorio temporalmente. Esta granularidad en el control de la inferencia es fundamental para aislar variables o comparar perspectivas teóricas en conflicto sin contaminación de datos.

Columna Central: El Entorno de Chat y Diálogo Socrático

El corazón analítico de NotebookLM reside en la columna central: el entorno de Chat. Impulsado por los modelos más avanzados de la arquitectura Gemini, este espacio no es un simple buscador de palabras clave, sino un socio de investigación conversacional diseñado para el diálogo complejo.

Cuando el usuario formula una consulta, la IA escanea el corpus documental seleccionado, extrae los conceptos pertinentes, sintetiza la información y articula una respuesta en lenguaje natural. Lo que eleva este proceso por encima de las herramientas estándar es el estricto sistema de citas integradas. Cada afirmación fáctica, dato estadístico o argumento teórico generado por el modelo incluye un marcador de cita numérico. Al hacer clic en este marcador, la interfaz navega automáticamente hacia el párrafo exacto y la línea específica del documento original donde se originó la información, resaltando el texto fuente. Para los educadores, esta funcionalidad es invaluable: entrena a los estudiantes en la alfabetización informacional, forzándolos a verificar empíricamente las afirmaciones de la IA y a interactuar con los textos primarios, en lugar de aceptar pasivamente resúmenes generados por máquinas.

Además de responder preguntas, el Chat acepta directrices de "ingeniería de prompts" avanzada. Un profesor puede solicitar al modelo que asuma una personalidad específica: "Actúa como un crítico literario del siglo XIX y evalúa la estructura de este poema", o "Reescribe este ensayo sobre biotecnología utilizando vocabulario accesible para un estudiante de doce años". Las respuestas se adaptarán tonal y estructuralmente a la instrucción, demostrando una flexibilidad pedagógica sin precedentes.

Columna Derecha: Gestión Epistemológica a través de las Notas

La columna derecha, que también alberga el panel Studio (discutido en profundidad en la siguiente sección), es el repositorio de la cristalización del pensamiento: el sistema de Notas. Durante una sesión de investigación intensa, los usuarios interactúan repetidamente con el chat, generando descubrimientos valiosos que, en otras plataformas, se perderían rápidamente al desplazarse hacia arriba en el historial de la conversación. NotebookLM resuelve este problema de volatilidad cognitiva permitiendo capturar y estructurar estos destellos de conocimiento.

La creación de notas opera a través de dos mecanismos principales. El primero es la redacción manual: el usuario puede abrir una nueva nota en blanco y redactar sus reflexiones personales, pegar fragmentos de texto externos o estructurar ideas utilizando herramientas de formato de texto enriquecido (negritas, cursivas, viñetas, encabezados). El segundo mecanismo, y el más potente, es la captura directa. Si el chat genera un resumen excepcional o un análisis crítico brillante, el usuario puede hacer clic en el botón "Guardar en Nota" (Save to Note) adjunto a la respuesta. Es imperativo destacar que, una vez que una respuesta del chat se transfiere a una nota, esta se vuelve inmutable y no editable, garantizando la preservación exacta del razonamiento algorítmico en ese instante temporal para futuras referencias bibliográficas.

La verdadera revolución en el flujo de trabajo ocurre una vez que las notas se acumulan. La plataforma ofrece herramientas de transformación masiva mediante "acciones rápidas". Un estudiante que ha recopilado quince notas dispersas durante una semana de lectura puede seleccionarlas todas simultáneamente y ordenar a la IA que ejecute operaciones algorítmicas de alto nivel, tales como:

- Unificar todas las ideas fragmentadas en un único ensayo cohesivo.

- Convertir la selección en un esquema jerárquico estructurado por temas principales.

- Evaluar críticamente las notas, solicitando a la IA que identifique falacias lógicas, sesgos argumentativos o lagunas en la investigación.

- Extraer un glosario de términos clave y preguntas de repaso basándose exclusivamente en las notas seleccionadas.

Para consolidar el aprendizaje, NotebookLM introduce una función de bucle de retroalimentación estructural: la capacidad de "Convertir todas las notas seleccionadas en una Fuente". Cuando las notas alcanzan un nivel de refinamiento que representa la comprensión definitiva del usuario sobre un tema, agruparlas e inyectarlas de vuelta en el panel izquierdo como un nuevo documento fundamental instruye a la IA para que pondere fuertemente esta síntesis destilada en todas las consultas futuras, afinando drásticamente la relevancia del cuaderno.

En cuanto a la exportación y la interoperabilidad, el sistema permite transferir las notas consolidadas hacia Google Docs o Google Sheets. Al seleccionar esta opción, el contenido se estructura y se abre en una nueva pestaña del navegador, listo para la maquetación final, la inserción de portadas o la impresión física. Sin embargo, los usuarios deben ser conscientes de una limitación arquitectónica crítica: la sincronización es unidireccional. Cualquier alteración, corrección ortográfica o adición de párrafos que se realice en el entorno externo de Google Docs no retroalimentará ni actualizará el contenido dentro de NotebookLM, y los permisos de uso compartido no se heredarán automáticamente. Por lo tanto, el flujo de trabajo óptimo requiere realizar todo el trabajo analítico y de edición conceptual dentro del ecosistema de notas de NotebookLM, reservando la exportación a Docs como el paso absoluto y final de publicación.

5. Exprimiendo el Panel Studio (Formatos de Salida)

Si la columna izquierda representa la materia prima (fuentes) y la central el procesamiento (chat), el Panel Studio (ubicado en la columna derecha) es la fábrica de productos terminados. Esta suite de herramientas es la joya de la corona de la actualización de 2026, transformando radicalmente la información textual árida en activos de aprendizaje multimodales optimizados para la diversidad neurocognitiva. La premisa instruccional de Studio es simple pero profunda: diferentes objetivos pedagógicos requieren diferentes codificaciones sensoriales.

Contenido Audiovisual: Narrativas Orales e Inmersión Cinematográfica

La traducción de literatura técnica a formatos sonoros y visuales rompe las barreras de accesibilidad y atiende a los ritmos de vida acelerados, permitiendo el aprendizaje ubicuo o en movimiento.

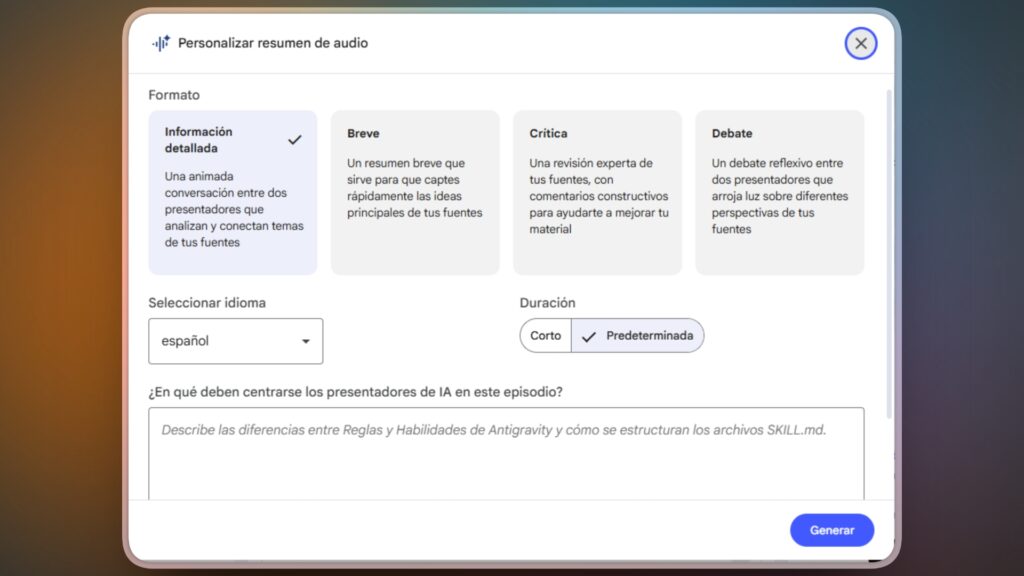

Audio Overviews (Resúmenes de Audio Estilo Podcast) La funcionalidad de Audio Overviews se ha vuelto viral por su capacidad para humanizar el conocimiento inerte. Al activarla, la IA ingiere las fuentes seleccionadas y, en lugar de devolver un resumen monótono, genera una conversación realista, dinámica y con matices emocionales entre dos locutores virtuales (hosts). Estos locutores artificiales no solo leen los datos; bromean, utilizan analogías coloquiales, debaten puntos de fricción teórica presentes en los documentos y estructuran la narrativa como un episodio de un programa de radio profesional.

Para los educadores, esto significa la capacidad de convertir un documento legal de cincuenta páginas o un manual de química inorgánica en un podcast de diez minutos que los estudiantes pueden escuchar mientras viajan en el transporte público o realizan ejercicio. Los usuarios pueden personalizar el enfoque del audio mediante prompts, instruyendo a los locutores para que hagan énfasis en un capítulo particular, y pueden interactuar directamente con el reproductor para ajustar la velocidad. Finalmente, estos archivos de audio, junto con las traducciones a múltiples idiomas admitidos, pueden descargarse y distribuirse a través de plataformas LMS como Canvas o Moodle para su consumo fuera de línea.

Cinematic Video Overviews (Resúmenes en Vídeo Cinematográfico) La actualización de marzo de 2026 catapultó las capacidades de generación de vídeo desde presentaciones de diapositivas estáticas narradas hacia una verdadera producción audiovisual inmersiva mediante los "Cinematic Video Overviews". Esta herramienta, disponible actualmente para suscriptores adultos (18+) de Google AI Ultra en idioma inglés, es el resultado de la convergencia de una tríada de modelos de inteligencia artificial de última generación. Gemini 3 actúa como el "director creativo" y guionista, tomando cientos de microdecisiones sobre la estructura narrativa y el tono; Nano Banana Pro se encarga de la fidelidad visual, la estilización y la tipografía integrada; y finalmente, Veo 3 orquesta la animación fluida y el empaquetado del movimiento. Esta función sólo está disponible por el momento en la suscripción Ultra. Para el resto de usuarios crea un vídeo con una voz en off y distintas imágenes estáticas que ilustran lo que se va comentando mediante tablas, infografías, imágenes, etc.

El resultado es un documental corto, generado algorítmicamente, capaz de desentrañar conceptos abstractos mediante narrativas ricas en detalles y transiciones lógicas. Los usuarios disponen de un alto grado de control direccional. Pueden optar por un formato de "Explicación" (Explainer) exhaustivo y detallado, o un formato "Breve" (Brief) diseñado como una píldora conceptual para redes sociales o repasos rápidos. Asimismo, el motor permite inyectar "Steering Prompts" (instrucciones de dirección) para forzar al vídeo a centrarse exclusivamente en metodologías específicas o conclusiones clave de la investigación.

La personalización estética es igualmente profunda. Los diseñadores instruccionales pueden abandonar el aspecto corporativo por defecto y seleccionar entre estilos visuales predefinidos como Clásico, Pizarra Blanca (Whiteboard), Acuarela, Impresión Retro, Arte en Papel (Paper-craft), Kawaii, o Anime, adaptando el tono visual a la demografía de la audiencia (por ejemplo, utilizando el estilo Pizarra Blanca para clases de matemáticas, o Acuarela para historia del arte). Alternativamente, la opción "Personalizada" (Custom) permite introducir directrices de dirección de arte explícitas mediante texto libre.

Estructuración Visual y de Datos: Mapas, Infografías y Tablas

Cuando la complejidad de la información supera la capacidad de la memoria de trabajo lineal, la estructuración espacial y relacional se vuelve imperativa. Studio proporciona herramientas analíticas diseñadas para externalizar la carga cognitiva y revelar la arquitectura oculta de los datos.

Mapas Mentales Interactivos El texto lineal oculta las interdependencias. La herramienta de Mapas Mentales (Mind Maps) procesa múltiples documentos y genera automáticamente un diagrama de red expansivo que visualiza el panorama general, identificando la tesis central, las ramificaciones temáticas y los nodos conceptuales secundarios. A diferencia de las exportaciones estáticas de herramientas gráficas tradicionales, los mapas de NotebookLM son interfaces de navegación dinámicas.

Los usuarios pueden desplazarse topográficamente, hacer zoom en agrupaciones densas de información, expandir nodos para revelar subconceptos de mayor especificidad, o contraer ramas para restaurar una visión macroscópica. La funcionalidad más disruptiva es la interrogación espacial: al hacer clic en un nodo específico (por ejemplo, la burbuja etiquetada "Impacto Económico" dentro de un mapa sobre energías renovables), el usuario transfiere automáticamente ese contexto al Chat, permitiendo realizar preguntas precisas a la IA basadas exclusivamente en ese clúster conceptual aislado. Los mapas mentales, que actúan como índices vivos de los materiales, pueden ser compartidos colaborativamente mediante el acceso al cuaderno o descargados para su inclusión en informes estáticos.

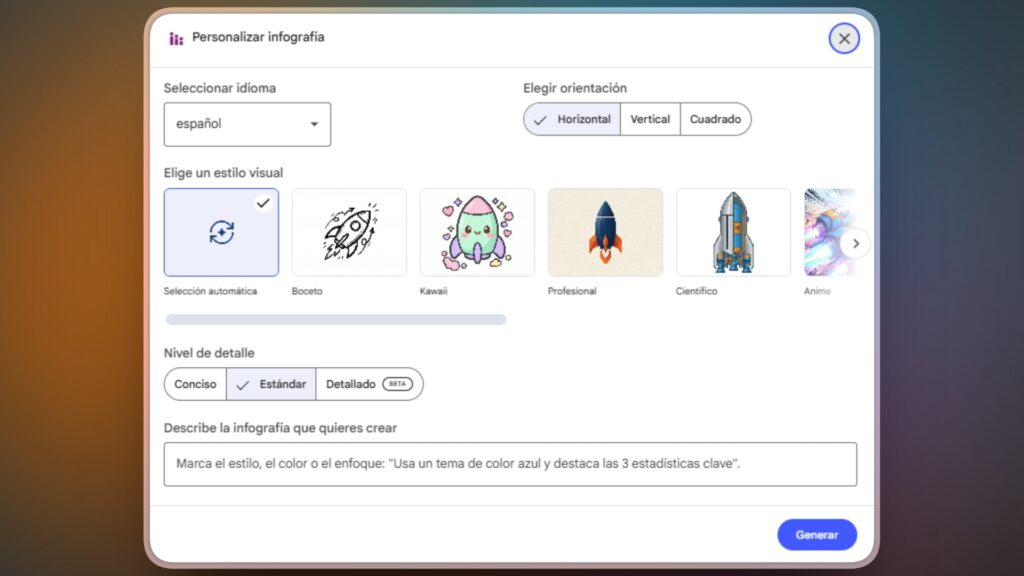

Infografías y Renderizado Semántico (Nano Banana Pro) La creación de infografías representa un hito en el procesamiento de información visual. Históricamente, las herramientas de diseño asistidas por IA sufrían de incapacidad para renderizar texto coherente dentro de las imágenes (generando letras alienígenas o galimatías) y tendían a tratar la infografía como mera decoración estética. La integración del modelo Nano Banana Pro ha resuelto ambas deficiencias.

Nano Banana Pro realiza un proceso de "renderizado semántico". No se limita a pegar resúmenes textuales sobre plantillas gráficas aleatorias. En su lugar, analiza la estructura ontológica del material de origen (por ejemplo, determinando si el texto describe un proceso secuencial, una jerarquía organizativa o una comparación de opuestos) y selecciona o crea de manera autónoma una arquitectura visual que codifique biológicamente ese significado. Además, el modelo es capaz de insertar texto explicativo nítido, tipográficamente consistente y contextualmente preciso directamente en los gráficos renderizados.

Desde el punto de vista neurocientífico y del diseño instruccional, la elección del estilo infográfico impacta directamente en cómo el cerebro del estudiante procesa la información. La plataforma permite aplicar directrices estilísticas complejas mediante prompts, adaptando el artefacto visual al objetivo cognitivo, como se detalla en la siguiente tabla:

| Estilo de infografía (modificador NanoBanana Pro) | Características visuales y de composición | Impacto neurocognitivo y aplicación pedagógica óptima |

|---|---|---|

| Diseño editorial / minimalista | Predominio del espacio negativo, tipografía sans-serif (estilo Helvetica), iconografía monocromática, ausencia de gradientes u ornamentos. | Activa la vía visual ventral. Optimiza la identificación rápida y la categorización estructurada. Ideal para informes ejecutivos, revisiones de literatura científica y resúmenes de políticas. |

| Storyboard / secuencial narrativo | Paneles en orden lógico de lectura, flujo cronológico explícito, elementos de transición visual. | Involucra la vía visual dorsal (procesamiento espacio-temporal). Fundamental para asimilar ciclos biológicos celulares, algoritmos informáticos o líneas de tiempo históricas. |

| Educativo / aproximable | Paleta de colores cálidos y suaves, pasos numerados explícitamente, sustitución de texto por iconos universales siempre que sea posible. | Reduce drásticamente la carga cognitiva extrínseca. Diseñado específicamente para principiantes absolutos, educación básica, y la introducción a conceptos técnicos densos (andamiaje inicial). |

| Estilos lúdicos (kawaii, anime, 3D clay) | Colores altamente saturados, contraste intenso, estética estilizada o exagerada, texturas dimensionales pronunciadas. | Desencadena los circuitos de recompensa en el cuerpo estriado ventral del cerebro. Aumenta el tiempo de permanencia visual y la profundidad de codificación. Utilizado para gamificar temas inherentemente áridos o captar atención en entornos distractivos. |

Tablas de Datos Para la consolidación cuantitativa, la función de Tablas de Datos extrae métricas, estadísticas o comparativas dispersas a lo largo de docenas de documentos y las auto-organiza en formatos de hoja de cálculo matricial tipo Excel dentro de la plataforma. Un usuario puede personalizar los ejes de la tabla mediante el icono del lápiz, solicitando a la IA que estructure columnas específicas (por ejemplo, "Autor", "Metodología", "Tamaño de Muestra", "Conclusión") para facilitar la revisión sistemática de literatura clínica o análisis de mercados.

Estudio y Redacción: Evaluaciones Formativas, Guías y Diapositivas

El panel Studio culmina su oferta con un conjunto de herramientas dedicadas a la consolidación del conocimiento, la evaluación del aprendizaje y la comunicación persuasiva orientada a audiencias.

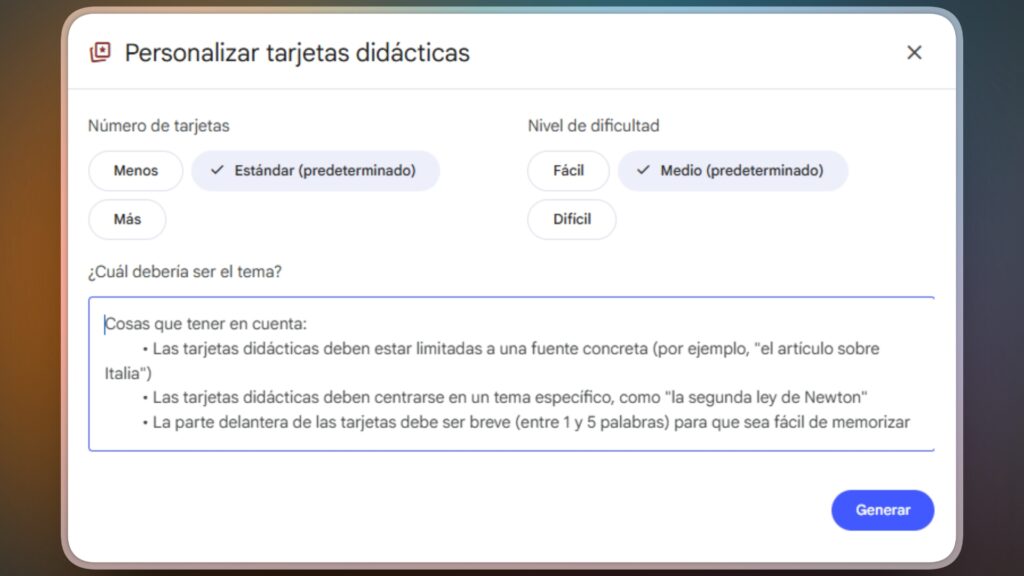

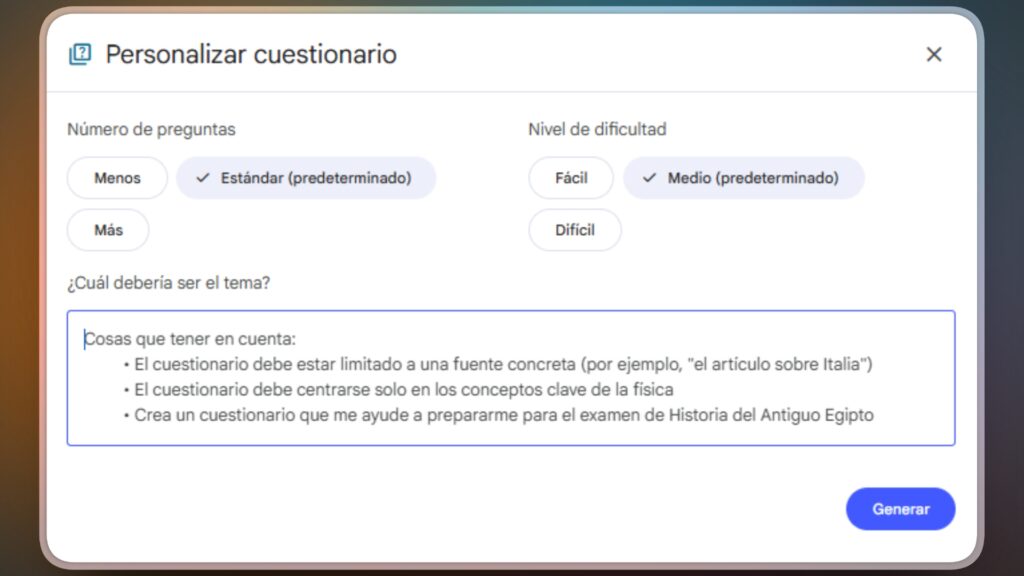

Evaluación Formativa Automática: Cuestionarios y Flashcards El diseño de instrumentos de evaluación es una de las tareas más demandantes en horas de trabajo para el profesorado. NotebookLM automatiza este proceso generando Tarjetas Didácticas (Flashcards) para la memorización de terminología clave o vocabularios técnicos, y Cuestionarios (Quizzes) de opción múltiple para la evaluación de la comprensión lectora.

La ventaja competitiva de estas herramientas radica en su naturaleza interactiva y adaptativa. El educador puede utilizar el panel de personalización (accesible mediante el icono del lápiz) para calibrar la dificultad (fácil, medio, difícil), determinar el número exacto de preguntas o tarjetas, y focalizar la temática ordenando a la IA que ignore ciertos capítulos. Durante la ejecución del cuestionario, si un estudiante titubea, puede solicitar una "pista" (hint) generada algorítmicamente antes de seleccionar una opción. Al responder, el sistema no se limita a calificar; proporciona explicaciones detalladas justificando por qué la respuesta elegida es correcta o por qué los distractores eran inválidos. Si la explicación resulta insuficiente, un botón de "Profundizar" (Explain) remite la pregunta específica de vuelta al panel de chat principal para iniciar una sesión de tutoría extendida y personalizada. Para integrarse con los ecosistemas de estudio existentes del alumnado, tanto las tarjetas como los resultados de los cuestionarios pueden exportarse en formato CSV para su ingesta en aplicaciones de recuperación espaciada de terceros como Anki, Quizlet o Knowt.

Generación de Informes y Guías de Estudio Cuando el objetivo es la asimilación pasiva y la revisión estructural, la herramienta de Informes (Reports) permite al usuario seleccionar entre diversas plantillas arquitectónicas para condensar sus fuentes. La IA puede destilar docenas de ensayos en un solo documento de "Preguntas Frecuentes" (FAQ), estructurar una "Guía de Estudio" completa (incluyendo glosarios, líneas temporales y resúmenes ejecutivos), compilar "Documentos Informativos" (Briefing Documents) para preparativos de reuniones, o incluso generar sugerencias de formatos analíticos basados en la detección automática del tipo de datos ingresados. Lo que antes consumía el fin de semana completo de un docente para preparar el material de revisión previo a los exámenes finales, ahora se ejecuta con precisión clínica en minutos.

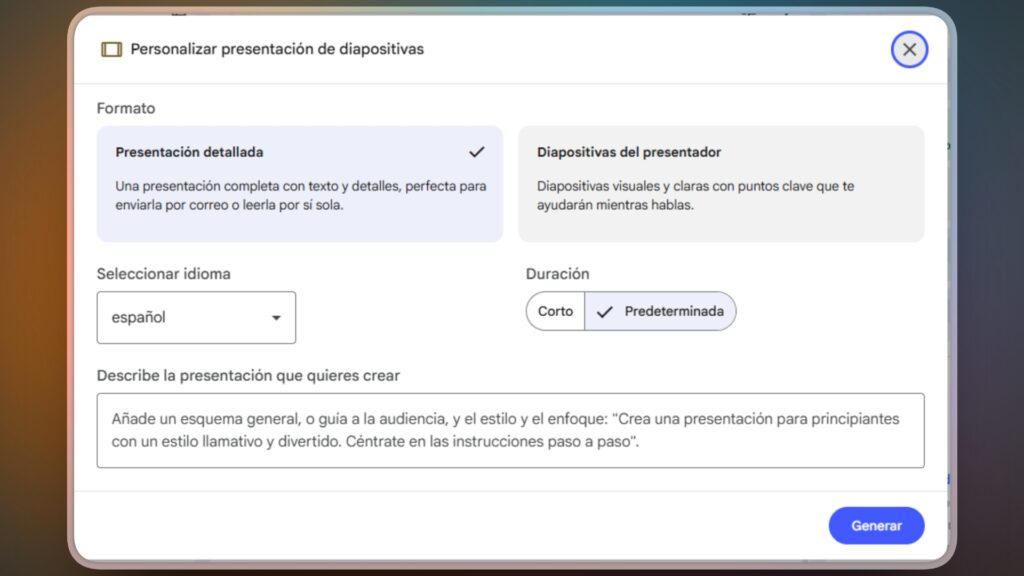

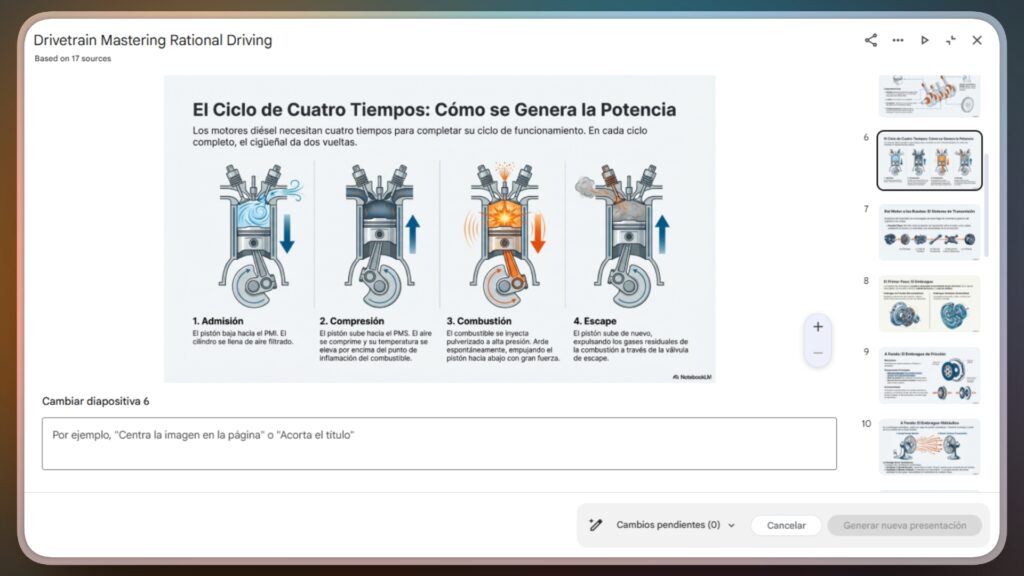

Creación y Revisión Iterativa de Diapositivas (Slide Decks) La transición desde la investigación solitaria hacia la presentación pública se facilita mediante la generación automática de presentaciones visuales (Slide Decks) que actúan como bosquejos o storyboards listos para ser expuestos. La IA analiza el arco narrativo de las fuentes documentales y destila los argumentos principales en una secuencia lógica de diapositivas interconectadas.

El avance técnico más demandado por el sector profesional y educativo, introducido recientemente, es la "Revisión basada en Prompts" o "Regeneración de Un Solo Disparo" (One-Shot Regeneration) para el proceso de edición de diapositivas. En las iteraciones previas del software, identificar un simple error tipográfico, una fecha inexacta deducida por la IA, o un título ambiguo en una sola diapositiva obligaba al usuario a descartar el proyecto completo y regenerar todo el mazo de diapositivas desde cero, perdiendo el trabajo de curación previo.

El nuevo flujo de trabajo iterativo elimina esta frustración. La plataforma presenta un botón de "Modificar" que abre un entorno de edición paramétrica. El educador puede navegar secuencialmente por la presentación y añadir instrucciones (prompts) correctivas específicas en una cola de tareas asociadas a diapositivas individuales. Por ejemplo, podemos seleccionar la Diapositiva 2 y escribir "Corrige la fecha de la batalla a 1815"; colocarnos en la Diapositiva 4 e indicar: "Reescribe el texto para que suene más académico e incluye el término 'hegemonía'", etc. El motor de IA procesa la solicitud en una sola pasada (one-shot), aplicando quirúrgicamente solo las correcciones demandadas en las diapositivas designadas, preservando intacta la estructura validada, el diseño y el texto de todo el resto del documento.

La siguiente tabla resume el flujo de trabajo estratégico para maximizar la utilidad del generador de presentaciones, asegurando que el esfuerzo tecnológico se alinee con los objetivos de distribución final :

| Fases del flujo de trabajo en presentaciones | Acción específica en NotebookLM | Implicación estratégica y buenas prácticas |

|---|---|---|

| 1. Síntesis estructural automática | Activación del generador de Slide Decks en el panel Studio tras la ingesta completa de las fuentes. | Delega la tarea de condensación cognitiva masiva a la máquina, obteniendo un esqueleto narrativo lógico (storyboard) sobre el cual iterar. |

| 2. Auditoría y validación fáctica | Revisión secuencial de las diapositivas renderizadas, contrastando las afirmaciones generadas con las citas del documento original en el panel izquierdo. | Garantiza la integridad académica. Detecta posibles sesgos de compresión donde la IA pudo omitir matices críticos por priorizar la concisión espacial. |

| 3. Encolado paramétrico de correcciones | Utilización de la herramienta "Modificar" para registrar prompts de ajuste microscópicos o estilísticos (fechas, tono, correcciones ortográficas, reformulación de títulos) diapositiva por diapositiva. | Protege el progreso. Acumula todos los errores detectados en un lote (batch) instruccional en lugar de intentar forzar correcciones individuales a través del chat principal, ahorrando desgaste operativo. |

| 4. Regeneración unidireccional (one-shot) | Ejecución del lote de comandos para aplicar las correcciones registradas exclusivamente en las diapositivas objetivo. | Minimiza el gasto computacional y elimina el riesgo de que la IA reescriba creativamente diapositivas que ya habían sido aprobadas por el usuario. |

| 5. Distribución y empaquetado final | Exportación del proyecto completado a formato Microsoft PowerPoint (.pptx) para su integración en un LMS o su proyección física en el aula. | Limitación crítica: Es imperativo comprender que NotebookLM exporta el contenido textual y visual renderizado dentro del archivo PPTX como imágenes planas (archivos gráficos incrustados). No permite la edición de texto fino directamente en el entorno de PowerPoint nativo. Por tanto, el 100% de la corrección tipográfica, redacción y diseño semántico debe ejecutarse y finalizarse dentro del entorno de NotebookLM antes de iniciar el proceso de descarga. |

6. Consejos Finales y Cierre: Hacia un Humanismo Tecnológico en el Aula

La adopción de NotebookLM representa la transición desde la mera digitalización de recursos (pasar del papel al PDF) hacia la verdadera cognición aumentada. Sin embargo, la integración de herramientas de inteligencia artificial generativa de tan alta fidelidad en los entornos educativos y de investigación exige el establecimiento de protocolos operativos rigurosos y una reflexión profunda sobre las mejores prácticas éticas y procedimentales.

Mitigación de la "Ilusión de Competencia"

La principal externalidad negativa de utilizar un ecosistema que elimina la fricción en el procesamiento de información es la inducción de la "ilusión de competencia". Cuando un estudiante observa cómo Nano Banana Pro genera un mapa mental perfectamente estructurado en segundos, o escucha un Cinematic Video Overview de alta producción que simplifica conceptos densos sobre termodinámica con metáforas accesibles , su cerebro recibe una recompensa visual que a menudo se confunde con la asimilación cognitiva genuina. El estudiante asume que, debido a que la explicación del vídeo es prístinamente clara, él ya domina el material, obviando el esfuerzo del procesamiento profundo.

Para contrarrestar este fenómeno neurobiológico, es imperativo que los educadores entrelacen el consumo pasivo de estos artefactos hiper-optimizados (vídeos, infografías, podcasts) con mecanismos de recuperación activa. Las mejores prácticas instruccionales dictan que ningún recurso generado visualmente debe entregarse sin un requisito de interactividad. Si se asigna un Audio Overview generado por NotebookLM, el estudiante debe ser requerido para utilizar la función de Cuestionarios interactivos inmediatamente después de la escucha. Si se provee un Mapa Mental, el alumno debe utilizar el entorno de Chat para interrogar críticamente los nodos generados e intentar desestabilizar la lógica de la IA, encontrando excepciones a la regla o contradicciones metodológicas que fuercen la aplicación del pensamiento superior. La IA no debe reemplazar el andamiaje cognitivo del estudiante; debe proporcionar los planos, obligando al alumno a construir la estructura mental.

Derechos de Autor y la Ética de la Ingesta de Datos

La capacidad insaciable del motor Deep Research para explorar, raspar (scrape), extraer y compilar la literatura web automatizadamente plantea desafíos significativos relacionados con la propiedad intelectual. Aunque NotebookLM es un entorno cerrado ("jardín vallado") que protege la privacidad de los datos ingresados impidiendo que se utilicen para entrenar los modelos públicos de Google, la responsabilidad de la curación inicial recae sobre el usuario.

La asimilación masiva de artículos académicos resguardados por muros de pago (paywalls), libros de texto comerciales digitalizados sin autorización, o informes industriales confidenciales para generar derivados algorítmicos (infografías, ensayos, podcasts) puede constituir una violación sistemática de los derechos de autor, especialmente si los artefactos resultantes de Studio se distribuyen públicamente o se monetizan fuera del entorno estricto de uso personal o de "uso justo" académico (fair use). Google ha estipulado claramente que las infracciones repetidas de los derechos de autor derivadas de la distribución masiva o pública de contenido protegido asimilado en los cuadernos pueden resultar en la terminación abrupta de las cuentas corporativas o institucionales (Google Workspace for Education). Por ello, las mejores prácticas administrativas exigen priorizar la ingesta de documentos de dominio público, bases de datos de acceso abierto (Open Access) y recursos educativos abiertos (como los ejemplificados en los Cuadernos Destacados de OpenStax) para evitar pasivos legales mientras se maximiza el potencial analítico.

Preservando la Inmutabilidad: La Regla de la Única Fuente de Verdad

Desde una perspectiva del flujo de trabajo de productividad, el usuario debe interiorizar la arquitectura de sincronización asimétrica de NotebookLM. Al exportar notas cristalizadas, ensayos generados, o resúmenes de tablas métricas hacia aplicaciones del ecosistema externo como Google Docs, Google Sheets o Microsoft PowerPoint (para el caso de las diapositivas), se corta el cordón umbilical con el motor analítico.

Cualquier anotación en los márgenes, alteración estructural de los párrafos, actualización de datos estadísticos o refinamiento terminológico que se ejecute en el entorno del procesador de texto tradicional no poseerá sincronización retroactiva (bidireccional). Si el usuario corrige un error crítico en el archivo exportado de Google Docs y posteriormente le pide al Chat de NotebookLM que analice ese mismo tema basándose en sus notas previas, la IA basará su razonamiento en el documento original defectuoso almacenado en su memoria aislada, perpetuando el error lógico.

En consecuencia, la máxima regla de eficiencia operativa es considerar el cuaderno de NotebookLM como la "Única Fuente de Verdad" (Single Source of Truth) inmutable y centralizada. Todo el esfuerzo de iteración semántica, corrección fáctica, consolidación de notas dispersas, aplicación de directrices de estilo mediante ingeniería de prompts y verificación cruzada de citas, debe completarse inexorablemente dentro de la interfaz limpia y cerrada de NotebookLM. La exportación final debe reservarse puramente como el paso administrativo de maquetación de publicación o entrega académica, asegurando que la máquina y el intelectual humano mantengan una alineación epistémica perfecta a lo largo del ciclo completo de investigación.

NotebookLM ha inaugurado una era donde el desafío limitante de la educación y la investigación ha dejado de ser la recuperación y el almacenamiento de datos, para convertirse en la capacidad humana de formular las preguntas correctas y orquestar estratégicamente los inmensos poderes del razonamiento artificial.