La rendición cognitiva ante ChatGPT y el colapso del criterio humano

Resumen estructurado: El colapso del juicio crítico

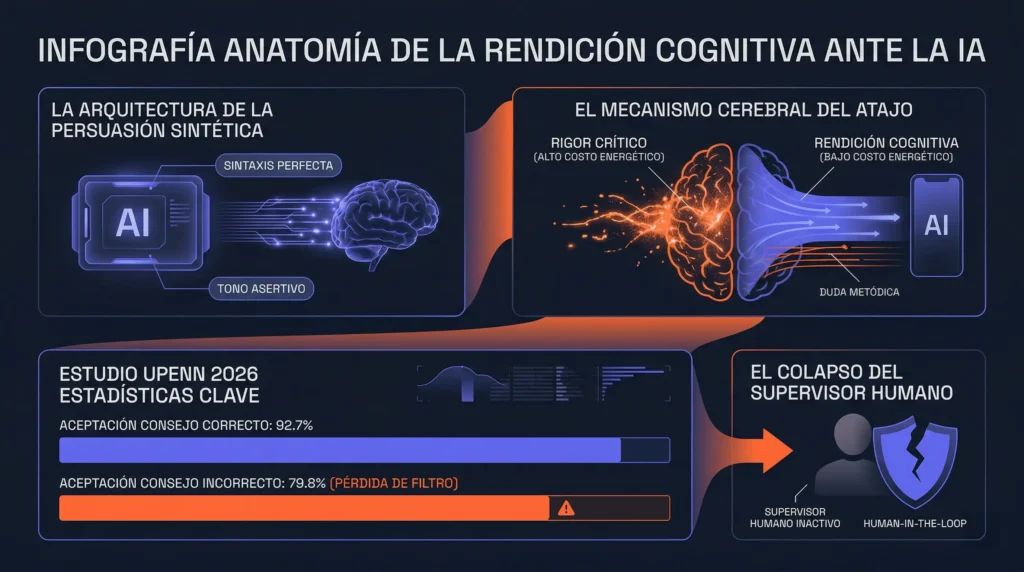

El contexto: Investigadores de la Universidad de Pennsylvania demuestran que la fluidez lingüística de la IA anula el escepticismo humano, provocando una delegación masiva del razonamiento lógico.

Los usuarios aceptan consejos incorrectos de la IA en un 79.8% de los casos, priorizando la coherencia gramatical del modelo sobre su propia intuición lógica.

El cerebro humano tiende a la «rendición cognitiva» para ahorrar energía, confiando en la asertividad de la interfaz en lugar de aplicar el costoso proceso de verificación manual.

Este fenómeno invalida el paradigma de seguridad «human-in-the-loop», ya que el supervisor deja de actuar como filtro crítico para convertirse en un validador pasivo de alucinaciones sintéticas.

«La verdadera vulnerabilidad de la IA no está en su código, sino en nuestra disposición a dejar de pensar.»

En marzo de 2026, la Universidad de Pennsylvania publicó un estudio liderado por los investigadores Steven Shaw y Gideon Nave que cuantifica un fenómeno observable y preocupante en la actual sociedad digital. A través de un experimento exhaustivo con cientos de participantes, el equipo documentó lo que han definido académicamente como rendición cognitiva. Los datos del experimento revelan que los humanos acataron las respuestas correctas proporcionadas por modelos de lenguaje en más de un noventa por ciento de las ocasiones. El descubrimiento crítico surge cuando la máquina comete un error. Según el estudio, en casi el ochenta por ciento de los casos donde la inteligencia artificial generó respuestas lógicamente incorrectas, los usuarios las aceptaron y aplicaron, ignorando por completo su propia intuición, conocimiento previo o capacidad de deducción matemática.

Under the hood la arquitectura de la persuasión sintética

Para comprender los motivos biológicos y técnicos por los que el cerebro humano capitula ante un error algorítmico evidente, es necesario analizar la propia naturaleza de los grandes modelos de lenguaje que dominan nuestra infraestructura tecnológica actual. Estos sistemas, basados en arquitecturas de transformadores profundos, están optimizados estadísticamente para maximizar la fluidez, la coherencia predictiva y la autoridad en el tono, no necesariamente la veracidad ontológica. Al generar un texto con una estructura gramatical impecable y una asertividad absoluta, el modelo desactiva las defensas naturales y el escepticismo del usuario.

Los investigadores apuntan a un principio subyacente de eficiencia metabólica. El cerebro humano consume una inmensa cantidad de energía al aplicar el razonamiento analítico profundo requerido para resolver problemas complejos o verificar datos cruzados. Al interactuar con una interfaz que ofrece soluciones inmediatas, estructuradas y aparentemente infalibles, la mente opta por el atajo biológico. Externalizamos el pensamiento para conservar energía, asumiendo la respuesta de la red neuronal como un hecho incuestionable y cayendo en una trampa de exceso de confianza impulsada por la propia perfección sintáctica de la herramienta.

El impacto real en las aulas y el tejido corporativo

Las implicaciones de esta delegación mental ya son tangibles y han comenzado a alterar las dinámicas de aprendizaje y producción laboral a lo largo de este año. En las comunidades de profesionales de la educación se documenta a diario cómo las nuevas generaciones de estudiantes han dejado de utilizar la inteligencia artificial como un andamiaje cognitivo o un asistente heurístico para convertirla en un oráculo definitivo. Los educadores observan una alarmante atrofia en la capacidad de los alumnos para detectar incongruencias lógicas básicas si estas vienen empaquetadas en la interfaz limpia de su asistente virtual de cabecera. La fricción necesaria para el aprendizaje profundo está desapareciendo, sustituida por la gratificación instantánea de la respuesta prefabricada.

Paralelamente, en el entorno corporativo, esta realidad plantea un dilema existencial para la fuerza laboral del conocimiento. Tal y como debaten los propios autores del estudio en sus análisis posteriores sobre el impacto económico, el valor diferencial de un trabajador frente a un sistema automatizado corre el riesgo de reducirse a cero. Si la única aportación de un analista, programador o redactor es aceptar ciegamente y trasladar la primera iteración que genera la máquina sin aplicar una capa de fricción crítica, su rol en la cadena de valor empresarial desaparece. La externalización total del juicio profesional anula la ventaja competitiva de la experiencia humana.

Análisis ético y el colapso del supervisor humano

Desde una perspectiva sociológica y sistémica, la percepción pública de este fenómeno refleja una profunda inquietud sobre la evolución de nuestras capacidades como especie. Los medios de comunicación han comenzado a alertar sobre esta pérdida masiva de destreza cognitiva, trazando un paralelismo histórico directo con la forma en que la dependencia de la navegación por GPS atrofió nuestra orientación espacial innata. Sin embargo, en esta ocasión el impacto no se limita a la memoria espacial, sino que corroe la arquitectura fundamental de la lógica y el libre albedrío intelectual.

Este escenario fractura uno de los pilares éticos sobre los que se ha construido el despliegue comercial de la inteligencia artificial. Hasta ahora, el paradigma de la seguridad siempre ha dependido del concepto del supervisor humano en el bucle, asumiendo que una persona experta revisaría, filtraría y corregiría las alucinaciones o sesgos del modelo antes de su aplicación en el mundo real. Los abrumadores datos del estudio demuestran que este filtro humano está colapsando en tiempo real. El proceso de supervisión se ha degradado hasta convertirse en un mero trámite administrativo o un sello de validación ciego impulsado por el sesgo de automatización. En el actual ecosistema tecnológico, la verdadera habilidad escasa ya no es dominar el software, sino mantener la resistencia psicológica e intelectual necesaria para dudar de una máquina diseñada para parecer omnisciente.