Balance 2025: La Era del Razonamiento y la «Vibe Coding» según Simon Willison

Resumen Estructurado: Balance LLMs 2025

El contexto: Un análisis forense del reporte anual de Simon Willison. La predicción de la muerte del código fue exagerada, pero su naturaleza ha mutado hacia el razonamiento y la verificación.

2025 es el fin de los «loros estocásticos». Modelos como OpenAI o3 y Gemini 3 Reasoning ya no predicen tokens inmediatamente, sino que generan una «cadena de pensamiento oculta».

Utilizan RLVR para iterar internamente hasta que el código compila o la lógica es válida antes de responder. La latencia ahora es una característica de seguridad.

Willison critica la «Programación por Vibras». Los desarrolladores aceptan código masivo de agentes solo porque «parece funcionar», provocando la Normalización de la Desviación e inyección de vulnerabilidades.

El «foso» de OpenAI ha caído. China ha logrado paridad con modelos de peso abierto (DeepSeek). Google domina la memoria bruta con ventanas de contexto de 10 millones de tokens.

Para evitar el «Slop» (código basura):

- El humano siempre tiene la última palabra.

- TDD con Agentes: Test antes que código.

- Adopción del estándar MCP.

«La verdadera singularidad es la capacidad humana de auditar la inteligencia.»

La predicción de la muerte del código fue una hipérbole de marketing, pero su naturaleza ha mutado irreversiblemente. Un análisis forense del reporte anual de ingeniería de Simon Willison.

Si 2023 fue el año del descubrimiento atónito y 2024 el de la integración forzada en productos existentes, 2025 será recordado, según el ingeniero y divulgador Simon Willison, como el año en que los modelos dejaron de ser «loros estocásticos» para intentar «razonar» antes de hablar. En su seminal artículo The Year in LLMs 2025, Willison disecciona un año frenético marcado por la llegada de los agentes autónomos funcionales, la normalización de las suscripciones de software de 200 dólares al mes y el auge cultural y técnico del «Vibe Coding».

Este no es un resumen de notas de prensa. Es una radiografía de la salud de la ingeniería de software moderna frente a una disrupción sin precedentes. A continuación, expandimos los puntos críticos de su análisis, explorando qué significan estructuralmente para los equipos de desarrollo.

El Autor: La Brújula Pragmática en la Tormenta del Hype

Antes de entrar en materia, es vital reiterar la fuente. En un ecosistema saturado de «thought leaders» de LinkedIn que nunca han hecho un git commit, Simon Willison destaca por su pragmatismo radical. Co-creador de Django y creador de Datasette, Willison trata a los LLMs como herramientas de ingeniería imperfectas (como una base de datos con consistencia eventual o un compilador temperamental), no como oráculos mágicos. Su relevancia radica en que prueba la tecnología en la terminal, diseccionando sus fallos con la misma pasión que sus aciertos.

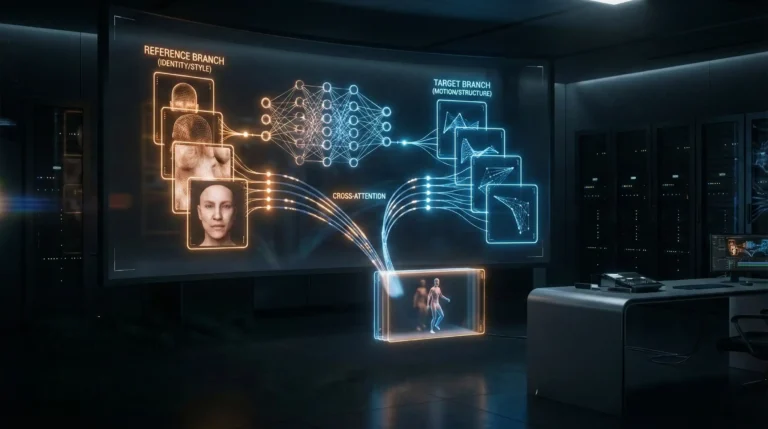

1. Profundizando en el Salto Cuántico: RLVR y la Mecánica del Razonamiento

Willison identifica el verdadero cambio técnico de 2025 no en el tamaño de los parámetros, sino en el paradigma de entrenamiento y uso. El lanzamiento de OpenAI o1 a finales de 2024 fue el preludio, pero la madurez llegó con o3 y la respuesta de Google, Gemini 3 Reasoning.

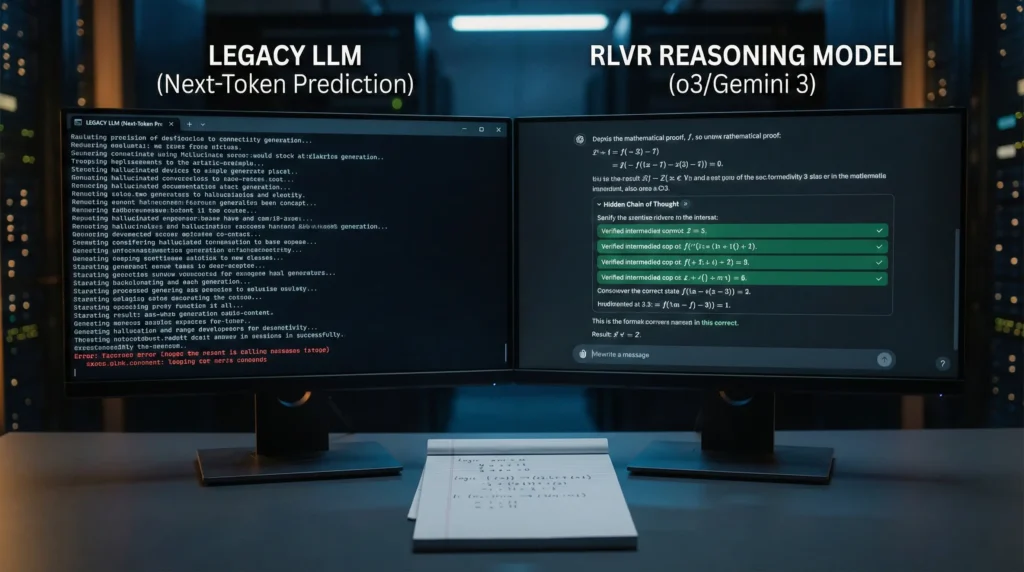

El fin del «Next Token Prediction» Inmediato

Hasta ahora, los LLMs operaban bajo una premisa simple: predecir la siguiente palabra (token) más probable lo más rápido posible. Esto era excelente para la fluidez, pero catastrófico para la lógica de varios pasos (matemáticas, arquitecturas de software complejas), llevando a alucinaciones confiadas.

El cambio en 2025 fue la adopción generalizada del RLVR (Reinforcement Learning from Verifiable Rewards).

- Cómo funciona bajo el capó (La «Cadena de Pensamiento Oculta»): Cuando le pides a un modelo como o3 que diseñe un microservicio, ya no responde inmediatamente. El modelo entra en una fase de «razonamiento» (que puede durar desde segundos hasta minutos). Durante este tiempo, genera internamente múltiples «cadenas de pensamiento» (chains of thought), probando diferentes enfoques.

- La Verificación es la Clave: A diferencia del RLHF (donde humanos puntúan «vibras»), el RLVR utiliza recompensas verificables automáticamente. ¿El código generado compila? ¿Pasa los tests unitarios que el propio modelo generó primero? ¿La solución matemática es correcta según un solver simbólico? El modelo itera internamente hasta que satisface estas condiciones verificables antes de escupir el token final al usuario.

- Implicación Arquitectónica: Esto ha cambiado la UX de la IA. La latencia es ahora una característica, no un bug. Aceptamos esperar 60 segundos por una respuesta si sabemos que ha sido verificada internamente contra alucinaciones lógicas.

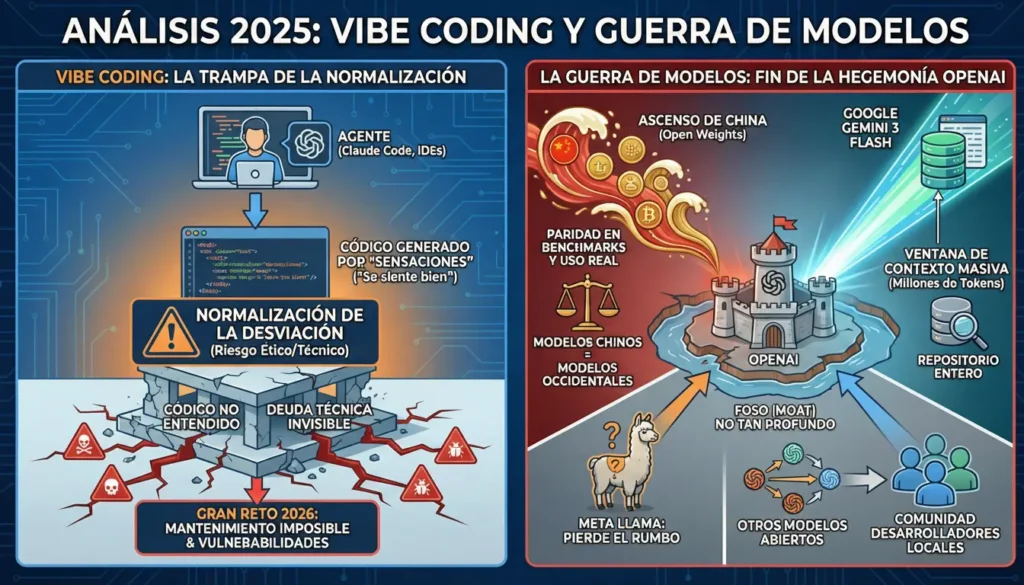

2. «Vibe Coding»: La Normalización de la Deuda Técnica Exponencial

Quizás el concepto más sociológico y peligroso que Willison acuña y critica en 2025 es el «Vibe Coding» (Programación por Vibras).

Gracias a la integración profunda de agentes en IDEs (como la evolución de GitHub Copilot Workspace o Claude Code), los desarrolladores han comenzado a operar en un nivel de abstracción peligroso. Le pides al agente: «Refactoriza este módulo de autenticación para usar OAuth2». El agente escupe 500 líneas de código en 10 archivos. El desarrollador mira el diff por encima, ejecuta la app, ve que «parece funcionar» (la «vibra» es correcta) y hace commit.

La Crítica Ética y de Seguridad: La Normalización de la Desviación

Willison toma prestado el término «Normalización de la Desviación» de la ingeniería de seguridad de la NASA (el fenómeno donde aceptar pequeños fallos o riesgos se convierte en la norma cultural hasta que ocurre una catástrofe).

- El riesgo de seguridad oculto: El código generado por «vibra» a menudo ignora casos extremos (edge cases), validación de entradas o manejo robusto de errores porque su objetivo principal es «hacer que funcione» en el camino feliz. Estamos inyectando vulnerabilidades a una velocidad sobrehumana que ningún equipo de seguridad humano puede auditar.

- La pérdida de la maestría: Willison advierte que estamos criando una generación de «revisores de código junior» en lugar de ingenieros. Si el desarrollador no puede explicar exactamente por qué el agente eligió esa librería específica o esa estructura de datos, ese código es deuda técnica radiactiva desde el día uno. Escribir código es fácil; mantener un sistema generado por un agente que nadie en el equipo comprende será el gran reto de la segunda mitad de la década.

3. Geopolítica y Arquitectura: La Guerra de Modelos en 2025

El «foso defensivo» (moat) de OpenAI, que parecía inexpugnable en 2023, se demostró superficial en 2025. Willison señala hitos clave que cambiaron el panorama de despliegue:

- El Ascenso de la Paridad de Peso Abierto (Open Weights): La gran sorpresa de 2025 fue China. Laboratorios como DeepSeek y Qwen lanzaron modelos de peso abierto que alcanzaron la paridad efectiva con GPT-4o y Gemini 2 Pro en benchmarks de codificación (HumanEval+) y razonamiento. Esto rompió el monopolio occidental y permitió a empresas europeas y asiáticas desplegar IA soberana de alto nivel sin depender de APIs de EE. UU.

- La Batalla por la Ventana de Contexto: Google contraatacó no con más razonamiento, sino con memoria bruta. La serie Gemini 3 Flash normalizó ventanas de contexto de 10 millones de tokens.

- Impacto Técnico: Esto empezó a matar las arquitecturas RAG (Retrieval-Augmented Generation) complejas. ¿Para qué indexar y buscar fragmentos en una base vectorial si puedes volcar literalmente la documentación entera de AWS, el código fuente de tu empresa y el historial de Slack del último año en una sola llamada de inferencia? Willison señala que esto es poderoso, pero también incentiva la pereza arquitectónica y costes de inferencia brutales.

- El tropiezo de Meta: Según el análisis, Llama tuvo un año difícil, perdiendo el liderazgo en la comunidad open-source frente a modelos más eficientes y licenciados permisivamente provenientes de nuevos actores.

4. La Brecha Digital del Desarrollo: La Tasa de 200 Dólares

La utilidad real ahora tiene un precio de entrada elevado. Willison destaca una bifurcación económica en el mercado laboral del desarrollo:

- La Capa Commodity: Modelos «bastante buenos» (tipo GPT-4o mini o Llama 3 8B) que son casi gratuitos o muy baratos, útiles para autocompletado y tareas menores.

- La Capa Premium: Suscripciones de $200/mes (como ChatGPT Pro con acceso ilimitado a o3, o suites de agentes empresariales). Estas herramientas no solo «ayudan», sino que pueden asumir tickets de JIRA completos de forma autónoma.

Willison advierte que esto crea una brecha de productividad insalvable: ingenieros seniors aumentados por agentes de $200 frente a ingenieros juniors luchando con modelos gratuitos que alucinan. Las empresas que no paguen esta «tasa de aumento» se quedarán atrás.

Aprende: La Estrategia del «Cyborg Centauro» contra el Slop

Para finalizar, Willison ofrece un marco de trabajo práctico para no contribuir al «Slop» (la inundación de contenido y código basura generado por IA en internet). Su enfoque es el del «Centauro»: la IA es el cuerpo del caballo (fuerza bruta, velocidad), el humano es el torso y la cabeza (dirección, ética, verificación final).

- El Humano tiene la Última Palabra: Usa LLMs para generar esquemas, lluvia de ideas, tests unitarios o boilerplate. Pero nunca copies y pegues el resultado final directamente a producción o a un blog post. La edición humana debe ser sustancial, no superficial.

- Desarrollo Guiado por Tests (TDD) Asistido por Agente: Si usas un agente como Claude Code para implementar una funcionalidad, exígele que escriba los tests primero. Luego, que escriba el código para pasar esos tests. Tú, como humano, auditas los tests para asegurarte de que cubren los casos límite reales, no solo los felices.

- Adopción de Interfaces Estándar (MCP): Willison ha sido un gran defensor en 2025 del Model Context Protocol (MCP), un intento de estandarizar cómo los LLMs se conectan a fuentes de datos externas (tu base de datos, tu sistema de archivos). En lugar de hackear conexiones personalizadas para cada modelo, usa estándares que permitan cambiar el «cerebro» de la IA sin tener que reescribir toda la infraestructura de conexión de datos.

Conclusión: La Inevitable Vuelta a los Fundamentos

El informe de 2025 de Simon Willison actúa como un memento mori para la euforia tecnológica descontrolada. Si bien celebramos la llegada de máquinas capaces de razonar y construir software complejo, el mensaje subyacente es una advertencia contra la complacencia intelectual.

La IA ha democratizado la generación de código, pero ha encarecido brutalmente la comprensión del mismo. El peligro del «Vibe Coding» no es que el software no funcione hoy, sino que estemos construyendo infraestructuras críticas sobre cimientos que nadie entiende mañana. La verdadera «singularidad» de 2026 no será un modelo con un IQ de 200, sino la capacidad de los ingenieros humanos para auditar, restringir y dirigir esa inteligencia sin perder el control de la arquitectura.

Para nosotros, los constructores, la lección es clara: las herramientas han cambiado, pero la responsabilidad es inmutable. No dejes que la «vibra» sustituya a la ingeniería. Usa la IA para ir más rápido, sí, pero nunca para saltarte el proceso de entender qué estás construyendo. En la era de la generación infinita, la verificación rigurosa es el único activo que mantiene su valor.