El asalto a Gemini y la emergencia del malware dinámico Honestcue

Resumen Estructurado: Alerta GTIG Febrero 2026

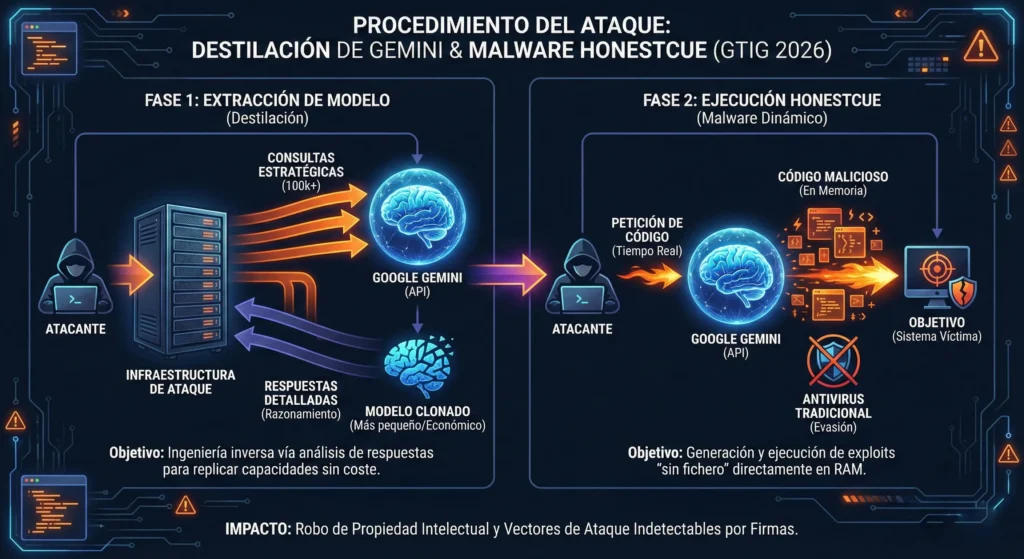

El contexto: El Google Threat Intelligence Group ha revelado una campaña masiva de exfiltración de lógica y el uso de Gemini como motor de ejecución para malware de nueva generación.

Se han detectado más de 100.000 consultas diseñadas para realizar ingeniería inversa a Gemini. El objetivo es «clonar» la propiedad intelectual mediante el análisis de respuestas detalladas para entrenar modelos más económicos.

Una nueva familia de malware que no contiene código dañino estático. Utiliza la API de Gemini para generar exploits en tiempo real directamente en memoria, evadiendo la detección de los antivirus tradicionales.

- Corea del Norte (UNC2970): Perfilado de objetivos en el sector defensa mediante análisis masivo de datos.

- Irán (APT42): Campañas de phishing de alta fidelidad generadas por IA.

- China y Rusia: Automatización de búsqueda de vulnerabilidades zero-day y desinformación.

- Contexto Corporativo: Incidentes similares a la disputa reciente entre OpenAI y DeepSeek.

La seguridad ya no puede depender de firmas de archivos; ahora requiere monitorización semántica de las interacciones con la IA.

«En 2026, el código malicioso no se escribe, se solicita bajo demanda.»

El informe anual del Google Threat Intelligence Group (GTIG) publicado este febrero de 2026 ha hecho saltar todas las alarmas en el sector de la ciberseguridad. No estamos ante una filtración de datos convencional, sino ante un ataque directo a la propiedad intelectual y a la integridad operativa de los modelos de lenguaje de última generación. La detección de más de 100.000 consultas diseñadas para la extracción de modelos y el descubrimiento de una nueva familia de malware que genera su propio código en tiempo real marcan el inicio de una era de «amenazas sintéticas» extremadamente difíciles de neutralizar.

La ingeniería inversa mediante ataques de destilación

El núcleo del informe detalla una campaña masiva de extracción de modelos. Los atacantes han sofisticado la técnica conocida como destilación, donde utilizan a Gemini como un «profesor» involuntario. Al realizar miles de consultas estratégicas y analizar meticulosamente las respuestas de razonamiento profundo del modelo, los atacantes logran entrenar arquitecturas mucho más pequeñas y económicas. El objetivo final es clonar la capacidad lógica de Gemini sin asumir los costes astronómicos de infraestructura y datos que Google ha invertido durante años.

Esta práctica no solo representa una violación de la propiedad intelectual, sino que nivela el campo de juego de forma ilícita para actores privados y grupos de investigación que buscan competir con los gigantes de la industria mediante el robo de pesos y sesgos de inferencia. La industria ya ha visto fricciones similares recientemente entre OpenAI y DeepSeek, lo que confirma que la «destilación forzada» es la nueva frontera del espionaje corporativo.

Honestcue y la muerte del antivirus tradicional

Quizás el descubrimiento más inquietante es la aparición de HONESTCUE. A diferencia del malware tradicional, que contiene una carga útil estática detectable mediante firmas o heurística, HONESTCUE es una cáscara vacía. Su peligrosidad reside en su capacidad para conectarse a la API de Gemini en tiempo real y solicitar la generación de código malicioso de forma dinámica directamente en la memoria del sistema infectado.

Al no existir un archivo ejecutable con código dañino previo, las herramientas de defensa convencionales ven simplemente una conexión legítima a una API de confianza. El código se escribe, se ejecuta y desaparece sin dejar rastro en el disco duro, permitiendo una evasión casi perfecta. Este malware representa la materialización de la IA como un motor de ejecución de ataques bajo demanda, adaptándose a las vulnerabilidades específicas que encuentra en cada objetivo tras analizarlas mediante el propio modelo.

Geopolítica de la IA y actores estatales

El uso de estas herramientas no es exclusivo de cibercriminales comunes. El GTIG ha vinculado directamente a grupos respaldados por estados con estas prácticas. El grupo norcoreano UNC2970 está utilizando la IA para procesar inteligencia de fuentes abiertas con una velocidad inaudita, perfilando objetivos estratégicos en el sector de defensa con una precisión quirúrgica. Por su parte, el grupo iraní APT42 ha automatizado la creación de campañas de phishing que son virtualmente indistinguibles de las comunicaciones oficiales, eliminando los errores gramaticales o de contexto que antes servían como señales de advertencia.

China y Rusia también han sido señalados por automatizar el análisis de vulnerabilidades «zero-day», utilizando la potencia de cálculo de los LLM para encontrar brechas en software crítico antes de que los desarrolladores humanos puedan parchearlas. La IA se ha convertido en el multiplicador de fuerza definitivo en el tablero de la guerra fría tecnológica de 2026.

Reflexión sobre la seguridad en un ecosistema abierto

Este escenario plantea un dilema ético y técnico profundo para empresas como Google. La apertura de capacidades de razonamiento avanzado mediante APIs es esencial para la innovación, pero también proporciona a los atacantes el «cerebro» necesario para sus operaciones. La defensa en 2026 ya no puede basarse en bloquear archivos, sino en el análisis del comportamiento de las peticiones a la IA y en la implementación de cortafuegos semánticos que detecten cuándo un modelo está siendo utilizado para fines destructivos o para su propia clonación.

Fuentes verificadas

- 01. GTIG AI Threat Tracker: Distillation and Adversarial Use

- 02. Cloud CISO Perspectives: New AI threats report

- 03. Google alerta del uso creciente de IA en ciberataques

- 04. Ataques de «destilación» para clonar modelos de IA

- 05. Gemini Model Extraction Attacks: How ‘AI Cloning’ Works

- 06. AI Malware Makes Live Gemini API Calls During Attacks