Análisis de la arquitectura y capacidades de ChatGPT Images 2.0

Resumen Estructurado de ChatGPT Images 2.0

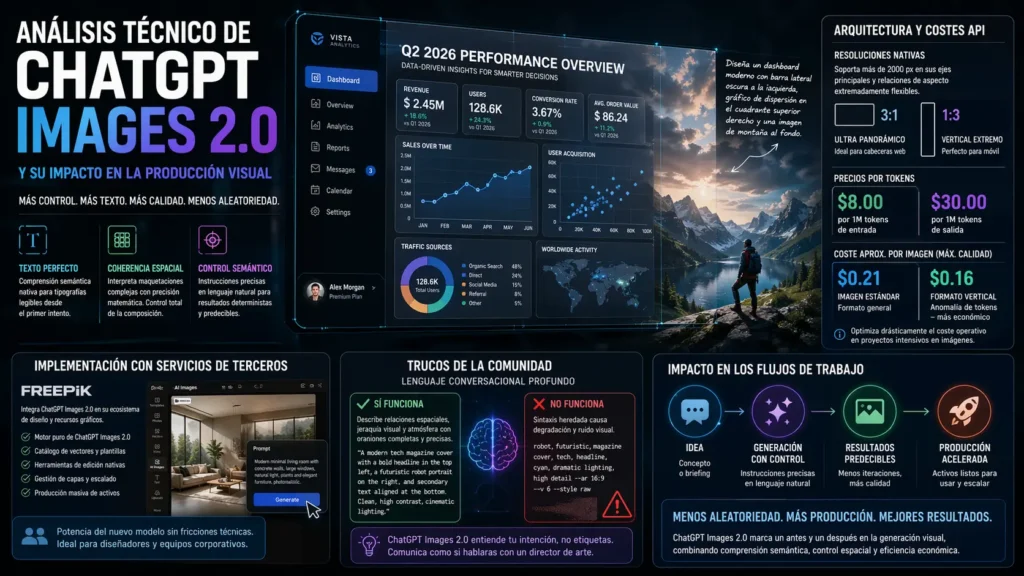

El contexto: OpenAI rediseña por completo su motor visual, abandonando la difusión simple para integrar un subsistema de procesamiento de lenguaje natural (NLP) y una capa de razonamiento profundo.

El modelo ahora planifica la composición y busca datos en tiempo real antes de renderizar los píxeles, garantizando coherencia espacial en cuadrículas complejas e información actualizada (logos, gráficos).

Se elimina el problema histórico del texto ilegible. ChatGPT Images 2.0 comprende la estructura de las fuentes y genera textos densos multilingües con un 99% de precisión, ideal para infografías e interfaces web.

Los prompts heredados basados en listas de palabras separadas por comas rompen el modelo y generan ruido visual. El nuevo estándar exige un inglés conversacional profundo y descriptivo (Prompting Semántico).

La herramienta deja de ser un generador de imágenes genérico para convertirse en un motor determinista de autoedición y dirección de arte, trazable además mediante metadatos C2PA.

El ecosistema de la inteligencia artificial generativa experimentó ayer una sacudida arquitectónica con el despliegue de ChatGPT Images 2.0. Esta actualización representa una reconstrucción profunda del pipeline de renderizado de OpenAI, abandonando el enfoque de difusión simple para integrar procesamiento de lenguaje natural y razonamiento puro. Lejos de ser una simple mejora en la fidelidad fotográfica, el sistema ha sido diseñado para resolver las deficiencias históricas de la generación visual, como el texto ilegible, la pérdida de coherencia espacial y la falta de contexto actualizado. A través de la auditoría de los primeros despliegues, desgranamos cómo esta herramienta transforma los flujos de trabajo técnicos y creativos.

El motor y el nuevo modo de pensamiento

La novedad estructural más importante de este modelo no es la resolución, sino la división de su pipeline en dos vías operativas. Por un lado, existe un modo instantáneo diseñado para iteraciones rápidas. Por otro, la verdadera innovación reside en el modo de pensamiento, una arquitectura reservada para usuarios avanzados que altera por completo el proceso de difusión. En lugar de procesar el texto y pintar los píxeles de inmediato, el modelo se pausa para razonar sobre la petición, planificar la composición y verificar su propio trabajo.

Este paso intermedio de razonamiento otorga al sistema la capacidad de conectarse a la web. Dado que el conocimiento base del modelo está congelado en diciembre de 2025, el modo de pensamiento rastrea datos en tiempo real para incorporar logotipos actualizados o gráficos financieros recientes antes de renderizar la imagen. Además, esta arquitectura permite generar hasta ocho imágenes diferentes a partir de un único prompt, manteniendo una coherencia absoluta en el diseño de los personajes y el estilo visual a lo largo de todas las secuencias. Los usuarios han documentado cómo el sistema posee memoria de coordenadas espaciales, siendo capaz de recordar la ubicación exacta de un elemento minúsculo dentro de una imagen para alterarlo en iteraciones posteriores.

Renderizado tipográfico multilingüe y precisión espacial

La capacidad tipográfica del nuevo motor cruza finalmente el umbral de producción. El modelo genera texto denso con una precisión del noventa y nueve por ciento en caracteres latinos, integrando además soporte nativo para sistemas de escritura complejos como el japonés, coreano, hindi y árabe. Esto permite a los creadores generar portadas de revistas, infografías complejas y maquetaciones de interfaces de usuario en una sola pasada, sin errores ortográficos.

A esta fidelidad tipográfica se suma un control geométrico impecable. Las arquitecturas anteriores fracasaban estrepitosamente al intentar separar conceptos en una misma imagen. Sin embargo, las pruebas de estrés actuales demuestran que el sistema puede gestionar cuadrículas de hasta diez por diez celdas, aislando cien conceptos distintos sin que los elementos visuales se fusionen o desborden sus límites. El modelo opera con una resolución nativa de dos mil píxeles y domina relaciones de aspecto extremas, permitiendo generar banners ultra panorámicos o formatos verticales inmersivos de forma nativa.

Costes de infraestructura y casos de uso en el ecosistema startup

Para los desarrolladores y fundadores de startups, esta tecnología supone una optimización drástica de los recursos operativos. A nivel de infraestructura mediante la futura API, el sistema adopta un modelo de precios basado en tokens, con un coste aproximado de ocho dólares por millón de tokens de entrada y treinta por los de salida. Una imagen de alta calidad estructurada ronda los veintiún centavos de dólar.

La integración de este modelo permite a las startups prescindir de flujos de trabajo pesados en etapas iniciales. Los equipos pueden automatizar la creación de diapositivas para inversores, mapas logísticos y material de marketing localizado para diferentes mercados internacionales sin depender de traductores ni diseñadores externos. Al integrar el motor en herramientas de automatización, un fundador con criterio visual puede estructurar datos complejos en infografías precisas, reduciendo drásticamente los cuellos de botella en la producción de activos gráficos.

Aprende a evitar el ruido y dominar el prompting semántico

La comunidad técnica ha detectado rápidamente un fallo crítico originado por la memoria muscular de los usuarios. Al utilizar técnicas de prompting heredadas de modelos como Stable Diffusion XL, basadas en etiquetas separadas por comas, el nuevo motor sufre una fragmentación de atención. Esto produce un extraño artefacto visual en forma de ruido diagonal y tramado cruzado que arruina por completo la imagen. El modelo detesta las listas de palabras sueltas; exige un inglés conversacional, fluido y descriptivo.

Para obtener resultados óptimos, la estructura del prompt debe seguir un orden semántico estricto. Se debe comenzar definiendo la relación de aspecto, seguido del sujeto y su contexto. Todo el texto que deba aparecer renderizado tiene que ir entrecomillado obligatoriamente. Es vital abandonar adjetivos vacíos como «profesional» o «increíble», ya que empujan al modelo hacia una estética de banco de imágenes genérico. En su lugar, se deben utilizar anclajes técnicos como «fotografía editorial» e indicar el tipo de lente y la iluminación de forma precisa.

Renderizado de Cómic de 4 páginas

Análisis ético de los filtros de seguridad y las marcas de agua

El despliegue de un motor fotorrealista de esta magnitud viene acompañado de una arquitectura de censura extremadamente agresiva. OpenAI ha implementado clasificadores de seguridad tanto en la capa de entrada del texto como en la validación de la imagen de salida. Sin embargo, la comunidad reporta inconsistencias constantes en el sistema, bloqueando peticiones inofensivas sobre personajes públicos bajo criterios opacos mientras permite escenarios surrealistas si se ajusta la sintaxis.

Para mitigar el riesgo de falsificaciones profundas y desinformación, especialmente en el ámbito de riesgos biológicos y políticos, OpenAI ha integrado metadatos C2PA en cada archivo generado. Adicionalmente, el sistema incrusta una marca de agua imperceptible y resistente a modificaciones que permite a la compañía rastrear la procedencia de cualquier imagen. A nivel de impacto laboral, la automatización de la autoedición y la generación de gráficos de datos plantea un desafío inminente para los equipos de diseño junior, desplazando el valor desde la ejecución técnica pura hacia la dirección de arte y la ingeniería de contexto.

Lo que los usuarios están detectando

Más allá de la documentación oficial, tras miles de pruebas documentadas en X.com, la comunidad ha localizado un fenómeno técnico no previsto: la trampa de la sobretexturización. Te explicamos qué es, por qué ocurre y cómo neutralizarlo.

La trampa del hiperdetalle: Anatomía de la sobretexturización

Si has empezado a lanzar tus primeros prompts en ChatGPT Images 2.0, es probable que te hayas topado con un artefacto visual perturbador: la sobretexturización.

Lejos de conseguir una fotografía natural, el modelo te devuelve imágenes donde la piel humana parece plástico pulido, los poros parecen cráteres microscópicos, el pelo parece fibra óptica y las telas tienen una tridimensionalidad alienígena. Es la paradoja del hiperdetalle: al intentar ser excesivamente realista, el motor cruza el valle inquietante y destruye lo orgánico.

Este problema técnico no es nuevo —arrastramos esta deuda técnica desde DALL-E 3 y Midjourney—, pero en la arquitectura de Images 2.0 el contraste es brutal. ¿Por qué ocurre? El motor genera basándose en patrones estadísticos. Cuando detecta en tu prompt palabras vacías heredadas como «ultra-detallado» o «calidad 8K», su capa de razonamiento deduce que la única forma de satisfacer esa métrica es amplificar artificialmente el micro-contraste y la textura base. El modelo sobrecompensa.

Para entender el salto algorítmico y por qué el nuevo motor es más propenso a este fallo si no se le guía correctamente, observemos la telemetría comparada:

| Parámetro Técnico | Generación Anterior (v1.5) | ChatGPT Images 2.0 |

|---|---|---|

| Perfil de Color | Sesgo cálido / amarillento | Natural y neutro |

| Fidelidad Óptica | Estética IA reconocible | Fotorrealismo extremo |

| Capa de Razonamiento | No disponible (Difusión directa) | Sí (Thinking Mode) |

| Renderizado Tipográfico | Borroso y con alucinaciones | Precisión a nivel de producción |

| Riesgo de Sobretexturización | Moderado (Desenfoque base) | Crítico (Requiere contención) |

Protocolo táctico: 7 reglas para domar el realismo fotográfico

La comunidad técnica y los primeros adoptantes en X.com (como las investigaciones de Victor Garcés o Bruffstar) han mapeado rápidamente cómo neutralizar esta sobretexturización. La clave no está en pedir más, sino en acotar las alucinaciones del modelo.

Aplica este protocolo de 7 pasos en tu flujo de trabajo:

1. Define los límites negativos explícitamente El error de un desarrollador junior es describir solo lo que quiere. En motores semánticos, debes acotar lo que no quieres. Inyecta barreras defensivas en tu prompt como: «sin exceso de poros, sin textura plástica, avoid oversharpening, no artificial grain».

2. Purga el vocabulario del «hiperdetalle» Borra de tu diccionario palabras como hyperrealistic, 8K, Unreal Engine, extreme detail. Estas etiquetas actúan como veneno para la naturalidad fotográfica en la versión 2.0. Cambia:

❌ «ultra-detailed hyperrealistic skin texture»

✅ «natural everyday photo quality, soft light, realistic skin»

3. El anclaje de la «cámara mundana» La técnica de contención más potente descubierta hasta la fecha es rebajar las expectativas del modelo obligándole a simular tecnología de consumo cotidiano. En lugar de pedir ópticas Hasselblad, ancla el prompt con: «Como una foto hecha con un iPhone 15 en modo retrato, no procesada con Photoshop, ligeramente imperfecta». Esto obliga al modelo a introducir defectos orgánicos.

4. Limita la densidad semántica No satures el contexto. Un prompt con veinte líneas descriptivas sobre una textura desorienta a la capa de razonamiento (Thinking Layer), que intentará complacerte inyectando ruido en cada píxel libre. Mantén el prompt en 5-7 instrucciones estructurales.

5. Flujo iterativo (Inpainting Zonal) No regeneres la imagen entera (ahorra tokens). ChatGPT Images 2.0 cuenta con un editor de zonas letal. Si el renderizado es perfecto pero la piel parece de cera, selecciona solo el rostro y lanza un prompt conversacional directo: «Suaviza la textura de la piel en esta zona, reduce la nitidez de los poros y hazla más orgánica».

6. Itera, no destruyas En lugar de lanzar un nuevo prompt desde cero, utiliza la memoria del contexto. Partiendo de una imagen generada, dile: «Mantén todo exactamente igual, pero reduce el contraste de las texturas un 20% y uniforma la luz». El modelo 2.0 comprende instrucciones relativas.

7. Activa el Modo Pensamiento (con moderación) Si partes de un boceto inicial, usar el Thinking Mode ayuda al modelo a calcular correctamente la geometría espacial y la incidencia de la luz, reduciendo la necesidad de que «invente» texturas para rellenar vacíos lógicos.

El Prompt Anti-Sobretexturización (Master Template)

Aquí tienes la síntesis operativa de las 7 reglas. Este es el marco de trabajo exacto que debes utilizar para generar humanos y entornos orgánicos en el nuevo motor:

Domina el prompting semántico

La sintaxis antigua ya no funciona. Accede a nuestra colección técnica con 50 prompts estructurales verificados para ChatGPT Images 2.0. Diseños de interfaces, maquetación geométrica e infografías listas para inyectar en tu flujo de trabajo.

Desbloquear los 50 prompts