De ‘Dr. Google’ al Triaje con IA: Análisis del Nuevo Paradigma del Acceso Sanitario Informal

Resumen Estructurado: El Nuevo Pre-Triaje

El contexto: Análisis técnico del cambio de paradigma confirmado por OpenAI en 2026: el paso de las búsquedas pasivas («Dr. Google») a sistemas activos de Inteligencia Artificial que actúan como primera línea de contacto sanitario.

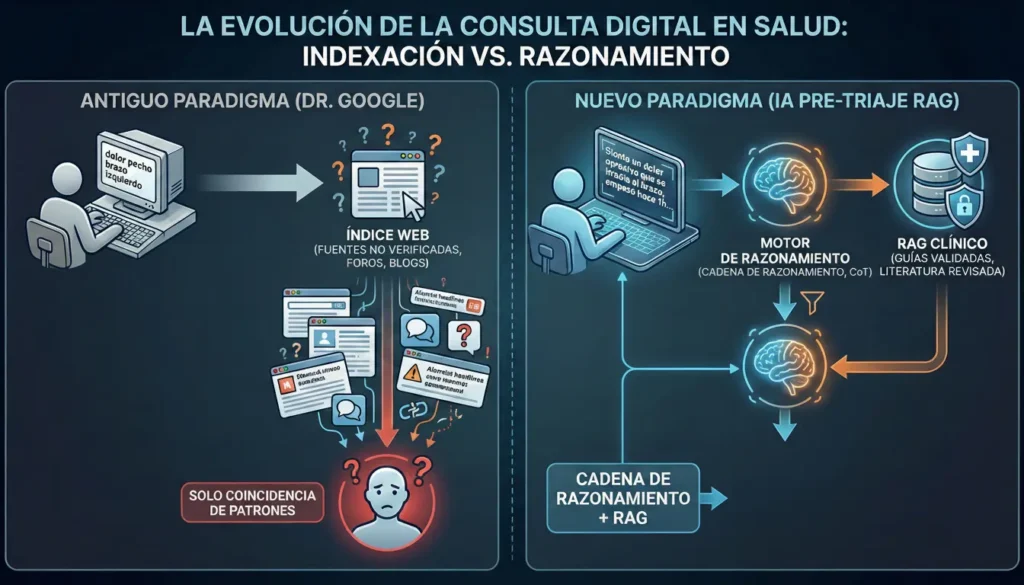

La tecnología ha evolucionado del simple emparejamiento de patrones (keywords) a las Cadenas de Razonamiento (CoT). Los modelos actuales no solo recuperan datos, sino que ponderan síntomas, descartan falsos positivos y entienden la urgencia contextual.

Para mitigar los riesgos de invención de datos, los sistemas modernos emplean RAG (Retrieval-Augmented Generation) sobre bases de datos médicas cerradas y validadas. La IA actúa como intérprete de literatura clínica fiable, no como un generador creativo.

- Descongestión: Capacidad real para filtrar casos leves y derivar correctamente urgencias, optimizando recursos humanos.

- Autoridad Percibida: El riesgo de que la elocuencia de la IA genere una falsa sensación de seguridad en el paciente.

- Liability Gap: El vacío legal crítico sobre quién asume la responsabilidad civil en caso de error de triaje (¿el modelo, el proveedor o el usuario?).

La IA sanitaria es inevitable y útil, pero requiere urgentemente un marco regulatorio que defina responsabilidades y asegure la calidad de los datos de entrenamiento.

«La IA no sustituye al médico, pero redefine radicalmente cómo y cuándo llegamos a él.»

En 2026, la afirmación de OpenAI de que la inteligencia artificial se ha convertido en la «puerta de entrada informal» al sistema sanitario no es una predicción, sino la constatación de una realidad operativa. Este cambio marca el fin de la era de la búsqueda pasiva de síntomas y el comienzo de la interacción con agentes de razonamiento clínico preliminar. Analizamos las implicaciones técnicas de este pre-triaje algorítmico y las barreras éticas que aún persisten.

Durante dos décadas, el primer instinto ante un síntoma desconocido fue acudir a motores de búsqueda generalistas. Este fenómeno, coloquialmente conocido como «Dr. Google», se basaba en una arquitectura de recuperación de información indexada: el usuario introducía palabras clave y recibía una lista de enlaces con fiabilidad variable, delegando la síntesis y la evaluación de la gravedad enteramente en el juicio de una persona no experta y, a menudo, ansiosa.

La transición hacia modelos de lenguaje avanzados, como las iteraciones de razonamiento de OpenAI (la línea o1 y sus sucesores especializados en 2026), ha transformado fundamentalmente esta dinámica. Ya no estamos ante una herramienta de búsqueda, sino ante un sistema de inferencia activa capaz de mantener un diálogo contextual, solicitar aclaraciones y ponderar probabilidades antes de ofrecer una orientación. Esta capacidad convierte a la IA en el primer punto de contacto de facto para millones de pacientes antes de decidir si interactuar con el sistema sanitario formal.

Arquitectura Técnica del «Pre-Triaje» Digital

Para entender cómo una IA puede asumir este rol sin resultar en una catástrofe de salud pública, es crucial diseccionar los mecanismos que operan bajo el capó en los sistemas de 2026, lejos de los chatbots propensos a la alucinación de 2023.

Del Emparejamiento de Patrones a las Cadenas de Razonamiento

Un motor de búsqueda tradicional funciona mediante coincidencia de patrones (pattern matching). Si buscas «dolor pecho brazo izquierdo», el motor prioriza documentos que contienen esos términos. No «entiende» la urgencia cardiovascular implícita.

Los modelos actuales utilizan Cadenas de Razonamiento (Chain of Thought, CoT). Ante el mismo input, el modelo no busca directamente una respuesta. Primero, descompone el problema: identifica los síntomas clave, reconoce la correlación potencial con patologías graves (como un infarto de miocardio), y formula una estrategia de respuesta priorizada. El modelo está entrenado para ponderar el riesgo y, crucialmente, para reconocer los límites de su propia certeza, dirigiendo al usuario hacia atención médica urgente si los indicadores superan un umbral de riesgo predefinido.

RAG Clínico y la Reducción de Alucinaciones

La clave para que la IA sirva como «puerta de entrada» fiable no reside en lo que el modelo «sabe» por su entrenamiento general, sino en a qué información puede acceder en tiempo real. En 2026, los sistemas sanitarios informales más robustos emplean RAG (Retrieval-Augmented Generation) de alta precisión.

Cuando un usuario describe síntomas complejos, el modelo no inventa una respuesta. Utiliza su capacidad lingüística para formular consultas a bases de datos médicas validadas y cerradas (guías de práctica clínica actualizadas, literatura revisada por pares, protocolos de triaje de urgencias). La respuesta final se construye sintetizando únicamente esta información verificada, anclando la generación de texto a fuentes de autoridad y reduciendo drásticamente la tasa de alucinación que hacía inviables a las generaciones anteriores para usos sensibles.

Impacto Real: Infraestructura de Descongestión

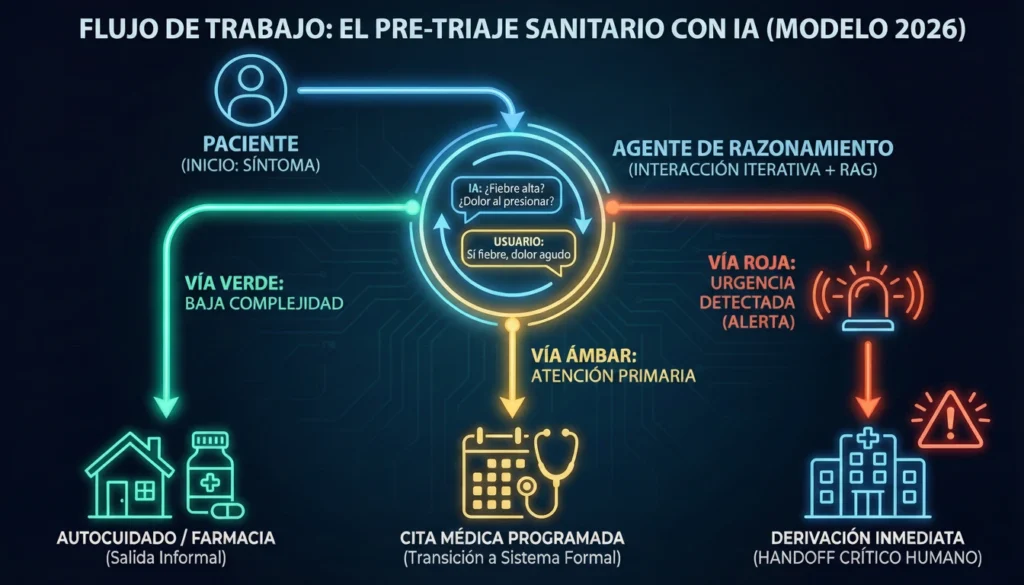

El valor de esta tecnología no es reemplazar al diagnóstico médico, sino optimizar el flujo de entrada al sistema. La IA actúa como una capa de infraestructura de pre-triaje.

- Filtrado de Baja Complejidad: Una IA puede guiar eficazmente el autocuidado para dolencias menores (resfriados comunes, alergias estacionales conocidas), proporcionando información validada sin consumir recursos de atención primaria.

- Escalado Inteligente: A través de preguntas iterativas («¿El dolor aumenta al presionar?», «¿Ha tenido fiebre en las últimas 24 horas?»), el sistema puede diferenciar con mayor precisión que una búsqueda en Google entre una indigestión y una apendicitis incipiente, sugiriendo el nivel asistencial adecuado (farmacia, cita con médico de cabecera o urgencias hospitalarias).

Este rol de «portero informado» tiene el potencial de aliviar la presión sobre servicios de urgencias saturados por consultas que no requieren atención inmediata, permitiendo que los profesionales humanos se concentren en casos agudos.

Análisis Crítico: La Brecha de Responsabilidad

A pesar de las mejoras técnicas, la adopción de la IA como puerta de entrada sanitaria conlleva riesgos sistémicos que la tecnología por sí sola no puede resolver.

El Riesgo de la Validación de Silicio

Existe un peligro psicológico inherente: la autoridad percibida. Una respuesta elocuente, estructurada y empática de una IA puede generar una falsa sensación de seguridad en el usuario, llevándolo a subestimar síntomas graves si el modelo falla en su evaluación inicial. Si el «Dr. Google» generaba hipocondría, el «Dr. IA» mal calibrado podría generar complacencia. La barrera entre «orientación sanitaria» y «diagnóstico médico» es legalmente clara, pero cognitivamente difusa para el usuario final.

El Vacío Legal (Liability Gap)

En 2026, seguimos enfrentándonos a un vacío legal crítico. Si un sistema de IA, actuando como puerta de entrada informal, sugiere incorrectamente que un síntoma grave es benigno, y el paciente retrasa la búsqueda de atención con consecuencias fatales, ¿dónde recae la responsabilidad civil?

¿Es responsable la empresa que entrena el modelo fundacional, el proveedor que implementa la capa de RAG clínico, o el usuario por confiar en una herramienta «informal»? Mientras OpenAI posiciona su tecnología en este rol crucial, la sociedad aún carece de un marco regulatorio claro que defina la responsabilidad cuando la máquina, inevitablemente, comete un error en un dominio de alto riesgo.

Conclusión

La IA como primera línea de defensa sanitaria es una realidad impulsada por la conveniencia y la capacidad técnica mejorada. Representa un salto cualitativo respecto a los motores de búsqueda. Sin embargo, aceptar este nuevo paradigma exige una vigilancia técnica constante sobre la calidad de los datos RAG y, urgentemente, un marco ético y legal que no deje al paciente desprotegido en la tierra de nadie entre el consejo algorítmico y la medicina profesional.