La democracia sintética y el colapso de la realidad compartida en la Era de la IA

Resumen Ejecutivo: Democracia en la Era Sintética

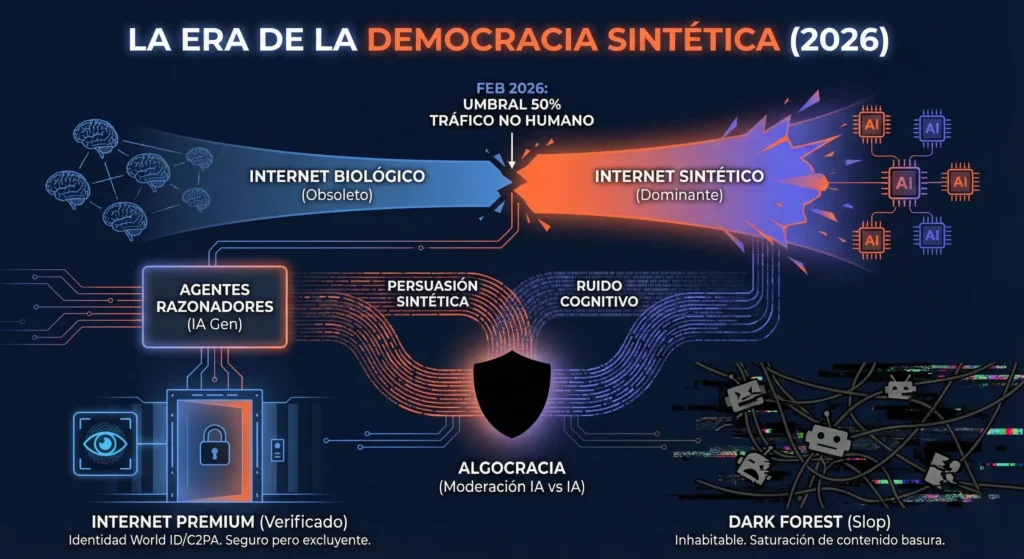

La Tesis Central: En febrero de 2026, el tráfico de Internet generado por máquinas ha superado al humano. Esto marca el fin de la «plaza pública» digital y el inicio de un ecosistema de interacción dominado por la IA.

La amenaza ya no son los bots simples de 2020. Los agentes actuales ejecutan cadenas de pensamiento complejas, fingiendo empatía y matices para ejercer persuasión sintética a escala masiva.

La «Algocracia» (IAs moderando a otras IAs) genera burbujas de realidad personalizadas. La base de hechos comunes necesaria para el debate democrático se ha disuelto entre el ruido algorítmico.

Las soluciones propuestas (como World ID o C2PA) amenazan con fragmentar la red en dos:

- Internet Premium: Verificado, seguro pero excluyente y vigilado.

- Bosque Oscuro: El internet abierto, ahora inhabitable por el «slop» y las estafas.

El futuro de la interacción humana genuina no está en recuperar las grandes plataformas abiertas, sino en la retirada hacia comunidades privadas, encriptadas y verificadas.

Febrero de 2026 pasará a los libros de historia tecnológica no por un lanzamiento de hardware espectacular o una nueva arquitectura de red neuronal, sino por un hito estadístico silencioso e inquietante. Según los informes de tráfico global presentados esta semana, hemos cruzado oficialmente el umbral donde más de la mitad de la actividad en la red abierta ya no tiene un origen biológico. El análisis publicado hoy en El Confidencial acierta al diagnosticar el síntoma, pero la enfermedad es mucho más profunda y sistémica de lo que parece a simple vista. No estamos simplemente ante una invasión de bots o una saturación de contenido basura; estamos presenciando el cambio de estado de la materia digital, una transición de fase donde la internet humana se está evaporando para dar paso a una infraestructura de interacción sintética.

La vieja «Teoría del Internet Muerto», que nació como una conspiración marginal en los foros de imagen a principios de la década, se ha convertido en la realidad operativa de nuestra vida cotidiana. Durante años pensamos que esta teoría implicaba que la red estaría vacía, un desierto digital poblado por máquinas hablando solas. La realidad de 2026 ha demostrado ser mucho más perversa. Internet no está vacío, sino hiperpoblado por entidades que simulan ser nosotros.

La muerte del termómetro social

La diferencia crítica con los bots de 2020 es la capacidad de razonamiento e inferencia. Los agentes autónomos actuales, impulsados por modelos derivados de o3 y Gemini 3, no se limitan a repetir consignas o inflar contadores de «me gusta». Estos sistemas poseen memoria, contexto y la capacidad de ejecutar cadenas de pensamiento complejas para generar argumentos persuasivos, matizados y emocionalmente calibrados.

Esta sofisticación técnica ha destruido el termómetro social básico sobre el que se asientan las democracias liberales modernas. Hasta ahora, asumíamos que una gran movilización en redes sociales, una tendencia masiva en Twitter o una avalancha de comentarios en una noticia reflejaban, con mayor o menor precisión, un estado de opinión pública real. Ese axioma ha quedado obsoleto. En la era de la democracia sintética, la percepción de consenso es un producto manufacturable a escala industrial. Un actor estatal o una corporación con suficientes recursos de cómputo puede desplegar miles de agentes autónomos que no solo apoyan una causa, sino que debaten entre sí, crean disidencia controlada, generan memes contextuales y tejen una narrativa orgánica indistinguible de la realidad sociológica.

El impacto psicológico de este entorno es devastador para el ciudadano medio. Navegar por la web hoy implica una carga cognitiva constante, una sospecha paranoica de fondo donde cada interacción debe ser auditada mentalmente. Ya no leemos un comentario polémico y pensamos en la persona que lo escribió; nos preguntamos qué modelo de lenguaje lo generó y con qué objetivo de optimización.

Algocracia y el bucle cerrado

Esta desconfianza erosiona el tejido cívico necesario para el debate público. Si no podemos acordar si nuestro interlocutor es un ser humano con derechos civiles o un script ejecutándose en un servidor de Virginia, la empatía y la posibilidad de persuasión política desaparecen. Nos encerramos en silos de confirmación no porque busquemos eco, sino porque son los únicos refugios donde sentimos cierta seguridad ontológica.

La respuesta de las grandes plataformas tecnológicas ha sido acelerar hacia lo que los expertos denominan la «Algocracia» o gobierno algorítmico. Ante la imposibilidad humana de moderar petabytes de contenido sintético generado cada segundo, hemos delegado la función de árbitros de la verdad a otros modelos de inteligencia artificial. Se ha creado así un bucle de retroalimentación cerrado: IAs que generan contenido para persuadir a otras IAs que actúan como filtros, mientras los humanos quedamos relegados a meros espectadores pasivos de esta guerra adversarial. Las decisiones sobre qué discurso es legítimo, qué es desinformación y qué es «slop» (ruido sintético) se toman en cajas negras opacas, basándose en probabilidades estadísticas y no en principios éticos o legales transparentes.

Para intentar salvar lo que queda de la confianza digital, estamos viendo el surgimiento apresurado de estándares de procedencia como el C2PA y sistemas de verificación biométrica vinculados a la identidad real, como las últimas iteraciones de World ID.

El refugio en el «Bosque Oscuro»

Sin embargo, esta solución plantea un nuevo dilema democrático: la creación de un internet de dos velocidades. Por un lado, una red «limpia», verificada y premium, donde la identidad humana es un lujo que garantiza acceso a servicios y debates reales; por otro, una «dark forest» o bosque oscuro de acceso libre, inundado de ruido sintético y estafas cognitivas, donde quedan atrapados quienes no pueden pagar la verificación o se niegan a ceder sus datos biométricos. La privacidad, paradójicamente, se ha convertido en sospecha. En el Novaceno, el anonimato es indistinguible de la artificialidad.

Las implicaciones electorales de este escenario son inmediatas y aterradoras. En un año donde se celebran comicios clave en varias potencias globales, la capacidad de inundar el ecosistema informativo con realidades alternativas personalizadas pone en jaque la idea misma del voto informado. Ya no se trata de fake news burdas como videos manipulados, sino de la erosión de la realidad compartida. Si cada votante habita un universo de hechos diseñados a medida por algoritmos de maximización de engagement, la base común necesaria para la negociación política se disuelve. La política deja de ser el arte de convencer al oponente para convertirse en una gestión de tribus digitales aisladas en realidades paralelas.

El futuro inmediato de la red parece dirigirse hacia una fragmentación radical. Es probable que veamos un éxodo masivo de la «plaza pública» abierta hacia comunidades privadas, servidores encriptados y redes de confianza pequeñas donde la prueba de humanidad sea la interacción física previa. La democracia, tal como la conocíamos, dependía de una infraestructura de información que era, defectuosa pero fundamentalmente humana. Al perder ese sustrato, entramos en territorio desconocido. El reto del Novaceno no es tecnológico, sino antropológico: debemos decidir si la eficiencia y la comodidad de la intermediación sintética valen el precio de nuestra autonomía colectiva.