Kimi k2.6 consolida la era de los agentes autónomos con su nueva arquitectura open source

Resumen técnico de Kimi k2.6

El núcleo operativo Moonshot AI redefine el panorama del código abierto con una infraestructura diseñada desde cero para la programación de largo horizonte y la orquestación autónoma de enjambres de agentes técnicos.

Implementación de un motor MoE de 1 trillón de parámetros que activa únicamente 32B por token para maximizar la eficiencia algorítmica. Se integra nativamente el codificador visual MoonViT (400M), garantizando una comprensión multimodal unificada sin depender de procesos intermedios externos.

- Ejecución ininterrumpida Resiliencia comprobada para mantener la coherencia lógica durante más de 12 horas asumiendo reescrituras estructurales de código y optimizaciones de hardware locales.

- Enjambres de agentes Despliegue simultáneo de hasta 300 subagentes que coordinan investigación profunda, generación de código y validación en un único ciclo de ejecución.

- Diseño impulsado por código Capacidad para orquestar interfaces front-end complejas y despliegues full-stack que incluyen aprovisionamiento de bases de datos y sistemas de autenticación nativos.

La arquitectura iguala o supera a soluciones cerradas de la talla de GPT-5.4 y Claude Opus 4.6 en métricas de evaluación crítica de ingeniería de software (SWE-Bench Pro) y razonamiento lógico-visual, todo ello con una reducción drástica del coste operativo.

La consolidación de los sistemas como Claw Groups democratiza el despliegue de inteligencias operativas persistentes. El desarrollador transmuta definitivamente su rol de ejecutor de sintaxis al de arquitecto y orquestador, gestionando equipos híbridos de agentes locales y en la nube coordinados.

El panorama de la inteligencia artificial de este 2026 acaba de sufrir una sacudida tectónica. Hoy, veinte de abril, Moonshot AI ha desplegado Kimi K2.6, un modelo de código abierto bajo licencia MIT modificada que abandona definitivamente el paradigma de los chatbots conversacionales para establecerse como una infraestructura pura de orquestación técnica. Este lanzamiento no es una simple iteración de su predecesor de enero, sino una reconstrucción profunda diseñada específicamente para la programación de largo horizonte y la ejecución ininterrumpida de enjambres de agentes. Con los pesos ya disponibles en los repositorios públicos, el ecosistema independiente tiene por primera vez acceso a una tecnología capaz de rivalizar e incluso superar en métricas de agencia a los titanes privativos como GPT-5.4 o Claude Opus 4.6.

Anatomía de un motor de razonamiento de un billón de parámetros

Kimi K2.6 opera sobre una arquitectura de mezcla de expertos masiva que equilibra la fuerza bruta con una eficiencia algorítmica extrema. El modelo cuenta con un billón de parámetros en total, pero su diseño de enrutamiento permite que solo treinta y dos mil millones se activen por cada token procesado. Esta proeza técnica se consigue distribuyendo la carga a través de trescientos ochenta y cuatro expertos especializados, utilizando un mecanismo de atención latente multicabeza acoplado a activaciones SwiGLU. En términos de infraestructura, esto significa que el modelo requiere una fracción del cómputo que necesitaría una red densa tradicional, manteniendo una ventana de contexto nativa y estable de doscientos cincuenta y seis mil tokens.

La comprensión multimodal también ha sido rediseñada desde sus cimientos. Kimi K2.6 descarta las soluciones parcheadas en favor de MoonViT, un codificador de visión integrado de cuatrocientos millones de parámetros que procesa imágenes y vídeo de forma nativa. Esta fusión estructural permite al modelo ingerir referencias visuales complejas y devolver salidas que combinan texto y estructuras visuales sin pérdida de contexto entre modalidades, algo vital para el desarrollo de interfaces generadas dinámicamente.

Ejecución ininterrumpida y enjambres de alta densidad

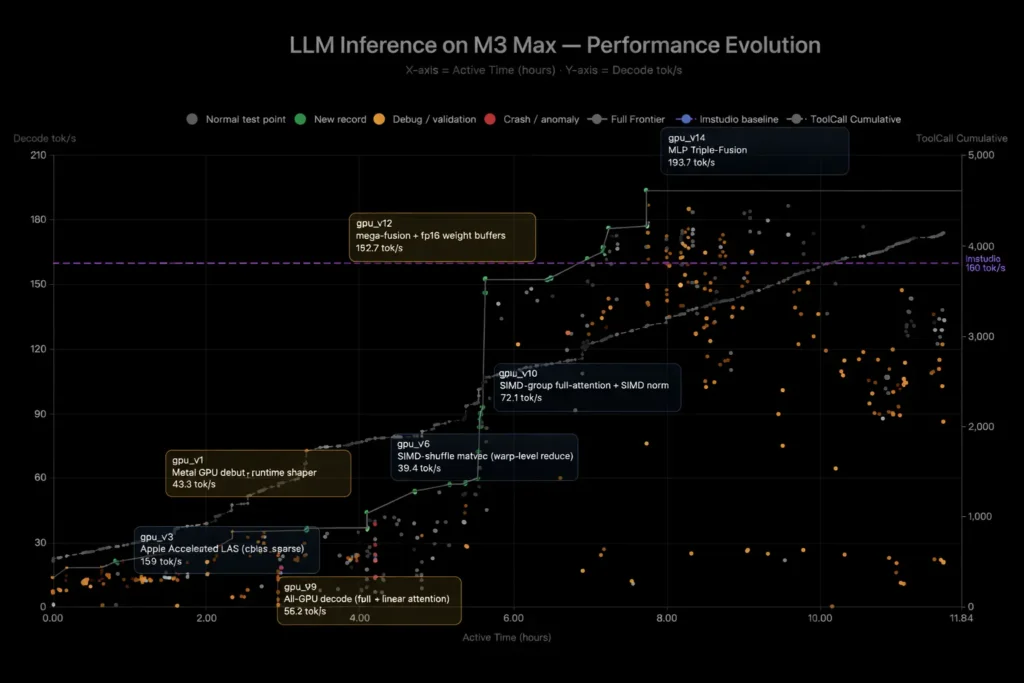

La verdadera métrica que define a esta generación no es la precisión en exámenes estáticos, sino la resiliencia en la ejecución continua. Kimi K2.6 ha demostrado la capacidad de sostener más de cuatro mil llamadas a herramientas en sesiones ininterrumpidas de doce horas sin sufrir degradación lógica. Un caso empírico documentado por la comunidad ilustra cómo un agente autónomo logró descargar un modelo local en hardware de Apple, analizar un motor de inferencia y reescribirlo completamente en Zig, un lenguaje de nicho altamente restrictivo. Tras múltiples iteraciones de compilación y prueba, el modelo incrementó el rendimiento de procesamiento desde quince hasta casi doscientos tokens por segundo, superando a plataformas comerciales dedicadas.

Esta capacidad de concentración técnica se multiplica exponencialmente mediante la arquitectura de enjambre de agentes. Kimi K2.6 ha elevado el límite operativo permitiendo el despliegue de hasta trescientos subagentes heterogéneos que trabajan en paralelo, ejecutando miles de pasos coordinados para completar proyectos titánicos. Un solo mandato en lenguaje natural es suficiente para que el coordinador divida el trabajo, asigne subtareas de investigación, modifique decenas de archivos de código simultáneamente y ensamble el producto final.

Integración nativa del diseño visual y despliegue full stack

La influencia de MoonViT y la ventana de contexto expandida dotan a Kimi K2.6 de una fluidez inusitada para el diseño impulsado por código. El modelo interpreta directrices estéticas complejas y maquetas visuales para generar interfaces de usuario de alta fidelidad, implementando directamente ecosistemas tecnológicos modernos como React 19, TypeScript y clases de Tailwind. A diferencia de las herramientas de generación web estática del pasado, este motor inyecta sombreadores WebGL interactivos y animaciones cinemáticas complejas, validando la geometría del espacio visual directamente en el código base.

El avance se extiende hacia el backend, consolidando flujos de trabajo full stack completos. Durante las pruebas de autonomía, Kimi K2.6 ha sido capaz de construir plataformas desde cero, aprovisionando bases de datos, configurando la gestión de sesiones seguras y estableciendo la lógica de autenticación del usuario. Este nivel de resolución de dependencias permite que los ingenieros deleguen la construcción de la arquitectura base y se enfoquen exclusivamente en la lógica de negocio y la escalabilidad del sistema.

Repercusiones en el ecosistema corporativo y el trabajo colaborativo

El impacto de este modelo trasciende el ámbito del código abierto para alterar la economía de las inteligencias operativas. A nivel de consumo de interfaz de programación, la propuesta de Moonshot AI resulta de tres a cinco veces más económica que las alternativas de Anthropic o OpenAI, reventando la barrera de entrada para startups que desarrollan agentes continuos operando veinticuatro horas al día. Proyectos como OpenClaw o Hermes Agent ya están utilizando Kimi K2.6 como su columna vertebral para gestionar servidores y responder a incidentes sin supervisión humana.

La introducción de los grupos de colaboración, o Claw Groups, materializa finalmente la visión de un espacio de trabajo compartido entre entidades biológicas y sintéticas. En estos entornos, desarrolladores humanos pueden traer sus propios agentes locales, integrarlos con instancias en la nube y colaborar en tiempo real. Kimi K2.6 asume el rol de coordinador maestro, detectando bloqueos en subagentes, reasignando tareas y garantizando que el flujo de producción no se detenga. Aunque la ejecución local en máxima precisión todavía demanda cantidades masivas de memoria unificada, las técnicas de cuantización aseguran que este nivel de orquestación técnica descentralizada ya esté arraigando en los equipos de ingeniería de todo el mundo.

El pulso frente a los modelos de código cerrado en 2026

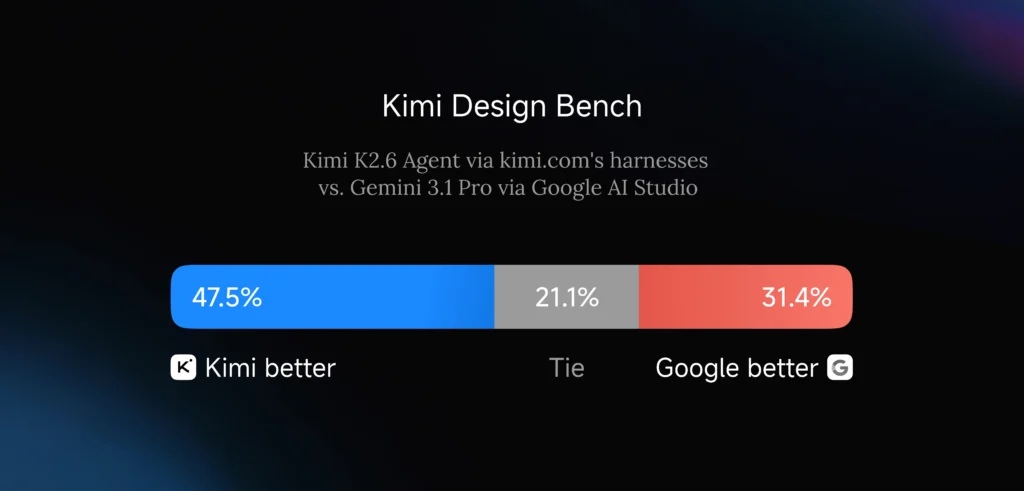

Los datos arrojados por las evaluaciones de rendimiento sitúan a esta iteración open source en un enfrentamiento directo con arquitecturas privativas como GPT-5.4, Claude Opus 4.6 y Gemini 3.1 Pro. En métricas críticas de razonamiento lógico y matemático de frontera, K2.6 entrega resultados equiparables a los modos de pensamiento intensivo de sus competidores. Destaca especialmente su rendimiento en la resolución de problemas de ingeniería de software a gran escala, donde su estabilidad en ventanas de contexto expansivas y una precisión casi absoluta en la invocación de herramientas le permiten superar la ineficiencia cíclica que afectaba a la generación anterior.