Europa activa el cerco regulatorio a la inteligencia artificial de alto riesgo

Resumen Estructurado: AI Act y el Cerco de Alto Riesgo

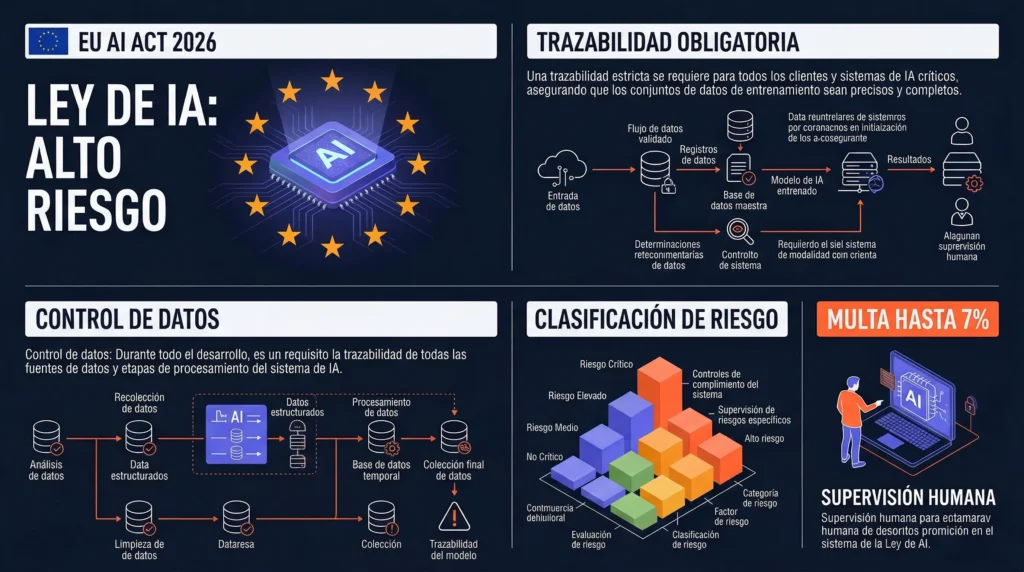

El contexto: A partir del 2 de agosto de 2026, la Ley de Inteligencia Artificial de la UE impone auditorías técnicas obligatorias a los algoritmos de alto riesgo, poniendo fin definitivo a la era de la autorregulación tecnológica.

Las empresas deben demostrar gobernanza de datos, eliminando sesgos discriminatorios y manteniendo registros criptográficos. Se impone la trazabilidad total y la garantía técnica de que siempre existirá un operador humano con capacidad de veto.

Herramientas automáticas de selección de personal, gestión hospitalaria o control de infraestructuras críticas que fallen en su evaluación de conformidad serán retiradas de forma inmediata y cautelar del mercado europeo.

Las sanciones escalan hasta un 7% de la facturación global de las compañías. El alto coste burocrático de certificar estos algoritmos amenaza con asfixiar al ecosistema open weights y a las startups frente al inagotable músculo de las corporaciones transnacionales.

«En 2026, la transparencia algorítmica deja de ser un valor de relaciones públicas para convertirse en un imperativo técnico de supervivencia comercial.»

La inteligencia artificial ha dejado de ser una promesa tecnológica lejana para integrarse profundamente en la infraestructura crítica y los procesos corporativos cotidianos de nuestra sociedad. Desde el filtrado automatizado de currículos hasta la gestión de redes energéticas o los diagnósticos médicos predictivos, los algoritmos operan en la sombra tomando decisiones de impacto masivo. Ante esta realidad insoslayable, la Unión Europea materializa uno de los hitos regulatorios más ambiciosos y complejos de la década. A partir del dos de agosto de 2026, la Ley de Inteligencia Artificial o AI Act despliega todo su peso sancionador sobre los sistemas clasificados como de alto riesgo, obligando a las empresas a someter sus arquitecturas algorítmicas a controles estrictos y auditorías continuas en todos los Estados miembros. Este movimiento marca el fin definitivo de la era de la autorregulación voluntaria y establece un estándar global de cumplimiento legal riguroso.

El camino hacia este punto de inflexión no ha sido repentino, sino que obedece a un calendario de aplicación escalonada diseñado para absorber el impacto operativo en la industria tecnológica. Mientras que en febrero de 2025 se implementaron las prohibiciones absolutas sobre prácticas de riesgo inaceptable y en agosto de ese mismo año entraron en vigor las normativas de transparencia para los modelos de propósito general, el verano de 2026 representa la verdadera prueba de fuego para el tejido empresarial europeo e internacional que opere en la región. Las compañías ya no solo deben declarar con intenciones comerciales qué hace su software, sino demostrar empírica y documentalmente que sus redes neuronales no discriminan, no alucinan en entornos críticos y mantienen a los seres humanos en el centro irremplazable de la toma de decisiones finales.

Arquitectura de cumplimiento y trazabilidad técnica

El nuevo marco normativo no se conforma con auditorías superficiales ni certificaciones de papel, sino que exige una reingeniería profunda en la forma en que se diseñan, entrenan y despliegan los modelos computacionales. Las empresas proveedoras y operadoras de sistemas de alto riesgo deben implementar un sistema continuo de gestión de riesgos que abarque absolutamente todo el ciclo de vida del algoritmo. Esta exigencia transforma el desarrollo de software en una disciplina casi clínica, donde cada parámetro, cada optimización de inferencia y cada actualización de pesos estructurales debe estar justificada bajo estrictos y comprobables criterios de seguridad.

Para cumplir con estas directrices ineludibles, las organizaciones están obligadas a adoptar prácticas de gobernanza de datos exhaustivas. El objetivo primordial es garantizar que los conjuntos de entrenamiento, validación y prueba estén libres de sesgos sistémicos, representen adecuadamente a las minorías demográficas y cumplan con parámetros de calidad inquebrantables. Ya no es legalmente aceptable el raspado masivo de datos sin control de procedencia ni la ingestión de información contaminada. Además, la normativa exige mantener una documentación técnica dinámica y metódica que registre las especificaciones de diseño estructural, las limitaciones inherentes de la inferencia matemática y los registros de actividad o logs del sistema. La trazabilidad se convierte así en un imperativo criptográfico y operativo indispensable, donde cada decisión automatizada que afecte los derechos fundamentales de un ciudadano debe poder ser explicada, decodificada y auditada a posteriori por peritos informáticos.

La supervisión humana se erige como otro de los pilares técnicos fundamentales impuestos por Bruselas. Las interfaces de control de estos sistemas de alto riesgo deben diseñarse desde su concepción inicial de manera que los operadores humanos puedan comprender el razonamiento subyacente de la máquina, intervenir en tiempo real para corregir derivas e, incluso, anular las decisiones automatizadas mediante mecanismos físicos o lógicos de apagado de emergencia. Esto requiere el despliegue de herramientas de interpretabilidad avanzadas, alejándose inexorablemente de los modelos de caja negra impenetrables que dominaron los primeros compases de la revolución del aprendizaje profundo y acercándose a las arquitecturas modernas de razonamiento verificable.

Impacto operativo en la selección de personal y la infraestructura crítica

El impacto de esta estricta regulación es de carácter transversal, pero golpea con una intensidad sin precedentes a aquellos sectores concretos donde la inteligencia artificial actúa como juez y parte en el desarrollo vital y profesional de los ciudadanos. Un ejemplo claro y urgente en este año 2026 es el de los departamentos de recursos humanos y las corporaciones multinacionales dedicadas a la selección de personal. Las plataformas informáticas que utilizan modelos lingüísticos avanzados y agentes autónomos para cribar decenas de miles de currículos, clasificar aptitudes técnicas o emparejar candidatos con ofertas laborales entran de lleno en la categoría de alto riesgo estrictamente regulada en los anexos de la directiva europea.

Si un sistema de reclutamiento algorítmico falla en una evaluación de conformidad o demuestra poseer desviaciones estadísticas discriminatorias de género, raza o edad, las empresas responsables se enfrentan a la retirada inmediata y cautelar de la herramienta del mercado tecnológico. Para una agencia cuyo modelo de negocio dependa centralmente del cribado asistido por inteligencia artificial, esta desconexión en pleno contrato supondría una interrupción operativa crítica y pérdidas económicas potencialmente irrecuperables. Cabe destacar que las empresas ya no pueden delegar la responsabilidad legal en sus proveedores tecnológicos externos bajo el pretexto del desconocimiento técnico, ya que quienes implementan o despliegan el algoritmo son tan responsables ante los tribunales como los ingenieros que lo han entrenado originalmente.

De igual forma, los componentes de seguridad basados en inteligencia artificial que operan dentro de infraestructuras críticas enfrentan escrutinios draconianos y sin precedentes. Los sistemas encargados de la optimización y gestión semafórica, el control adaptativo de las redes de suministro eléctrico o la dosificación milimétrica de tratamientos médicos hospitalarios deben demostrar mediante rigurosas evaluaciones de conformidad dictadas por terceros que su tasa de error o alucinación es estadísticamente nula. La legislación continental busca evitar a toda costa que un fallo en cascada de un enjambre de agentes autónomos comprometa la seguridad física, la integridad humana o la estabilidad estructural de los servicios esenciales de las ciudades.

El coste de la ética algorítmica y la presión sobre la innovación

La imposición obligatoria de este complejo entramado de controles estrictos plantea un debate ético, técnico y económico de enorme calado, situando a Europa en la difícil encrucijada de equilibrar la protección de los derechos civiles con la viabilidad del ecosistema innovador regional. Por un lado, la normativa blinda de forma pionera a los ciudadanos frente a decisiones opacas de las máquinas, manipulaciones masivas encubiertas y abusos derivados de la biometría indiscriminada. Las herramientas coercitivas que acompañan a la ley son formidables, estableciendo multas administrativas que pueden escalar vertiginosamente hasta el siete por ciento del volumen de negocios anual mundial para aquellas corporaciones que incurran en prácticas directamente prohibidas, y hasta un tres por ciento para quienes incumplan negligentemente las obligaciones de trazabilidad de los sistemas de alto riesgo.

Sin embargo, contemplado desde las trincheras del desarrollo tecnológico y los laboratorios de inteligencia artificial, la carga burocrática y los elevadísimos costes financieros asociados a la certificación técnica amenazan con asfixiar la agilidad intrínseca de las empresas emergentes y comprometer seriamente la supervivencia de los proyectos impulsados por el código abierto o los pesos abiertos. Las auditorías algorítmicas requeridas, la monitorización telemétrica constante y la acuciante necesidad de contar con departamentos enteros de especialistas legales crean una barrera de entrada formidable. Existe un temor fundamentado entre los ingenieros y analistas de que esta regulación termine forzando una centralización del mercado en torno a los grandes gigantes tecnológicos internacionales, entidades que sí disponen del músculo financiero y la infraestructura corporativa para absorber los masivos costes regulatorios sin inmutarse, dejando a la innovación europea local en un escenario de clara desventaja competitiva.

Adicionalmente, el paisaje regulatorio sobre la inteligencia artificial sigue siendo un ente orgánico, altamente politizado y sujeto a continuas revisiones de emergencia. Los recientes debates parlamentarios surgidos en la primavera de 2026 en torno a nuevos paquetes legislativos de actualización reflejan la tensión perpetua del legislador por no quedarse obsoleto. Las discusiones recientes para incluir medidas punitivas más contundentes contra la generación automatizada de contenido hiperrealista no consentido evidencian que legislar sobre redes neuronales y agentes reflexivos en constante y veloz evolución es un ejercicio de equilibrismo extremo. Las instituciones europeas se esfuerzan de manera loable por mantener una seguridad jurídica robusta y protectora, pero a menudo chocan de frente con la aceleración tecnológica exponencial, demostrando fehacientemente que en la actual era del razonamiento artificial, la maquinaria legislativa siempre correrá un paso por detrás del código fuente.

Fuentes verificadas

- 01. The EU AI Act: 6 Steps to Take Before 2 August 2026

- 02. AI Act Shaping Europe’s digital future

- 03. Qué implica la Ley de IA de la UE para las empresas de selección de personal

- 04. Ley de Inteligencia Artificial: claves del reglamento y su impacto

- 05. Europa reconfigura su ley de IA: margen para las empresas y nuevas prohibiciones