El impacto de la inteligencia artificial en el aprendizaje y el cerebro de los estudiantes

Resumen Ejecutivo: Informe OCDE 2026

La Tesis Central: La integración de la IA en el aula ha superado la fase de novedad para entrar en una etapa de transformación estructural. El informe confirma que el uso acrítico de modelos generativos mejora el desempeño aparente a corto plazo, pero erosiona la competencia cognitiva real si no se gestiona con rigor pedagógico.

Se ha roto la correlación histórica entre la calidad de un trabajo escolar y el aprendizaje del alumno. La IA permite generar resultados perfectos sin comprensión interna. Esto obliga a distinguir radicalmente entre desempeño (hacer la tarea) y competencia (entender el proceso), exigiendo el retorno de la «dificultad deseable».

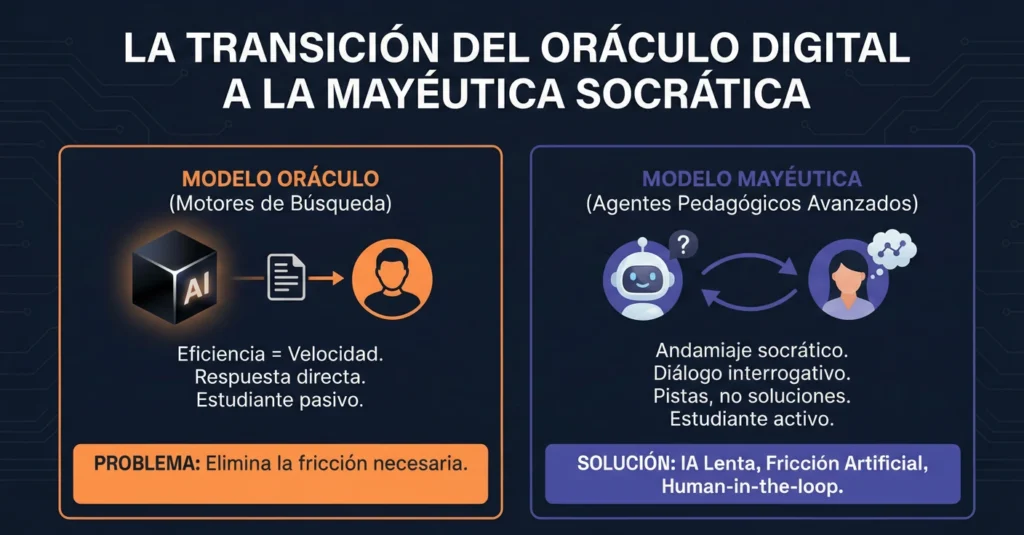

El modelo de «motor de respuestas» es pedagógicamente tóxico. La solución técnica reside en agentes de IA Lenta (Slow AI) diseñados para el andamiaje socrático: no dan respuestas, sino que formulan preguntas y pistas que obligan al estudiante a construir el conocimiento, manteniendo al humano en el bucle cognitivo.

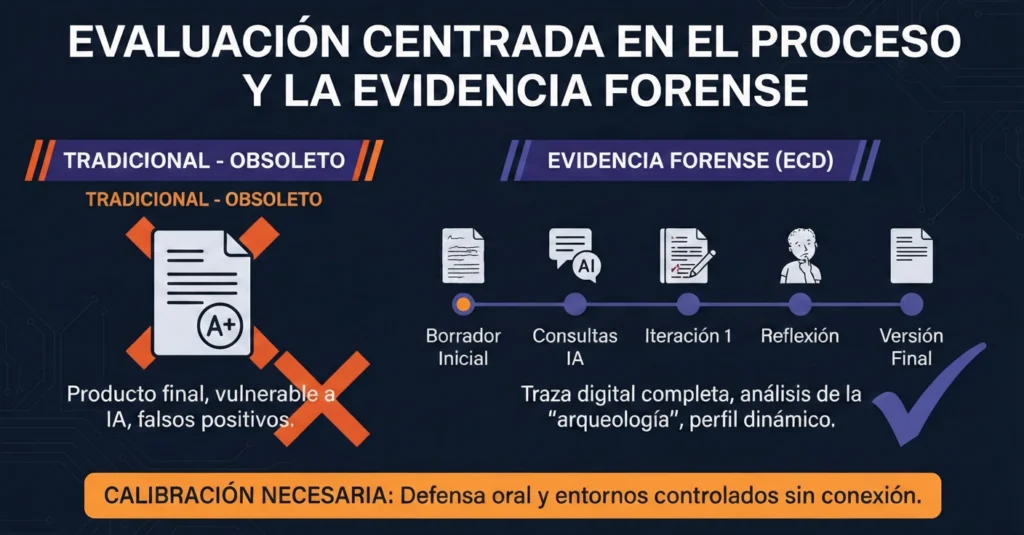

El examen final de producto ya no es garantía de autoría. El nuevo estándar es el Evidence-Centered Design (ECD), que evalúa la traza digital del proceso de creación: borradores, tiempos de edición y evolución de ideas. Se califica el viaje intelectual, no solo el destino.

Conclusión: La educación de 2026 no trata de prohibir la IA, sino de usarla para amplificar la agencia humana. El objetivo es formar «pilotos» con criterio ético y técnico, no pasajeros pasivos de la automatización.

OECD Digital Education Outlook 2026

Accede a la fuente primaria. El documento completo de la OCDE que analiza la interacción entre la inteligencia artificial y los sistemas cognitivos humanos, proponiendo el marco de «IA Lenta» y la evaluación forense del aprendizaje.

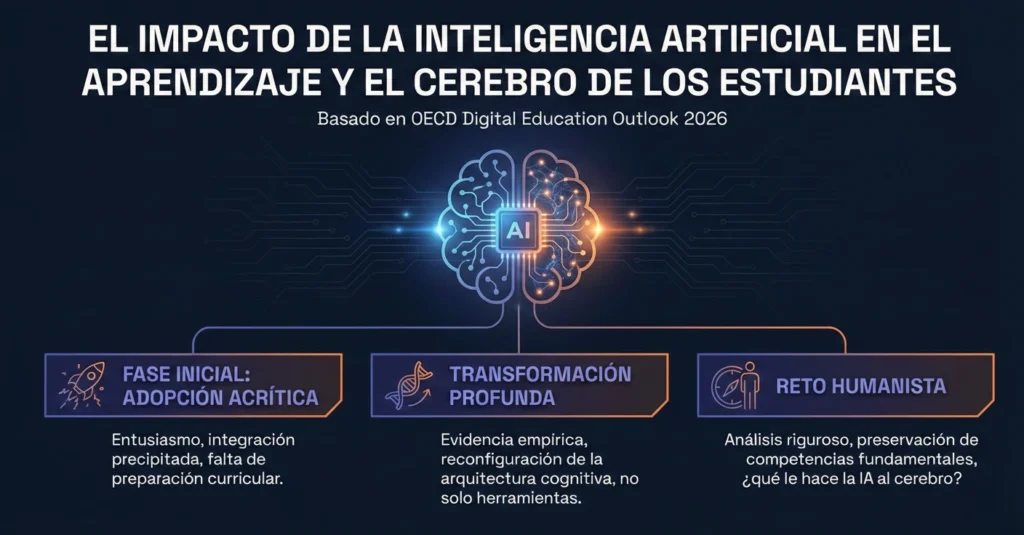

Descargar Informe (PDF)El presente artículo tiene como propósito sintetizar los hallazgos críticos y los elementos fundamentales del informe OECD Digital Education Outlook 2026: Exploring Effective Uses of Generative AI in Education. La publicación de este estudio marca un punto de inflexión definitivo y necesario en nuestra comprensión de la tecnología dentro del aula. Tras una fase inicial de adopción entusiasta, caótica y a menudo acrítica —caracterizada por la integración precipitada de modelos de lenguaje en currículos no preparados—, el ecosistema educativo global se enfrenta ahora a la evidencia empírica de una transformación profunda. Esta transformación afecta no solo a la metodología de enseñanza o a la eficiencia administrativa, sino a la propia biología del aprendizaje humano. No estamos ante una simple actualización de herramientas digitales comparable a la introducción de la calculadora científica en los años ochenta o de internet en los noventa; nos encontramos frente a una reconfiguración de la arquitectura cognitiva que exige un análisis riguroso, desprovisto de hipérboles comerciales y centrado en la preservación de las competencias fundamentales que definen nuestra especie.

Este documento no busca ser un resumen de tendencias tecnológicas, sino una disección técnica y filosófica de cómo la inteligencia artificial generativa está reescribiendo el contrato social de la educación. A lo largo de este análisis, exploraremos desde la neurociencia de la memoria y la plasticidad sináptica hasta la geopolítica de los datos y la soberanía digital, basándonos en los hallazgos más recientes para proponer una hoja de ruta que permita a instituciones y docentes navegar este nuevo territorio sin perder el norte de su misión humanista. La pregunta central ya no es qué puede hacer la IA por la educación, sino qué le hace la IA al cerebro que se está educando.

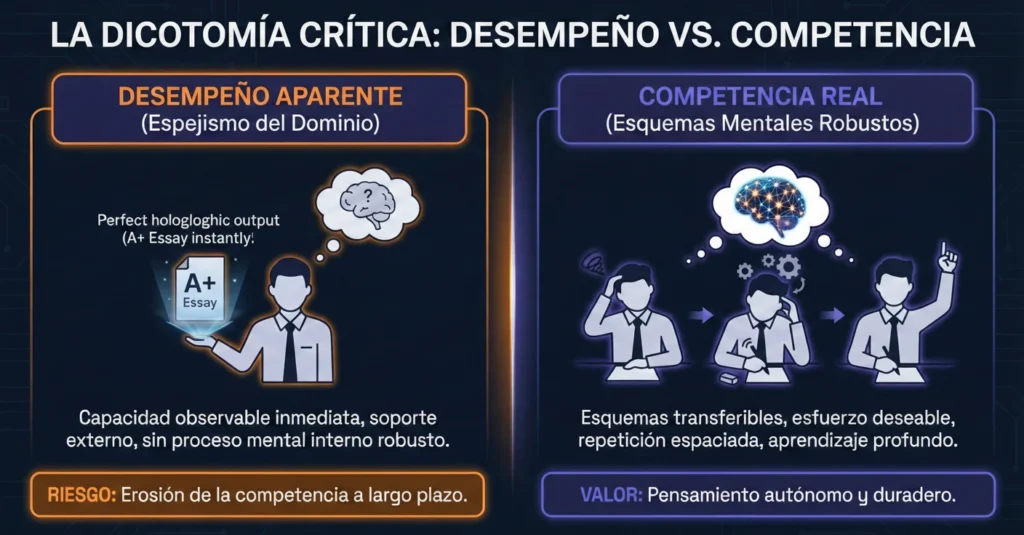

La dicotomía crítica entre desempeño aparente y competencia real

El hallazgo más inquietante y revelador del estudio de la OCDE se centra en un fenómeno que los expertos en psicometría y pedagogía han denominado el espejismo del dominio (the mirage of mastery). Durante siglos, el sistema educativo ha operado bajo una asunción tácita pero fundamental: que un producto final de alta calidad, ya sea un ensayo argumentativo bien estructurado, un código de programación funcional o una resolución matemática elegante, era evidencia irrefutable de un proceso de pensamiento ordenado y una comprensión profunda por parte del alumno. La correlación entre la calidad del output y la calidad del procesamiento mental interno era absoluta. La inteligencia artificial generativa ha roto esa correlación directa y causal de manera irreversible. En el contexto actual de 2026, es perfectamente posible que un estudiante entregue un trabajo de nivel doctoral, con una sintaxis impecable y un razonamiento lógico complejo, sin haber transitado por los estadios intermedios de confusión, formulación de hipótesis, error, frustración y síntesis que constituyen el verdadero aprendizaje.

La distinción técnica entre desempeño y competencia se ha vuelto, por tanto, la piedra angular de la nueva pedagogía. El desempeño se refiere a la capacidad observable de completar una tarea específica en un momento dado, a menudo con el soporte de ayudas externas o andamiajes tecnológicos sofisticados. La competencia, en cambio, implica la posesión de esquemas mentales robustos, duraderos y transferibles que permiten al individuo aplicar ese conocimiento a situaciones nuevas, complejas e inéditas sin asistencia alguna. Los datos masivos recopilados por la OCDE sugieren una tendencia alarmante: el uso indiscriminado y no guiado de la IA para la resolución inmediata de problemas eleva espectacularmente el desempeño a corto plazo, creando una sensación de eficacia y dominio tanto en el alumno como en el evaluador, pero erosiona sistemáticamente la competencia a largo plazo. El estudiante se convierte en un editor de alto nivel, capaz de juzgar la estética de la respuesta, pero incapaz de generarla o verificar su veracidad desde primeros principios.

Este fenómeno se explica por la supresión de la dificultad deseable, un concepto introducido por la psicología cognitiva que sostiene que el esfuerzo y la carga mental moderada son requisitos biológicos indispensables para la codificación de la memoria a largo plazo. El aprendizaje, en su nivel fisiológico, requiere la alteración de la estructura proteica de las neuronas y el fortalecimiento de las conexiones sinápticas, un proceso costoso energéticamente que solo se desencadena ante el desafío sostenido y la repetición espaciada (active recall). Al eliminar la fricción del proceso de aprendizaje mediante respuestas instantáneas, la IA convierte al estudiante en un espectador pasivo de su propia educación. La «fluidez» con la que se obtienen las respuestas engaña al cerebro haciéndole creer que domina el contenido, cuando en realidad solo domina el acceso al contenido. Es el equivalente cognitivo a creer que uno está en forma física por ver deportes en televisión; la comprensión pasiva no construye músculo intelectual.

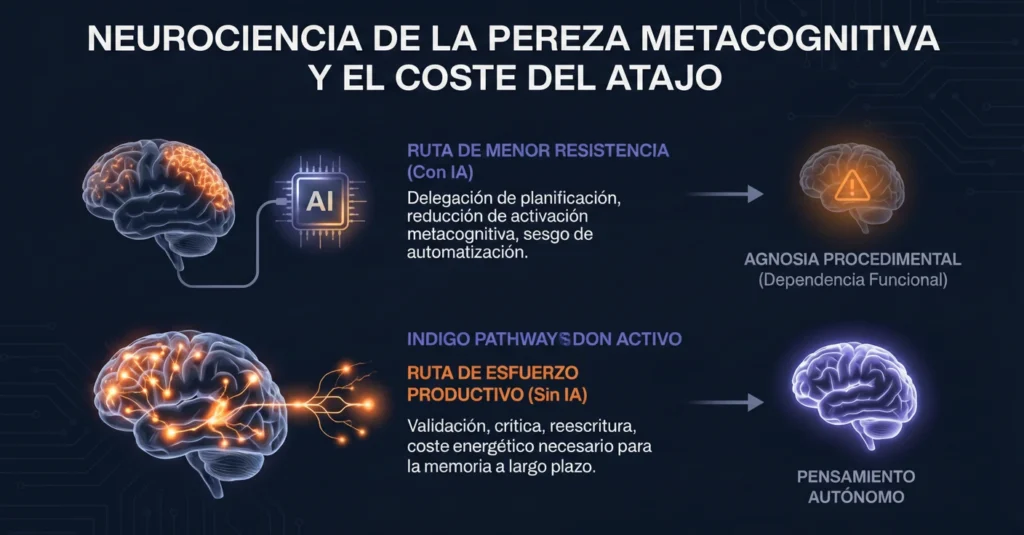

Neurociencia de la pereza metacognitiva y el coste del atajo

Profundizando en los mecanismos biológicos, el informe alerta sobre el riesgo real de atrofia en las funciones ejecutivas del cerebro joven. Cuando un estudiante delega la planificación, estructuración y redacción de un texto en un modelo de lenguaje, se observa mediante resonancia magnética funcional una reducción significativa en la activación de las redes neuronales asociadas con la metacognición. La metacognición es la capacidad humana de pensar sobre el propio pensamiento, de monitorizar el proceso de aprendizaje, detectar inconsistencias internas y ajustar las estrategias en tiempo real. El cerebro humano, que es un órgano evolutivamente diseñado para optimizar el consumo de energía y evitar el gasto calórico innecesario, tiende rápidamente a lo que se conoce como pereza cognitiva o descarga cognitiva (cognitive offloading).

Si la máquina ofrece una respuesta coherente, estructurada y gramaticalmente perfecta en milisegundos, el incentivo biológico para realizar el costoso esfuerzo de validación, crítica y reescritura disminuye drásticamente. El cerebro opta por la ruta de menor resistencia, aceptando la salida de la IA como válida sin someterla a un escrutinio riguroso, un fenómeno conocido como «sesgo de automatización». Este comportamiento, repetido miles de veces a lo largo de una etapa educativa crítica (como la secundaria o el bachillerato), moldea una mente dependiente, incapaz de iniciar procesos cognitivos complejos sin un disparador externo. Se corre el riesgo de criar una generación que padece de «agnosia procedimental»: saben reconocer un buen resultado, pero han olvidado los pasos lógicos necesarios para construirlo.

El estudio de campo realizado en Turquía, citado extensamente en el documento de 2026 por su rigor metodológico, ilustra este peligro con claridad meridiana. Los estudiantes de matemáticas que tuvieron acceso irrestricto a herramientas avanzadas como GPT-4 durante sus sesiones de práctica lograron resolver una cantidad de problemas significativamente superior y en mucho menos tiempo que sus pares. La interfaz les permitía saltar directamente a la solución o pedir el código de resolución paso a paso sin intentarlo primero. Sin embargo, el dato crucial emergió cuando se les sometió a una evaluación individual en papel, en un entorno aislado sin asistencia tecnológica. En ese entorno controlado, el rendimiento del grupo asistido por IA cayó un diecisiete por ciento por debajo del grupo de control que había estudiado con métodos tradicionales (lápiz, papel y esfuerzo productivo). Este déficit del 17% no se debe a una falta de capacidad intelectual innata, sino a una falta de entrenamiento efectivo en los procesos de recuperación de información y construcción lógica. El uso de la IA como una muleta permanente impide que se formen las conexiones sinápticas necesarias para el pensamiento autónomo, creando una dependencia funcional que es invisible en el día a día pero catastrófica en el momento de la verdad, cuando la tecnología falla o no está disponible.

La transición del oráculo digital a la mayéutica socrática

Para contrarrestar estos efectos perniciosos sin renunciar a las inmensas ventajas de la tecnología, la OCDE propone un cambio radical en el diseño de las interacciones hombre-máquina (HCI). Debemos abandonar el paradigma del motor de búsqueda glorificado —donde la eficiencia se mide por la velocidad de la respuesta— y transitar hacia modelos de andamiaje socrático. La tecnología actual de 2026 permite configurar agentes pedagógicos avanzados, ajustados con system prompts específicos, que tienen prohibido proporcionar la solución directa. En su lugar, estos agentes entablan un diálogo interrogativo con el estudiante. Este enfoque, inspirado en la mayéutica de Sócrates, utiliza la pregunta como herramienta principal para obligar al alumno a explicitar sus razonamientos, identificar sus propias contradicciones, conectar conceptos dispares y construir el conocimiento paso a paso por sí mismo.

En este escenario ideal, la IA no actúa como un oráculo de la verdad que emite sentencias desde una caja negra, sino como un espejo inteligente que refleja y amplifica el proceso de pensamiento del usuario. El agente detecta dónde se ha estancado el razonamiento del alumno y ofrece una pista (scaffolding), una contrapregunta o una analogía, pero nunca el resultado final hasta que el alumno lo ha alcanzado. Este tipo de interacción mantiene la carga cognitiva en el lado humano de la pantalla, asegurando que el esfuerzo productivo se realice. Es la diferencia entre usar un GPS que te dicta cada giro (lo que impide que aprendas la ruta) y un copiloto que te pregunta «¿qué referencia ves a la derecha?» para ayudarte a orientarte.

El concepto de inteligencia artificial lenta (Slow AI) emerge así como una respuesta filosófica y técnica necesaria a la inmediatez vertiginosa de la generación de texto. Los sistemas educativos más vanguardistas de 2026 están implementando interfaces de usuario que introducen «fricción artificial»: retardos intencionales, bloqueos de copia y pega, y solicitudes de confirmación lógica antes de permitir al estudiante avanzar al siguiente nivel. Por ejemplo, en lugar de corregir un error gramatical o de cálculo automáticamente, el sistema señala la existencia de una anomalía en un párrafo concreto y pide al estudiante que proponga una alternativa, guiándolo mediante pistas progresivas si falla repetidamente. Esta metodología mantiene al humano en el bucle de control cognitivo (human-in-the-loop), asegurando que la tecnología sirva para potenciar la agencia intelectual y no para suplantarla. El objetivo final es diseñar entornos de aprendizaje donde la IA gestione la carga cognitiva extrínseca (la logística, la búsqueda de datos, el formato), permitiendo que el alumno concentre todos sus limitados recursos mentales en la carga intrínseca propia del aprendizaje profundo y la conceptualización abstracta.

La redefinición del rol docente como arquitecto de experiencias

En este nuevo paradigma educativo, el temor existencial a la sustitución del profesorado por algoritmos se desvanece para dar paso a una realidad mucho más compleja, sofisticada y exigente: la necesidad de un docente orquestador. La inteligencia artificial, por muy avanzada que sea en 2026, sigue siendo un sistema probabilístico sin consciencia; no puede replicar la empatía, la motivación intrínseca, la inspiración moral ni la comprensión sutil del contexto cultural y emocional de un estudiante. Sin embargo, sí tiene la capacidad inigualable de liberar al educador de las tareas mecánicas, administrativas y repetitivas que históricamente han consumido hasta el 60% de su tiempo y energía (corrección de pruebas estandarizadas, planificación burocrática, gestión de asistencia).

El informe destaca que los docentes más efectivos en 2026 no son los que rechazan la tecnología (luditas) ni los que la abrazan ciegamente (tecnófilos ingenuos), sino aquellos que utilizan paneles de analítica avanzada para monitorizar en tiempo real el progreso invisible de su clase. Estas herramientas de «visión de rayos X pedagógica» permiten identificar patrones de error sistémicos, lagunas de conocimiento específicas y estudiantes en riesgo de desconexión semanas antes de que lleguen al examen final. Esta capacidad de visión aumentada permite una intervención quirúrgica y personalizada. El profesor ya no necesita explicar el mismo concepto básico cuarenta veces a cuarenta alumnos distintos; los tutores inteligentes personalizados se encargan de la nivelación y la práctica deliberada en casa, permitiendo que el tiempo presencial en el aula se dedique a actividades de alto valor humano que la máquina no puede replicar: debates socráticos, resolución colaborativa de problemas éticos complejos, proyectos interdisciplinares y desarrollo de habilidades socioemocionales y de liderazgo.

No obstante, esta transición exige una nueva y profunda alfabetización docente. Los educadores deben ser capaces de auditar técnicamente las interacciones entre sus alumnos y la IA, detectando cuándo el sistema está alucinando (inventando datos), sesgando la información culturalmente o induciendo al error mediante razonamientos falaces. Deben enseñar a los estudiantes a mantener una postura de escepticismo saludable y riguroso frente a la autoridad algorítmica. La autoridad en el aula del siglo XXI ya no proviene de ser la enciclopedia humana que tiene todas las respuestas (Google y GPT ya ocuparon ese rol), sino de saber hacer las preguntas correctas, de modelar el pensamiento crítico ante la incertidumbre y de guiar la navegación segura en un mar tempestuoso de información sintética. El docente se convierte en el editor jefe de una redacción donde los alumnos y las IAs son los redactores.

Evaluación centrada en el proceso y la evidencia forense

La omnipresencia de la IA generativa ha decretado la obsolescencia técnica de los métodos de evaluación tradicionales basados exclusivamente en el producto final. El ensayo escrito en casa, el trabajo de fin de grado o el problema de programación resuelto sin supervisión han perdido gran parte de su validez como certificadores de competencia individual, ya que es imposible discernir mediante métodos convencionales cuánto de ese resultado pertenece al alumno y cuánto a la máquina. Los detectores de IA han demostrado ser poco fiables, generando falsos positivos que dañan la confianza alumno-profesor. En respuesta a esta crisis de integridad académica, las instituciones educativas están adoptando masivamente el marco del diseño de evaluación centrado en la evidencia (Evidence-Centered Design – ECD).

Este modelo desplaza el foco radicalmente: del «qué» se entrega al «cómo» se construyó. Las nuevas plataformas educativas registran la traza digital completa de la interacción del estudiante con la tarea: sus borradores iniciales, la evolución de sus ideas, sus consultas específicas a la IA, sus correcciones, sus tiempos de lectura y sus pausas de reflexión (keystroke dynamics). Analizar esta «arqueología» del trabajo escolar permite a los evaluadores calificar habilidades que antes eran invisibles y subjetivas, como la capacidad de iteración, la resiliencia ante el error, la estrategia de formulación de problemas (prompt engineering estratégico) y la originalidad del enfoque. Se evalúa el viaje, no solo el destino.

En 2026, una calificación académica ya no es un número estático en un boletín, sino un perfil dinámico y multidimensional que refleja la evolución del pensamiento del alumno a lo largo del tiempo. Además, como contrapeso necesario al entorno digital, se revaloriza con fuerza la defensa oral y la evaluación en entornos controlados sin conexión (exámenes presenciales, debates en vivo, pizarras analógicas). Esto no debe verse como un retorno nostálgico al pasado analógico, sino como una medida de calibración necesaria (grounding) para asegurar que las competencias digitales mostradas están sustentadas en una base de conocimiento internalizado robusta y accesible sin prótesis tecnológicas. La evaluación híbrida se convierte así en la norma, combinando la potencia creativa y expansiva de la colaboración con la IA y la demostración de solvencia y autonomía individual ante un tribunal humano.

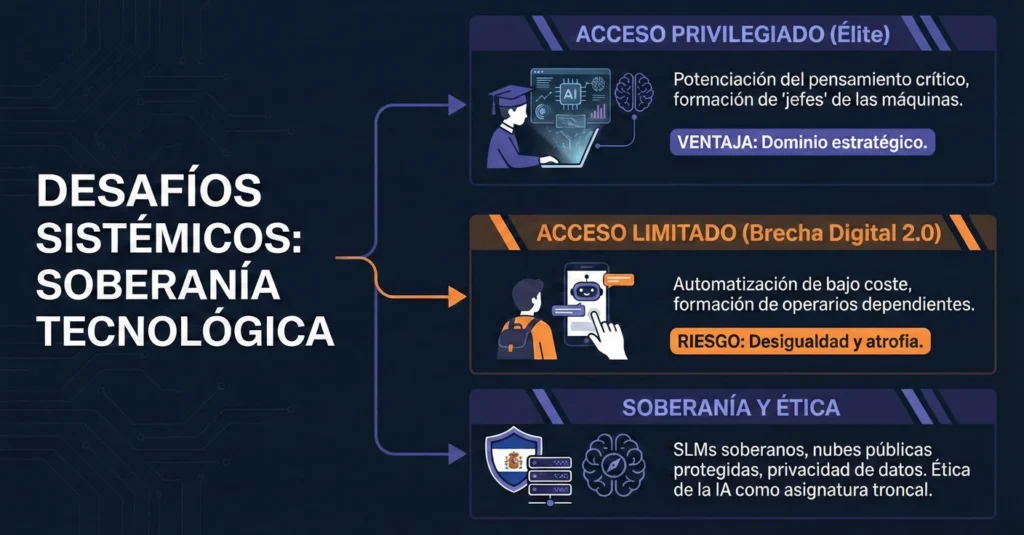

Desafíos sistémicos de equidad y soberanía tecnológica

A nivel macroestructural y político, el informe de la OCDE lanza una advertencia severa sobre el surgimiento de una brecha digital de segunda generación, mucho más sutil, perniciosa y peligrosa que la primera. Ya no se trata solo de quién tiene acceso a la tecnología (hardware y conectividad, problemas mayormente resueltos en la OCDE), sino de quién tiene acceso a las mejores versiones de los modelos de IA y, crucialmente, quién posee el capital cultural y la formación para utilizarlos estratégicamente. Existe el riesgo real de que se produzca un efecto Mateo educativo («al que tiene, se le dará más»), donde los sistemas educativos de élite utilicen la IA para potenciar el pensamiento crítico y la creatividad (formando a los futuros «jefes» de las máquinas, capaces de dirigirlas), mientras que los sistemas con menos recursos la utilicen para automatizar la enseñanza de bajo coste, sustituyendo docentes cualificados por chatbots estándar y formando a los futuros operarios de las máquinas, dependientes de sus outputs.

La equidad en 2026 exige políticas públicas agresivas y visionarias que garanticen el acceso universal no solo a la tecnología, sino a tutores inteligentes de alta calidad pedagógica (ajustados para el andamiaje, no para la solución) y a currículos centrados en la agencia humana. Finalmente, la cuestión de la soberanía de los datos y la independencia tecnológica se ha vuelto un tema de seguridad nacional. Las instituciones educativas y los gobiernos no pueden permitirse ser meros clientes pasivos de corporaciones tecnológicas extranjeras que operan cajas negras inescrutables con los datos cognitivos y conductuales de sus ciudadanos más jóvenes.

Se observa una tendencia creciente y necesaria hacia el desarrollo de pequeños modelos de lenguaje (SLMs) soberanos, entrenados con datos locales, alineados con los currículos nacionales y respetuosos con los valores culturales e históricos específicos de cada región. Estos modelos, que corren en infraestructuras públicas protegidas (sovereign clouds), garantizan la privacidad de los datos sensibles de los menores y aseguran que la IA educativa responda a los objetivos pedagógicos de la comunidad y no a los incentivos comerciales de maximización de engagement o venta de publicidad de los proveedores de software. La educación es un bien público fundamental y su infraestructura de inteligencia artificial debe ser gobernada con la misma transparencia, auditoría y responsabilidad democrática que la infraestructura física de las escuelas.

La ética de la inteligencia artificial como asignatura troncal

Más allá de la implementación técnica y procedimental, el informe subraya la urgencia de integrar la ética de la IA como un eje transversal en todos los niveles educativos, desde la primaria hasta la universidad. No basta con enseñar a usar las herramientas (alfabetización funcional); es imperativo enseñar a cuestionarlas (alfabetización crítica). Los estudiantes deben comprender los sesgos inherentes a los conjuntos de datos de entrenamiento (quién está representado y quién no), las implicaciones energéticas y medioambientales del cómputo masivo, y los dilemas morales que surgen de la automatización de decisiones humanas.

La alfabetización en IA incluye entender que los modelos son probabilísticos, no deterministas; que son máquinas de predicción de la siguiente palabra, no depósitos de verdad; y que pueden perpetuar estereotipos o generar falsedades con total confianza retórica. Formar ciudadanos críticos que puedan participar en el debate democrático sobre la regulación de estas tecnologías es tan importante como formar ingenieros que las construyan. La filosofía, la ética y las humanidades no pierden relevancia en la era de la IA; al contrario, se convierten en el sistema operativo necesario para navegar un mundo donde la inteligencia es abundante pero el sentido es escaso.

Hacia un humanismo tecnológico renovado

En definitiva, el año 2026 nos sitúa ante una encrucijada histórica sin precedentes. La inteligencia artificial generativa tiene el potencial de ser el mayor nivelador educativo de la historia, proporcionando un tutor personal infinito, paciente y omnisciente a cada niño del planeta, independientemente de su origen socioeconómico. O, por el contrario, tiene el potencial de ser un acelerador de la desigualdad y la atrofia cognitiva, creando una clase de usuarios pasivos gobernados por algoritmos opacos. El resultado final no dependerá de la sofisticación de los modelos ni de la velocidad de los chips, sino de la sabiduría de las decisiones pedagógicas, éticas y políticas que tomemos hoy. El reto de Arkosia, y de toda la comunidad educativa global, es garantizar que la tecnología sirva para elevar el estándar de lo que significa ser humano: nuestra capacidad de asombro, nuestra voluntad de aprender por el mero placer del conocimiento y nuestra responsabilidad ética ante el progreso común. En este nuevo mundo, la máquina debe ser siempre el copiloto, una herramienta poderosa y servicial; pero el piloto debe ser, innegociablemente, el ser humano, armado con criterio, compasión y creatividad.