OmniTransfer: ByteDance Unifica la Física del Video Generativo

Resumen Estructurado: OmniTransfer

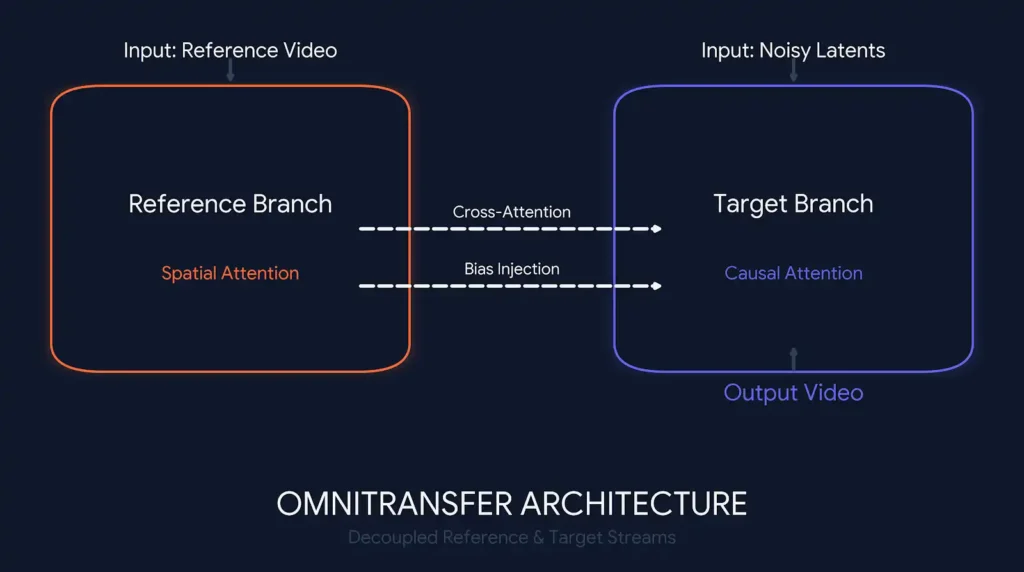

El contexto: La generación de video actual sufre de un conflicto inherente: si priorizas la identidad (el «quién»), pierdes fluidez en el movimiento (el «cuándo»). ByteDance resuelve esto con OmniTransfer, un framework que desacopla arquitectónicamente ambas dimensiones.

Los modelos tradicionales procesan la referencia y el objetivo juntos. Esto provoca que el fondo de la imagen original se mezcle con el nuevo video, o que el movimiento se vuelva rígido. OmniTransfer elimina esto separando los flujos de datos.

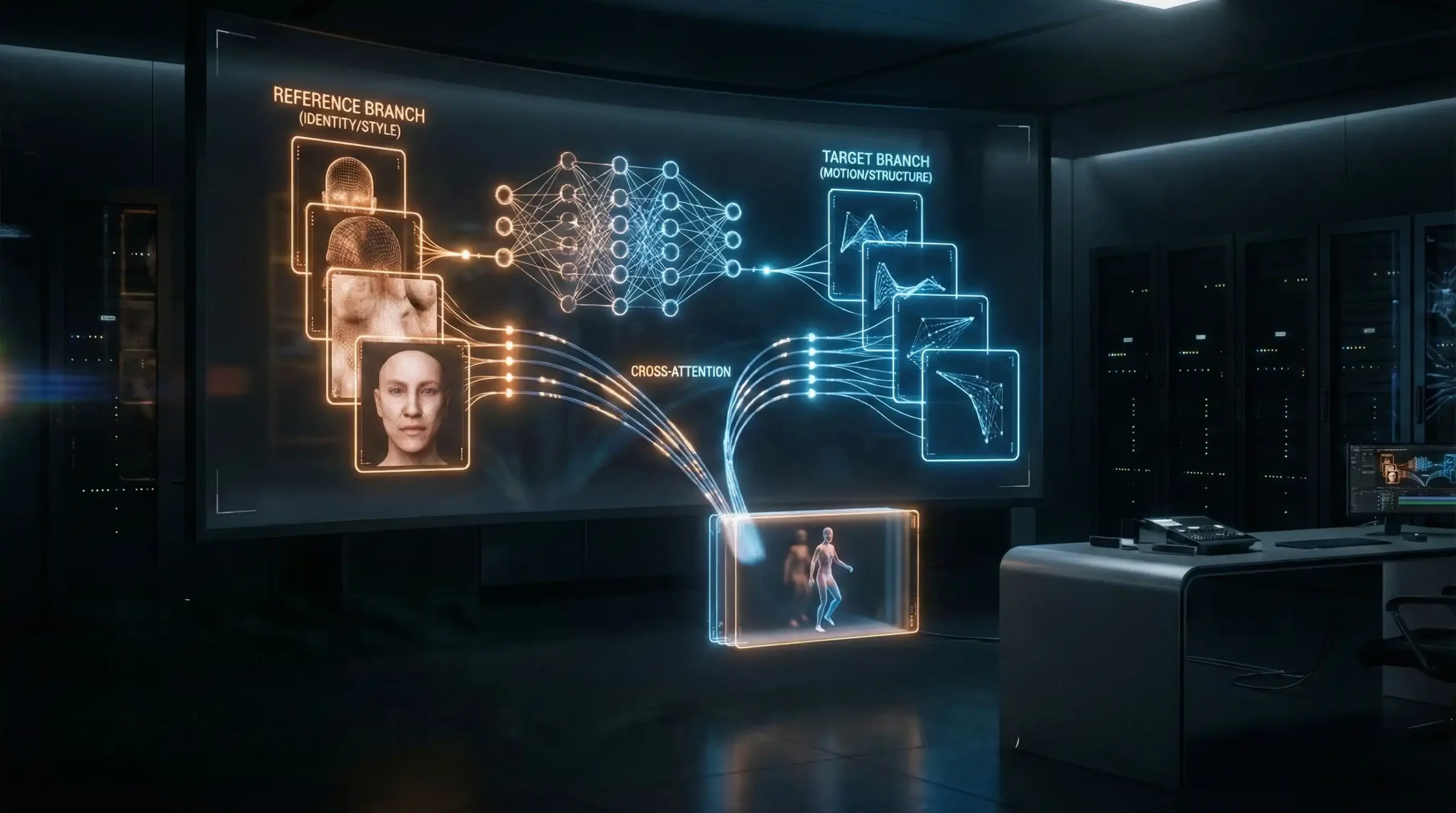

La U-Net se bifurca en dos caminos especializados:

- Reference Branch: Extrae características espaciales estáticas (identidad, ropa, estilo).

- Target Branch: Genera la dinámica temporal utilizando Atención Causal (mira solo al pasado) e inyecta la información de referencia vía Cross-Attention solo cuando es necesario.

El sistema introduce una matriz dinámica (Task-aware Positional Bias) que actúa como un regulador de rigidez:

- En Edición de Video: El sesgo es alto para forzar una alineación espacial estricta (píxel a píxel).

- En Transferencia de Movimiento: El sesgo se relaja, permitiendo que el sujeto se mueva libremente por el frame sin deformarse.

Esta tecnología no es teórica; es el motor que permitirá a herramientas como Jimeng AI y CapCut ofrecer funciones de «Magic Edit» y reemplazo de actores sin los errores de parpadeo (flickering) que vemos en modelos competidores como Runway.

ByteDance no ha creado «otra IA generativa de video«. Ha resuelto el problema de la fragmentación arquitectónica. OmniTransfer (arXiv:2601.14250) propone el primer sistema capaz de desacoplar matemáticamente la identidad espacial de la dinámica temporal, permitiendo un control granular que deja obsoletos los métodos de fine-tuning de tarea única.

Hasta hoy, la generación de video sufría de una dicotomía paralizante. Si querías fidelidad en la identidad (cara), perdías fluidez en el movimiento (video rígido). Si querías movimiento complejo, la identidad alucinaba (flickering). Los modelos existentes, como Tune-A-Video o ControlVideo, son «especialistas rígidos»: funcionan para editar estilo o para transferir movimiento, pero no ambos, porque sus mecanismos de atención entrelazan el «qué» y el «cuándo» de forma inseparable.

El Intelligent Creation Lab de ByteDance ha publicado la solución: una arquitectura que desacopla estas dimensiones. A continuación, analizamos la ingeniería profunda de OmniTransfer.

Anatomía Técnica: El Problema del Entrelazamiento en los VDM

La mayoría de los modelos de difusión de video (VDM) extienden la arquitectura U-Net 2D añadiendo capas de atención temporal. El problema fundamental es que procesan la imagen de referencia (ej: la cara de un actor) y el video objetivo (el movimiento) en el mismo flujo latente o concatenados.

Esto provoca dos fallos catastróficos que OmniTransfer soluciona:

- Conflicto de Alineación: El modelo intenta alinear los píxeles de la referencia (cara estática) con los del objetivo (cuerpo en movimiento) en las mismas coordenadas espaciales. Resultado: el video se ve forzado y antinatural.

- Fuga de Información (Leakage): Al procesar todo junto, el fondo o el estilo de la imagen de referencia «sangran» hacia el video final, impidiendo ediciones limpias (ej: cambiar el fondo manteniendo al sujeto).

La Solución: Arquitectura de Tres Pilares

OmniTransfer reestructura la U-Net tradicional mediante tres mecanismos novedosos que merecen un análisis detallado para entender el futuro de la edición de video con IA.

1. Aprendizaje Causal Desacoplado (Reference-decoupled Causal Learning)

Esta es la joya del paper. En lugar de inyectar la referencia como un prompt más, ByteDance bifurca la red neuronal en dos ramas paralelas que no se tocan hasta el momento preciso:

- Reference Branch (Rama de Referencia): Procesa la imagen o video guía (identidad/estilo). Esta rama extrae las features espaciales sin ruido.

- Target Branch (Rama Objetivo): Es la que genera el nuevo video. Aquí es donde ocurre la magia: esta rama utiliza Atención Causal. A diferencia de la atención bidireccional estándar (donde el frame 1 mira al 10 y viceversa), la atención causal asegura que el frame $t$ solo atienda a los frames $0…t-1$.

¿Por qué es crítico esto?

Al usar atención causal en la rama objetivo, se garantiza la consistencia temporal (el movimiento fluye hacia adelante). Al conectar ambas ramas mediante Atención Cruzada (Cross-Attention), la rama objetivo puede «consultar» los detalles de la rama de referencia (la textura de la piel, el color de la ropa) sin importar en qué posición espacial se encuentren. Esto elimina el leakage del fondo y permite transferir una identidad a un movimiento completamente nuevo sin artefactos.

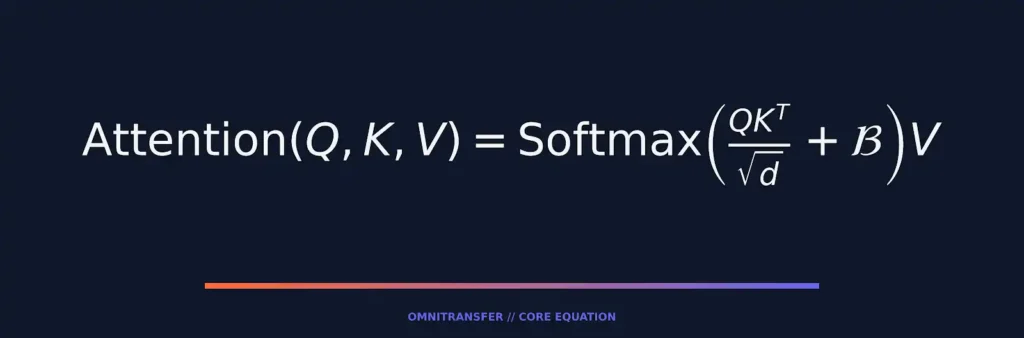

2. Sesgo Posicional Consciente de la Tarea (Task-aware Positional Bias)

Aquí entra la versatilidad del modelo. No todas las tareas de IA generativa requieren la misma «atención».

- Si haces Video Editing (cambiar estilo), necesitas que el píxel (x,y) del frame t se parezca mucho al píxel (x,y) del video original.

- Si haces Motion Transfer (animar una foto), el píxel (x,y) de la foto no tiene nada que ver con la posición del brazo en el video final.

OmniTransfer introduce un mecanismo de Inyección de Sesgo (Bias Injection) en las capas de atención. El modelo calcula una matriz de sesgo aprendible $\mathcal{B}$ que se suma a los mapas de atención:

Este sesgo $\mathcal{B}$ no es estático; es dinámico. El modelo «decide» relajar las restricciones espaciales para permitir grandes movimientos o endurecerlas para preservar la estructura. Es un controlador de rigidez matemático.

3. Alineación Multimodal Adaptativa (Task-adaptive Multimodal Alignment)

Para evitar reentrenar el modelo para cada caso de uso, OmniTransfer utiliza un Adaptador de Tarea. El sistema ingiere dos tipos de inputs:

- Instrucción de Texto: «Transforma en estilo anime» o «Haz que baile».

- Tokens de Tarea: Embeddings especiales que definen la operación.

Un módulo MLP (Perceptrón Multicapa) procesa estos inputs y genera parámetros de modulación que ajustan los pesos de la U-Net en tiempo real. Esto permite que el mismo modelo pase de ser un «restaurador de video» a un «animador de avatares» en milisegundos.

ByteDance en Producción: Del Paper a la App

Es crucial entender quién firma este paper. No es una universidad; es el Intelligent Creation Lab de ByteDance. Esto significa que lo que leemos aquí es la base técnica de productos que ya están impactando el mercado.

Jimeng AI y la Guerra contra Sora

ByteDance lanzó recientemente Jimeng AI en China, su competidor directo de Sora y Runway Gen-3. Los problemas de morphing (objetos que cambian de forma) que sufren los competidores se solucionan precisamente con la Atención Causal descrita en este paper. Es muy probable que OmniTransfer sea el motor de renderizado de la próxima versión (v2.0) de Jimeng, permitiendo generación de video de larga duración sin degradación temporal.

El «Santo Grial» de CapCut

Para CapCut, esta tecnología habilita funciones que hoy parecen ciencia ficción:

- Reemplazo de Actores (Virtual Try-On en Video): Gracias a la rama desacoplada, podrías subir un video tuyo caminando y pedirle a la IA que te ponga la ropa de un catálogo, manteniendo las arrugas y la física de la tela perfectas.

- Edición Semántica: «Cambia el día por la noche, pero no toques la iluminación de la cara del protagonista». El Task-aware Positional Bias permite aislar la iluminación global de la identidad local.

Evaluación Crítica: Rendimiento y Costes

El análisis comparativo contra MimicMotion y WanAnimate (Wan 2.2) revela datos interesantes:

- Robustez ante Oclusiones: Los métodos basados en pose estimation (como ControlNet con OpenPose) fallan cuando una mano tapa la cara, devolviendo errores. OmniTransfer, al no depender explícitamente de esqueletos sino de features semánticas profundas, infiere el movimiento correctamente incluso en oclusión.

- Coste Computacional: Aquí reside la desventaja. Duplicar la U-Net (ramas Reference y Target) implica un aumento lineal en el consumo de VRAM. Aunque existen optimizaciones, este no es un modelo para correr localmente en una GPU de consumo con facilidad; es una arquitectura pensada para inferencia en servidor (H100/A100).

Conclusión: La Estandarización del Flujo

OmniTransfer no es revolucionario solo por generar mejores píxeles, sino por proponer una arquitectura unificada. Hasta ahora, teníamos una «caja de herramientas» desordenada. ByteDance ha construido la navaja suiza.

Al separar matemáticamente la referencia del objetivo, han resuelto el problema de la «memoria» en el video: la IA ya no necesita recordar cómo era la cara del actor en el frame 1; simplemente la consulta en la rama paralela cuando es necesario.