OpenAI pierde su brújula de hardware ante el avance del Pentágono

Resumen estructurado: La fractura en OpenAI

Crisis de identidad corporativa. La salida de Caitlin Kalinowski no es un simple cambio de ejecutivos, sino la confirmación de que OpenAI ha priorizado la escala militar sobre la ética en el desarrollo de hardware y robótica en este 2026.

La integración de modelos de razonamiento en redes clasificadas del Departamento de Defensa ha cruzado una línea roja para los ingenieros de IA física. Kalinowski critica la falta de gobernanza y transparencia en este despliegue.

Sin una dirección técnica clara tras la dimisión, los proyectos de hardware doméstico y los sistemas robóticos autónomos de OpenAI pierden su nexo con la realidad del usuario final, cediendo terreno a Figure AI y Tesla.

El éxodo de talento hacia competidores como Anthropic se acelera. La percepción de Claude como «refugio ético» se fortalece frente a un OpenAI que muchos empleados consideran ahora una extensión de la infraestructura de defensa.

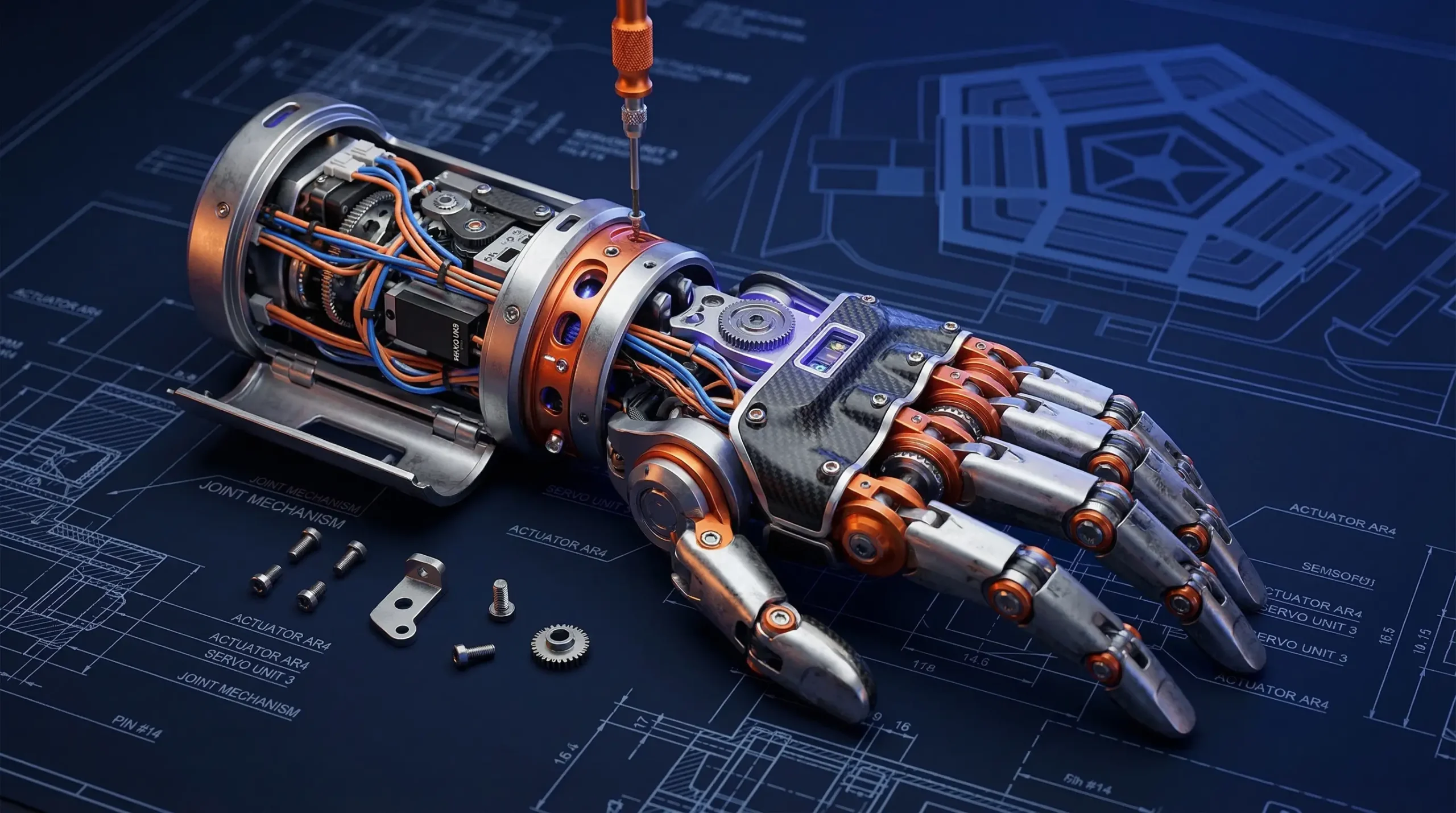

La visión de Jony Ive y Kalinowski sobre una IA «humana y táctil» queda comprometida. El enfoque de la compañía se desplaza bruscamente hacia el cumplimiento de contratos gubernamentales y la optimización de agentes para ciberdefensa.

«En 2026, la tecnología no es neutral; la renuncia de Kalinowski nos recuerda que quien diseña el cuerpo de la IA decide también sus propósitos finales.»

La dimisión de Caitlin Kalinowski, directora de robótica y hardware de consumo de OpenAI, ha sacudido los cimientos de la compañía de Sam Altman. Tras apenas 16 meses liderando la división de IA física, la ingeniera —clave en el desarrollo previo de las gafas Orion en Meta— anunció su salida el pasado 7 de marzo de 2026. El detonante ha sido la firma de un acuerdo de colaboración entre OpenAI y el Departamento de Defensa de EE. UU. (DoD) para desplegar sus modelos en redes militares clasificadas, un movimiento que Kalinowski ha calificado como «apresurado y falto de gobernanza».

El dilema de la autonomía letal

La salida de Kalinowski no ha sido silenciosa. En un mensaje cargado de intención, la exdirectiva subrayó que, aunque la IA tiene un papel en la seguridad nacional, la vigilancia de ciudadanos sin supervisión judicial y la autonomía letal sin autorización humana son líneas que exigían una deliberación mucho más profunda. Esta postura pone de relieve la tensión interna en OpenAI, donde parte del equipo técnico observa con recelo cómo la empresa ha aceptado términos que su competidor directo, Anthropic, rechazó frontalmente semanas atrás.

En el plano estrictamente técnico, este conflicto expone la dificultad de controlar el uso final de modelos de lenguaje y razonamiento una vez integrados en los sistemas del Departamento de Guerra (DoW). Sam Altman, en un ejercicio de control de daños, admitió públicamente que el proceso de anuncio del acuerdo fue «oportunista y descuidado», intentando calmar a una base de empleados y usuarios que ya ha iniciado movimientos de boicot como QuitGPT.

Un vacío estratégico en la IA física

Para Arkosia, el impacto es crítico. Kalinowski era la pieza maestra encargada de llevar la inteligencia de OpenAI al mundo físico, incluyendo el esperado hardware doméstico desarrollado junto a Jony Ive. Su renuncia deja huérfana la integración de la IA en sistemas robóticos justo cuando la industria vira hacia los agentes autónomos con capacidad de acción real.

El acuerdo con el Pentágono busca, según OpenAI, crear un camino para el uso responsable de la IA en seguridad nacional, estableciendo «líneas rojas» contra el uso en armas autónomas. Sin embargo, la pérdida de su máxima responsable de robótica sugiere que las salvaguardas arquitectónicas actuales podrían no ser suficientes para quienes diseñan la infraestructura desde el interior.