Shadow AI: Los riesgos de usar IA «en secreto» en tu empresa y cómo protegerte

Resumen Ejecutivo: Shadow AI 2026

El Contexto: La eficiencia operativa impulsa a los empleados a usar IA no sancionada, exponiendo datos críticos y creando una red de «Shadow Agents» autónomos imposibles de auditar.

El uso de cuentas gratuitas y código generado sin supervisión («Vibe Coding») dispara el coste por incidente en +$670k y expone a la empresa a multas del 7% (Ley IA UE).

- Soberano: LLMs locales (Ollama) para datos confidenciales.

- Sanitizado: Middleware (Presidio) para limpieza de prompts.

- Público: Cuentas Zero-Retention para marketing/general.

Sustitución competitiva mediante herramientas oficiales que garantizan la propiedad del dato:

- Oficina: Copilot for Microsoft 365 (Entorno seguro).

- Razonamiento: ChatGPT Enterprise / Claude for Work (Sin entrenamiento).

- Código: GitHub Copilot Enterprise (Auditoría IP).

El panorama de la seguridad corporativa ha sufrido una transformación tectónica. Históricamente, el concepto de Shadow IT se limitaba a empleados instalando software no autorizado o trayendo sus propios dispositivos a la oficina. Sin embargo, en 2025, esta amenaza mutó hacia una manifestación mucho más insidiosa y omnipresente: la Shadow AI. A diferencia de sus predecesores, este fenómeno no se limita a la infraestructura, sino que representa una descentralización radical de la capacidad cognitiva de la organización. Los empleados ya no solo almacenan archivos fuera del perímetro; ahora razonan, toman decisiones estratégicas y generan código crítico en plataformas externas sin supervisión.

La magnitud del problema es financiera y operativamente tangible. Los informes de telemetría más recientes indican que el tráfico hacia sitios de IA generativa aumentó un 50% entre 2024 y 2025, alcanzando más de 10.000 millones de visitas mensuales. Esta migración masiva de flujos de trabajo cognitivos tiene un coste directo: los incidentes de seguridad derivados de la Shadow AI cuestan, en promedio, 670.000 dólares más que los incidentes tradicionales. Lo alarmante es la persistencia del riesgo, ya que estas herramientas no sancionadas permanecen integradas en los procesos de negocio durante más de 400 días de media, creando dependencias operativas profundas y difíciles de erradicar.

Anatomía del Usuario: Perfiles, Motivaciones y Riesgos

Para combatir la Shadow AI, primero debemos entender quién la utiliza y por qué. Lejos de ser una actividad maliciosa, nace de una necesidad operativa no satisfecha por las herramientas corporativas sancionadas. Según el análisis de adopción de 2025, identificamos cuatro perfiles críticos que operan bajo el radar:

- El «Optimizador de Flujo»: Su objetivo es eliminar tareas repetitivas. Utiliza chatbots genéricos (ChatGPT, Gemini personal) para resumir hilos de correo o redactar actas. Riesgo: Fuga masiva de PII (Información Personal Identificable) y datos de comunicaciones internas confidenciales.

- El «Analista de Datos Ad-Hoc»: Frustrado por la lentitud de los departamentos de BI, este usuario sube hojas de cálculo financieras o bases de datos de clientes a herramientas como ChatPDF o versiones personales de NotebookLM para obtener insights rápidos. Riesgo: Exposición directa de secretos comerciales y datos financieros estratégicos en entornos no cifrados.

- El «Vibe Coder» (Desarrollador Ciudadano): Como mencionamos, busca generar micro-servicios o scripts de automatización sin fricción burocrática. Riesgo: Inyección de vulnerabilidades y deuda técnica invisible que el departamento de TI deberá mantener o purgar eventualmente.

- El «Creativo Desbloqueado»: Personal de marketing o diseño que recurre a generadores de imagen/video (Midjourney, Runway) fuera del ciclo de agencia para cumplir plazos imposibles. Riesgo: Problemas legales de derechos de autor y uso de activos de marca en plataformas públicas que reclaman propiedad sobre las generaciones.

El Paradigma del «Vibe Coding» y la Erosión del SDLC

Uno de los desarrollos más disruptivos de este último año ha sido la institucionalización del «Vibe Coding». Este término describe una práctica donde desarrolladores, y cada vez más usuarios sin formación técnica profunda, utilizan lenguaje natural para guiar a la IA en la generación de código, priorizando la funcionalidad inmediata —el «vibe» o intención— sobre la seguridad o la mantenibilidad. Aunque esta práctica ha democratizado la creación de software permitiendo a departamentos como Marketing o RR.HH. construir micro-servicios rápidamente, ha introducido riesgos catastróficos en el ciclo de vida de desarrollo de software (SDLC).

Las auditorías de código generado bajo este paradigma revelan una prevalencia alarmante de vulnerabilidades básicas como inyección SQL, autenticación rota y exposición de claves API. El problema se agrava porque la IA, al carecer de contexto sobre la arquitectura de seguridad empresarial, tiende a repetir patrones inseguros de repositorios públicos obsoletos. Cuando este código entra en producción a través de cuentas personales de GitHub Copilot o herramientas similares, elude los escáneres de seguridad estáticos (SAST) corporativos, creando una superficie de ataque invisible para el CISO.

La Cadena de Suministro: Lecciones del Incidente DeepSeek

La confianza ciega en proveedores emergentes se cobró su primera gran víctima en enero de 2025 con el incidente de DeepSeek. Esta startup, que había ganado popularidad viral por su eficiencia en tareas de codificación, sufrió una exposición masiva de datos debido a una base de datos ClickHouse accesible públicamente sin autenticación. El incidente expuso más de un millón de registros sensibles, incluyendo historiales de chat completos donde los usuarios habían pegado código propietario y claves API secretas.

Este evento subraya el riesgo de la cadena de suministro en la Shadow AI. A diferencia de proveedores establecidos con madurez en DevSecOps, muchas startups de IA carecen de controles básicos. Los empleados, atraídos por la gratuidad o la novedad, exponen la propiedad intelectual de la empresa a actores maliciosos que pueden pivotar desde la herramienta de IA hacia la infraestructura interna utilizando las credenciales filtradas.

Auditoría Forense: Descubriendo lo Invisible

Antes de plantear cualquier defensa, es imperativo entender la magnitud de la exposición. La mayoría de las organizaciones operan a ciegas, confiando en encuestas a empleados que rara vez reflejan la realidad. La primera medida efectiva es el despliegue de soluciones de descubrimiento automatizado. Las herramientas modernas de CASB (Cloud Access Security Broker) y los Secure Web Gateways (SWG) deben configurarse no para bloquear, sino para inspeccionar los registros de tráfico DNS y firewall en busca de patrones de comunicación con APIs de IA conocidas y emergentes.

El análisis de estos registros a menudo revela una «TI en la sombra» mucho más vasta de lo imaginado, con departamentos enteros utilizando herramientas de transcripción de reuniones (como Otter.ai o Fireflies) que graban y procesan audio confidencial en nubes de terceros sin contratos de procesamiento de datos (DPA) vigentes. Identificar estos flujos de datos es el paso cero: no se puede proteger lo que no se sabe que existe.

Arquitectura de Defensa en Capas: Del Bloqueo a la Habilitación

La respuesta instintiva de prohibir el acceso a la IA Generativa ha demostrado ser un fracaso rotundo en 2025. Los empleados, presionados por la productividad, encuentran formas de eludir los bloqueos (usando datos móviles 5G o VPNs personales). La estrategia ganadora para 2026 es la «Habilitación Segura», una arquitectura de tres niveles que canaliza la innovación sin comprometer los activos.

El Primer Nivel (Soberano) está destinado a los datos de «Joyas de la Corona». Para información altamente confidencial, propiedad intelectual o datos de clientes regulados (GDPR/HIPAA), la única opción segura es el despliegue de LLMs locales. Utilizando herramientas de orquestación como Ollama o vLLM sobre infraestructura propia (on-premise o VPC aislada), las empresas pueden ofrecer capacidades similares a GPT-4 sin que un solo byte abandone el perímetro de la red.

El Segundo Nivel (Sanitizado) permite el uso de modelos comerciales potentes (como Claude 3.5 o GPT-5) pero a través de un «Middleware de Seguridad». Aquí es donde entran en juego herramientas de anonimización como Microsoft Presidio o proxies de IA dedicados. Estas soluciones interceptan el prompt del usuario en tiempo real, detectan entidades sensibles (nombres, tarjetas de crédito, código propietario) y las ofuscan o redactan antes de enviar la solicitud al proveedor externo. Al recibir la respuesta, el middleware rehidrata los datos, entregando un resultado útil al usuario sin haber expuesto la información real al modelo público.

El Tercer Nivel (Público) se reserva para tareas de bajo riesgo y datos públicos, donde el uso de herramientas comerciales estándar con cuentas corporativas (Enterprise) es aceptable, siempre que existan cláusulas de no-entrenamiento (zero-retention) firmadas.

La Solución Definitiva: Habilitar Ecosistemas Enterprise

La única forma efectiva de erradicar la Shadow AI no es el bloqueo, sino la sustitución competitiva. Los empleados usan herramientas externas porque son útiles. La estrategia ganadora consiste en proporcionar esas mismas capacidades bajo un contrato corporativo que garantice legalmente la propiedad de los datos (DPA). Para 2026, estas son las tres vías de consolidación recomendadas:

- Para el entorno de oficina (Microsoft/Google): Si tu organización ya vive en Microsoft 365, la activación de Copilot for Microsoft 365 es la defensa natural. A diferencia de usar ChatGPT en el navegador, Copilot hereda los permisos de acceso de cada usuario y los datos nunca salen del «límite de confianza» del inquilino de la empresa.

- Para el razonamiento avanzado (OpenAI/Anthropic): Para departamentos de I+D o Estrategia, las versiones ChatGPT Team/Enterprise o Claude for Work son obligatorias. La diferencia crítica es la exención de entrenamiento: el proveedor firma legalmente que las entradas y salidas son propiedad exclusiva del cliente.

- Para el desarrollo de software (Coding): El «Vibe Coding» debe canalizarse a través de GitHub Copilot Enterprise. Estas versiones permiten bloquear sugerencias de código público inseguro y auditar la autoría, mitigando riesgos de propiedad intelectual.

Cultura y Gobernanza: El Factor Humano

Ninguna arquitectura técnica es impenetrable si la cultura organizacional falla. La formación en 2026 debe evolucionar de las advertencias genéricas de ciberseguridad a talleres prácticos de «Higiene de IA». Los empleados deben aprender a distinguir qué datos constituyen un riesgo y cómo anonimizar sus propios prompts manualmente si las herramientas automáticas fallan. Es vital establecer una Política de Uso Aceptable (AUP) específica para IA que defina claramente las consecuencias del «Shadow AI» no como una falta administrativa, sino como un riesgo existencial para la empresa.

Seguridad Personal y Corporativa

Cabe tomar medidas de seguridad no solo en el ámbito empresarial, sino también en el personal; la frontera entre ambos mundos es cada vez más difusa y nuestros dispositivos personales son a menudo la puerta de entrada a vulnerabilidades mayores. Esta soberanía sobre nuestros datos la conseguimos utilizando herramientas que garanticen que la información nunca abandona nuestro control local, como las disponibles en la Arkosia Utility Suite.

Para aplicar esta defensa en profundidad en tu día a día, dispones de soluciones específicas: si necesitas compartir texto que contiene datos personales, ARK Privacy Airlock te permite censurar y ofuscar datos sensibles automáticamente antes de que salgan de tu navegador. Si el riesgo reside en los archivos multimedia, ARK Metadata Incinerator elimina la huella invisible de ubicación y dispositivo de tus imágenes. Del mismo modo, para entornos administrativos y gestión documental, ARK PrivaDoc realiza una limpieza forense de metadatos en archivos DOCX y PDF, asegurando que el historial de edición y autoría permanezca estrictamente confidencial.

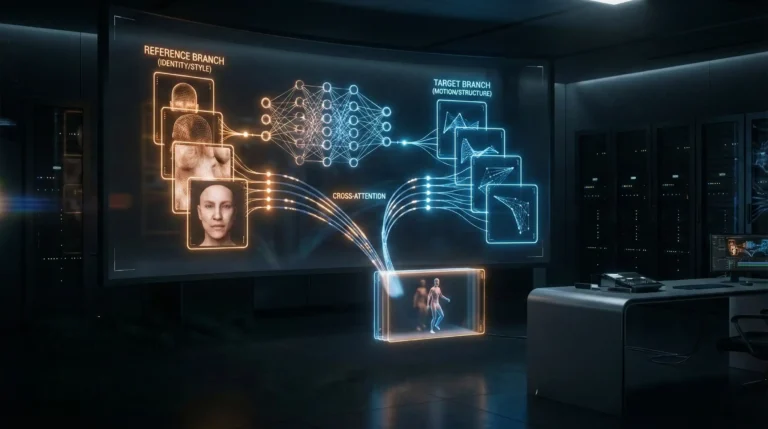

2026: La Era de los «Shadow Agents»

Mirando hacia el futuro inmediato, la preocupación se desplaza de los chatbots pasivos a los «Shadow Agents». En 2026, el riesgo ya no será solo la fuga de información, sino la manipulación de sistemas por parte de agentes autónomos capaces de ejecutar acciones, como enviar correos o desplegar código, sin supervisión directa. Esto, sumado a la entrada en vigor de las sanciones de la Ley de IA de la UE en agosto de 2026, convierte la ignorancia sobre el inventario de IA en una negligencia legal punible con multas de hasta el 7% de los ingresos globales. La seguridad en 2026 no trata de construir muros más altos, sino de establecer carriles inteligentes y vigilados por donde pueda fluir la innovación sin comprometer la supervivencia de la organización.