El riesgo oculto del vibe coding y la crisis de seguridad corporativa

Resumen Estructurado El riesgo del vibe coding

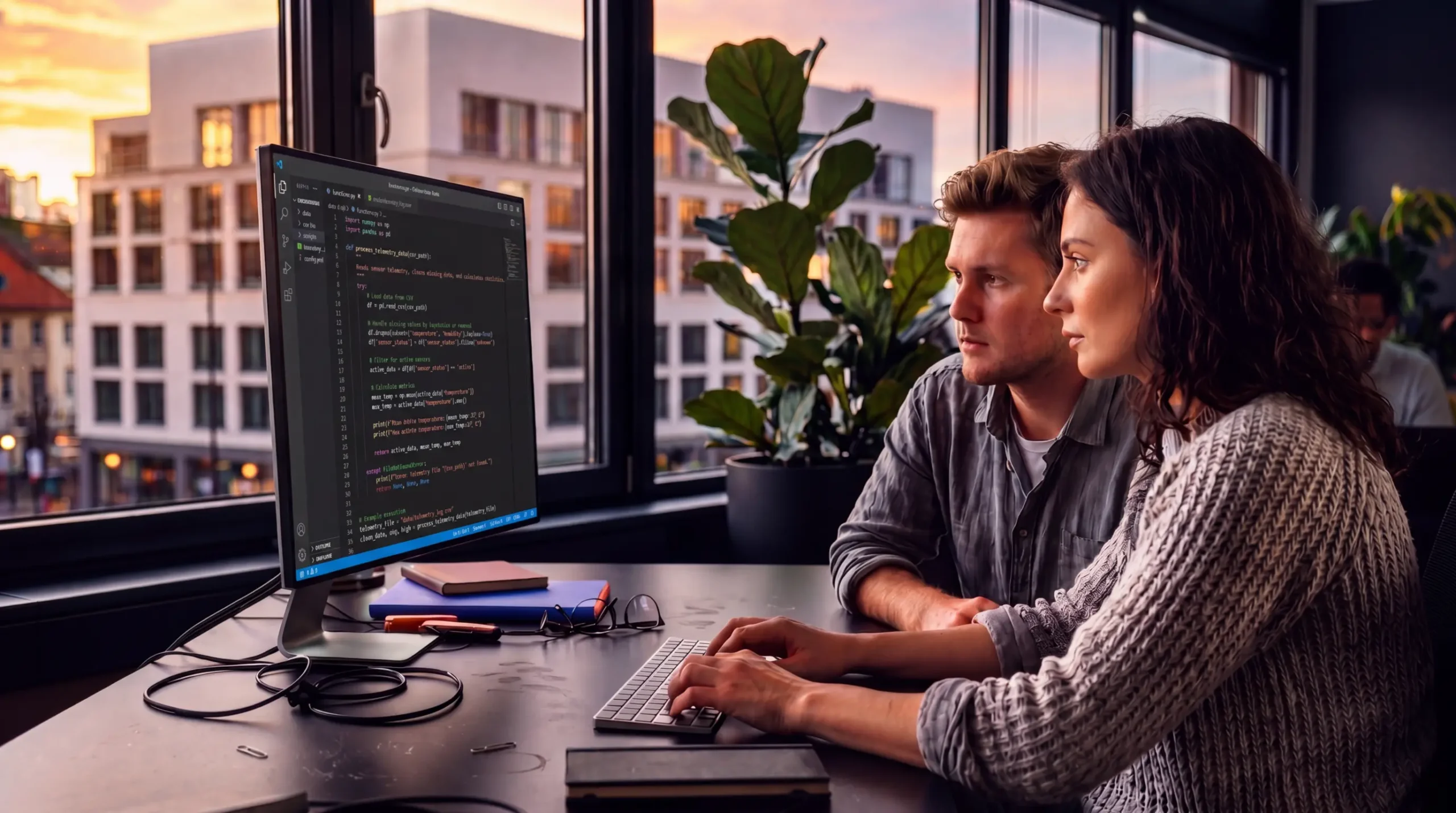

El contexto: La democratización del desarrollo mediante inteligencia artificial permite a perfiles no técnicos crear software en tiempo récord. Esta agilidad, sin un marco de control riguroso, está generando una crisis sistémica de seguridad en las empresas.

Herramientas generativas permiten crear aplicaciones funcionales priorizando el aspecto visual. Al delegar la lógica profunda a la IA, se ignoran protocolos básicos de seguridad y se abren cientos de vectores de riesgo activo dentro de la red corporativa.

El impacto más grave se concentra en la configuración de repositorios en la nube. La falta de conocimientos técnicos deriva en la adopción de permisos de acceso público por defecto, exponiendo credenciales y datos confidenciales sin autenticación.

El cerco legal y normativo exige control absoluto. Las empresas necesitan transicionar hacia un modelo de auditoría en tiempo real que escanee repositorios y conexiones de interfaces antes de pasar a producción.

El uso de la inteligencia artificial acelera la operatividad pero no exime de la diligencia humana. La seguridad debe ser un principio innegociable desde el primer requerimiento introducido en el modelo.

«En 2026, la verdadera madurez tecnológica no es desplegar código más rápido, sino hacerlo garantizando la trazabilidad absoluta de la información.»

En 2026 la velocidad de desarrollo impulsada por inteligencia artificial ha transformado por completo la forma en que se construye el software. La expansión de la tendencia conocida como vibe coding, donde programadores y perfiles no técnicos delegan complejas decisiones arquitectónicas a modelos de lenguaje que priorizan resultados visualmente funcionales, permite desplegar aplicaciones completas en cuestión de horas. Herramientas como Cursor AI, v0 o Replit Agent han democratizado la creación de software al punto de que un perfil de marketing puede generar un panel de control funcional o un ingeniero puede prototipar un microservicio sin escribir código manualmente. Sin embargo esta tremenda facilidad también amplía exponencialmente la superficie de ataque de las organizaciones cuando estas herramientas se integran en los procesos empresariales sin la debida supervisión ni un gobierno formal.

Arquitectura y funcionamiento de la vulnerabilidad

El problema central trasciende lo puramente técnico para convertirse en una falla organizativa sistémica que afecta a todos los niveles operativos. Cuando empleados o equipos completos utilizan asistentes de inteligencia artificial no aprobados para redactar código, optimizar integraciones o automatizar flujos de datos, la empresa pierde visibilidad total sobre el ciclo de vida de su información sensible.

Un efecto colateral alarmante es la crisis actual de los repositorios mal configurados. Los proveedores de infraestructura en la nube reportan que una gran parte de los incidentes de exposición de datos siguen vinculados a contenedores públicos o sin políticas de bloqueo activadas. Al delegar la creación de infraestructura a modelos generativos, los usuarios no técnicos aceptan configuraciones por defecto que priorizan la funcionalidad inmediata sobre la seguridad, dejando credenciales, copias de seguridad o código fuente expuestos a internet sin requerir autenticación alguna. Esta vulnerabilidad se hizo evidente recientemente cuando una consultora financiera europea expuso terabytes de datos transaccionales por un repositorio creado mediante un asistente de inteligencia artificial que mantuvo políticas de acceso público durante días antes de ser detectado.

Impacto económico y evidencia actual

La evidencia disponible demuestra un impacto económico devastador. Los informes sectoriales de 2025 sobre el coste de las brechas de datos indican que las organizaciones con un alto nivel de shadow AI afrontaron un coste medio adicional cercano a los setecientos mil dólares por incidente. Resulta alarmante que la práctica totalidad de las brechas vinculadas a la inteligencia artificial carecían de controles de acceso adecuados, y solo una minoría de las empresas afectadas contaban con políticas específicas de gobernanza implementadas previamente.

Los análisis del estado del shadow AI añaden que más del ochenta por ciento de las grandes corporaciones detectaron herramientas no autorizadas en su red, destacando el uso de asistentes conversacionales y herramientas de generación de código sin licencia corporativa. El cálculo es simple y demoledor; si una empresa cuenta con miles de empleados y una fracción de ellos utiliza herramientas generativas no aprobadas diariamente, se generan cientos de vectores de riesgo activo que procesan información confidencial sin supervisión centralizada.

Casos de uso reales y el cerco regulatorio

En el día a día operativo los vectores de riesgo son específicos y perfectamente evitables. Un analista de datos puede utilizar un modelo de lenguaje público para optimizar un script y exponer inadvertidamente credenciales o la lógica de segmentación de clientes. Un desarrollador puede introducir cientos de líneas de código propietario en un asistente para solucionar un error, dejando ese contexto integrado en el conjunto de datos de entrenamiento del proveedor.

A nivel legal esto expone a las corporaciones a un campo minado, ya que normativas como el Reglamento General de Protección de Datos responsabilizan a las empresas por las subcontrataciones de tratamiento de datos, incluyendo los servicios de inteligencia artificial. Paralelamente, el marco regulatorio europeo ha cerrado el cerco de forma drástica. La reciente legislación sobre inteligencia artificial establece obligaciones cristalinas, exigiendo sistemas de gestión continua del riesgo a lo largo de todo el ciclo de vida, calidad y representatividad en los conjuntos de datos, documentación técnica detallada de la arquitectura y una supervisión humana adecuada para evitar daños por automatización.

Nuevo marco de auditoría para la dirección de seguridad

Bloquear las herramientas generativas de forma indiscriminada no solo es impracticable, sino que resulta contraproducente al fomentar un uso aún más opaco. Ante esta epidemia de vulnerabilidades, la dirección de seguridad debe pivotar hacia un marco de auditoría proactivo y en tiempo real. Esto exige un descubrimiento continuo que detecte llamadas a interfaces públicas desde los equipos corporativos, así como el escaneo constante de los repositorios en la nube para verificar permisos y el estado del cifrado.

La auditoría ya no puede ser reactiva ni manual. Los permisos de almacenamiento generados por inteligencia artificial deben validarse obligatoriamente antes de su paso a producción y el código generado debe analizarse en busca de patrones con vulnerabilidades conocidas. Asimismo es imperativo formar a todos los niveles para que interioricen que la inmediatez del vibe coding no equivale a seguridad. La inteligencia artificial es un acelerador extraordinario, pero jamás sustituirá la validación humana de los resultados críticos, la minimización de datos en las peticiones y la trazabilidad completa del ciclo de vida de cada modelo desplegado. La verdadera madurez tecnológica no radica en adoptar más inteligencia artificial, sino en dominarla asumiendo la seguridad y la responsabilidad como principios innegociables desde el diseño inicial.