Guía sobre el reglamento europeo de inteligencia artificial y su impacto en la innovación ética

Reglamento europeo de inteligencia artificial

Accede al texto oficial del Reglamento de Inteligencia Artificial de la Unión Europea. Este documento establece el marco jurídico armonizado para garantizar el desarrollo seguro y ético de la IA, equilibrando la innovación tecnológica con la protección de los derechos fundamentales de los ciudadanos.

Descargar documento oficialLa inteligencia artificial ha dejado de ser una promesa de ciencia ficción para convertirse en el motor invisible de nuestro día a día. Sin embargo, con el inmenso poder de los algoritmos surge una responsabilidad ineludible que la Unión Europea ha decidido liderar. El Reglamento (UE) 2024/1689, conocido comúnmente como la Ley de IA o RIA, representa un compromiso histórico para que la tecnología sea segura y esté profundamente centrada en el ser humano. Esta normativa no es un mero trámite burocrático, sino la primera norma integral reguladora de la IA en el mundo diseñada para proteger nuestros derechos fundamentales sin asfixiar el progreso técnico.

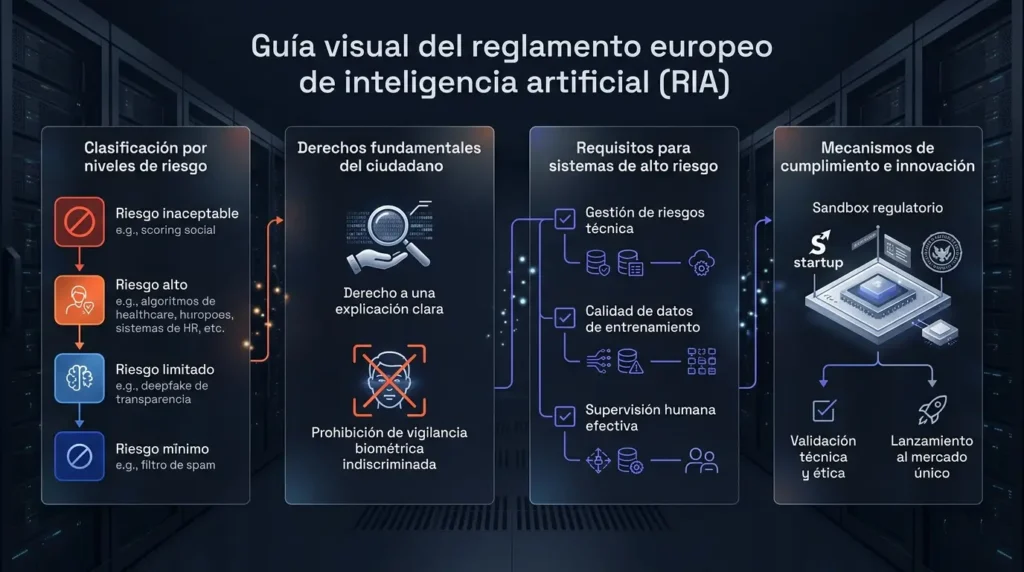

La filosofía central de esta norma se basa en un enfoque de riesgo donde la intensidad de la vigilancia es proporcional al peligro potencial de la herramienta. Esta estructura estratificada permite que las aplicaciones de bajo riesgo funcionen con libertad creativa mientras que los sistemas críticos que afectan directamente a la vida de las personas quedan bajo una vigilancia rigurosa. En este escenario de 2026, entender estos niveles es crucial para cualquier desarrollador o empresa que desee operar en el mercado único europeo.

El impacto en las personas físicas y los nuevos derechos del ciudadano

El reglamento sitúa a la persona en el corazón de la tecnología definiendo límites claros a través de prohibiciones recogidas en el capítulo segundo. Quedan desterrados los sistemas de puntuación social similares a los de ciertas distopías o la vigilancia biométrica indiscriminada en espacios públicos por parte de entidades privadas. La transparencia es ahora una obligación y no un extra opcional, asegurando que cualquier ciudadano sepa cuándo está interactuando con una inteligencia artificial, especialmente en casos de generación de contenido sintético o sistemas de reconocimiento de emociones.

Para el usuario de a pie, esta ley significa que el derecho a una explicación clara sobre decisiones automatizadas es ahora una realidad legal. Si un algoritmo deniega un crédito o filtra una candidatura de empleo, el ciudadano tiene el respaldo jurídico para exigir la lógica subyacente a esa decisión. Esta soberanía digital es la que diferencia el modelo europeo de otros enfoques globales más permisivos con la opacidad algorítmica.

Requisitos técnicos y obligaciones para el sector empresarial

Desde la perspectiva del desarrollo, las empresas deben navegar por las exigencias del capítulo tercero que regula los sistemas de IA de alto riesgo. Estos sistemas, que incluyen infraestructuras críticas o gestión de recursos humanos, deben someterse a una evaluación de conformidad antes de su salida al mercado. La gestión de datos es un pilar fundamental en este proceso, exigiendo que los conjuntos de datos de entrenamiento sean pertinentes y representativos para evitar sesgos discriminatorios que puedan invalidar el producto.

La documentación técnica detallada y el registro de eventos son ahora estándares de la industria que garantizan la trazabilidad del software durante todo su ciclo de vida. Además, el control humano debe estar integrado por diseño, permitiendo que un operador pueda intervenir o desactivar el sistema en cualquier momento si detecta anomalías. Este enfoque de seguridad por diseño ha transformado la manera en que las startups arquitecturan sus modelos desde las fases iniciales de desarrollo.

Espacios controlados de pruebas para fomentar la innovación

Para evitar que la regulación se convierta en una barrera insalvable, el artículo 62 establece los espacios controlados de pruebas o sandboxes. Estos entornos permiten a las empresas innovar bajo la supervisión de autoridades competentes, recibiendo asesoramiento técnico y legal para validar sus productos antes del lanzamiento masivo. Las pequeñas y medianas empresas tienen acceso prioritario a estos recursos, reduciendo drásticamente los costes de cumplimiento iniciales y democratizando el acceso a la alta tecnología.

El éxito de esta normativa en este 2026 depende de que ciudadanos y empresas entiendan que la seguridad jurídica y la protección de los derechos no son obstáculos para el progreso. Por el contrario, representan el cimiento más sólido para construir una inteligencia artificial en la que realmente podamos confiar a largo plazo. Al establecer reglas claras y un régimen de sanciones proporcional, Europa busca liderar el mundo no solo en capacidad de cómputo, sino en integridad ética y valores humanos.